Llama 3低比特量化性能下降顯著!全面評估結果來了 | 港大&北航Ð

大模型力大磚飛,讓LLaMA3演繹出了新高度:

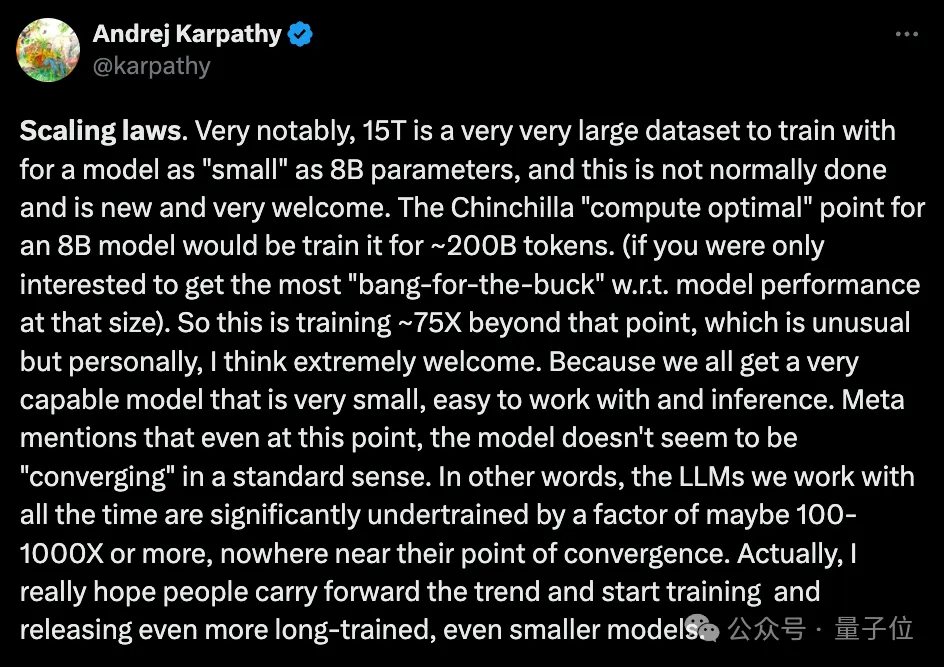

超15T Token數據上的超大規模預訓練,既實現了令人印象深刻的性能提升,也因遠超Chinchilla推薦量再次引爆開源社區討論。

與此同時,在實際應用層面上,另一個熱點話題也浮出水面:

資源有限場景下,LLaMA3的量化表現又會如何?

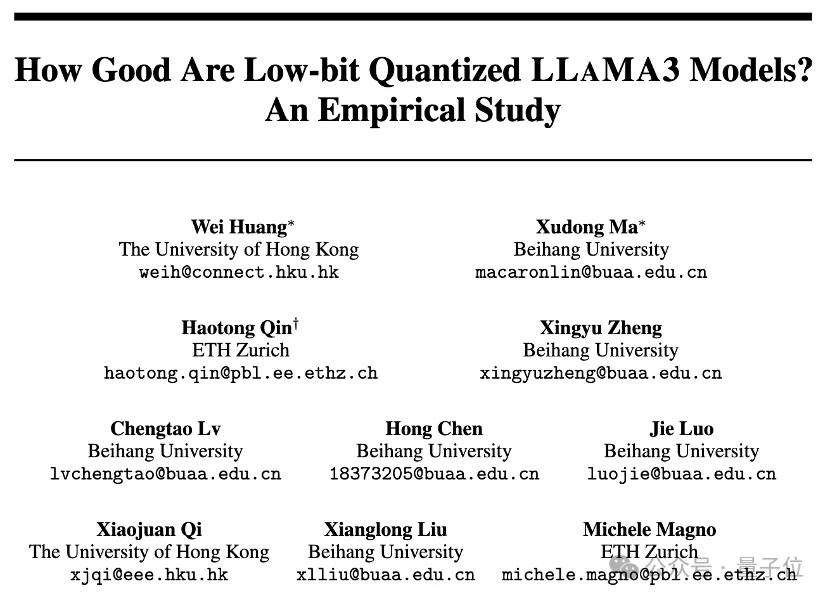

香港大學、北京航空航天大學、蘇黎世聯邦理工學院聯合推出了一項實證研究,全面揭示了LLaMA3的低比特量化性能。

研究人員使用現有的10種訓練后量化和LoRA微調方法,評估了LLaMA3在1-8比特和各種評估數據集上的結果。他們發現:

盡管性能令人印象深刻,LLaMA3在低比特量化下仍然遭受了不可忽視的退化,特別是在超低位寬上。

項目已在GitHub上開源,量化模型也已登陸HuggingFace。

具體來看實證結果。

軌道1:訓練后量化

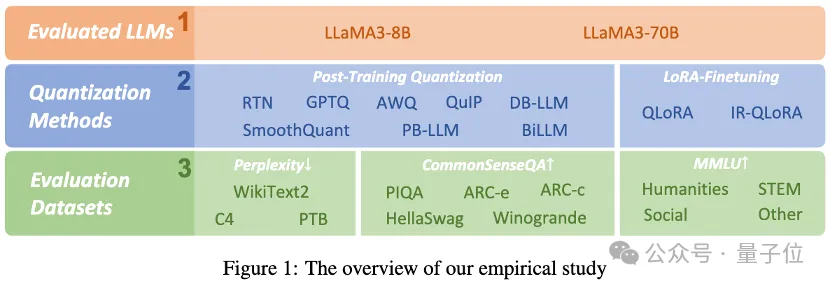

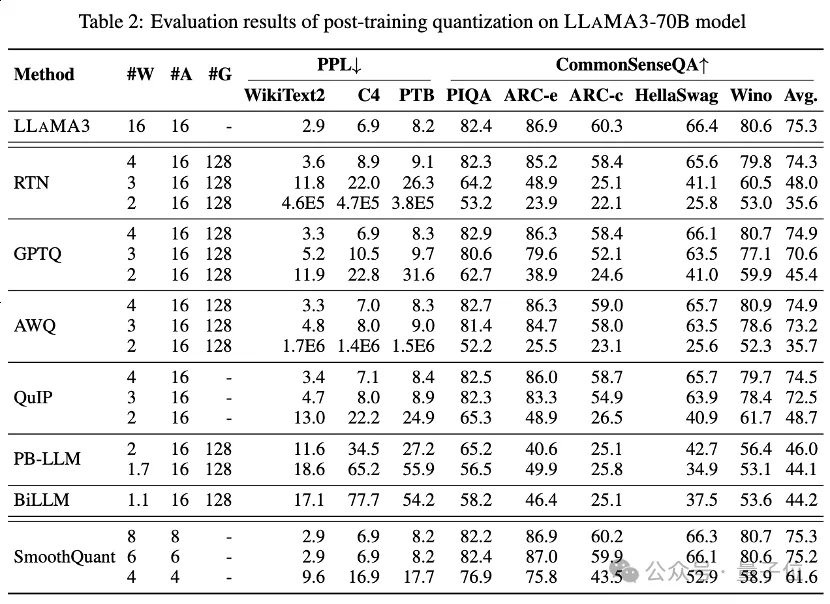

表1和表2中分別提供了LLaMA3-8B和LLaMA3-70B在8種不同的PTQ方法下的低比特性能表現,覆蓋了從1比特到8比特的廣泛比特寬度。

1.低比特權重

其中,Round-To-Nearest (RTN) 是一種基本的舍入量化方法。

GPTQ是當前最有效率和有效的僅限權重的量化方法之一,它利用量化中的誤差補償。但在2-3比特下,當量化LLaMA3時,GPTQ會導致嚴重的準確性崩潰。

AWQ采用異常通道抑制方法來降低權重量化的難度,而QuIP通過優化矩陣計算來確保權重和Hessian之間的不一致性。它們都能保持LLaMA3在3比特時的能力,甚至將2比特量化推向有希望的水平。

2.超低比特權重

最近出現的二值化LLM量化方法實現了超低比特寬度LLM權重壓縮。

PB-LLM采用混合精度量化策略,保留一小部分重要權重的全精度,同時將大部分權重量化為1比特。

DB-LLM通過雙重二值化權重分割實現高效的LLM壓縮,并提出偏差感知蒸餾策略以進一步增強2比特LLM性能。

BiLLM通過顯著權重的殘差逼近和非顯著權重的分組量化,進一步將LLM量化邊界推低至1.1比特。這些為超低比特寬度專門設計的LLM量化方法可以實現更高精度的量化LLaMA3-8B,在?2比特時遠遠超過如GPTQ、AWQ和QuIP等方法,在2比特(甚至在某些情況下3比特)下的表現。

3.低比特量化激活

還通過SmoothQuant對量化激活進行了LLaMA3評估,SmoothQuant將量化難度從激活轉移到權重,以平滑激活異常值。評估顯示,SmoothQuant可以在8比特和6比特的權重和激活下保留LLaMA3的準確性,但在4比特時面臨崩潰。

軌道2:LoRA微調量化

在MMLU數據集上,對于LoRA-FT量化下的LLaMA3-8B,最顯著的觀察是,在Alpaca數據集上低秩微調不僅不能補償量化引入的錯誤,甚至使性能下降更加嚴重。

具體來說,各種LoRA-FT量化方法在4比特下獲得的量化LLaMA3性能,比沒有使用LoRA-FT的4比特對應版本要差。這與LLaMA1和LLaMA2上的類似現象形成鮮明對比,在LLAMA1和LLAMA2中,4比特低秩微調量化版本甚至能輕松超過MMLU上的原始FP16對應版本。

根據直觀分析,這一現象的主要原因是由于LLaMA3強大的性能得益于其大規模的預訓練,這意味著原始模型量化后的性能損失不能通過在一小部分低秩參數數據上進行微調來補償(這可以被視為原始模型的一個子集)。

盡管量化導致的顯著下降不能通過微調來補償,但4比特LoRA-FT量化的LLaMA3-8B在各種量化方法下顯著優于LLaMA1-7B和LLaMA2-7B。例如,使用QLoRA方法,4比特LLaMA3-8B的平均準確率為57.0(FP16: 64.8),超過4比特LLaMA1-7B的38.4(FP16: 34.6)18.6,超過4比特LLaMA2-7B的43.9(FP16: 45.5)13.1。這表明在LLaMA3時代需要一種新的LoRA-FT量化范式。

在CommonSenseQA基準測試中也出現了類似的現象。與沒有使用LoRA-FT的4比特對應版本相比,使用QLoRA和IR-QLoRA微調的模型性能也有所下降(例如,QLoRA平均下降2.8% vs IR-QLoRA平均下降2.4%)。這進一步展示了在LLaMA3中使用高質量數據集的優勢,而且通用數據集Alpaca并沒有對模型在其他任務中的性能作出貢獻。

結論

這篇論文全面評估了LLaMA3在各種低比特量化技術(包括訓練后量化和LoRA微調量化)中的性能。

此研究發現表明,盡管LLaMA3在量化后仍然展現出優越的性能,但與量化相關的性能下降是顯著的,甚至在許多情況下可以導致更大的下降。

這一發現突顯了在資源受限環境中部署LLaMA3可能面臨的潛在挑戰,并強調了在低比特量化背景下增長和改進的充足空間。通過解決低比特量化引起的性能下降,預期后續的量化范式將使LLMs在較低的計算成本下實現更強的能力,最終推動代表性的生成式人工智能達到新的高度。

論文鏈接:https://arxiv.org/abs/2404.14047。

項目鏈接:https://github.com/Macaronlin/LLaMA3-Quantizationhttps://huggingface.co/LLMQ。