模糊圖像重建重大進展!DeblurGS:相機位姿不準也能極致渲染!

本文經自動駕駛之心公眾號授權轉載,轉載請聯系出處。

寫在前面&筆者的個人理解

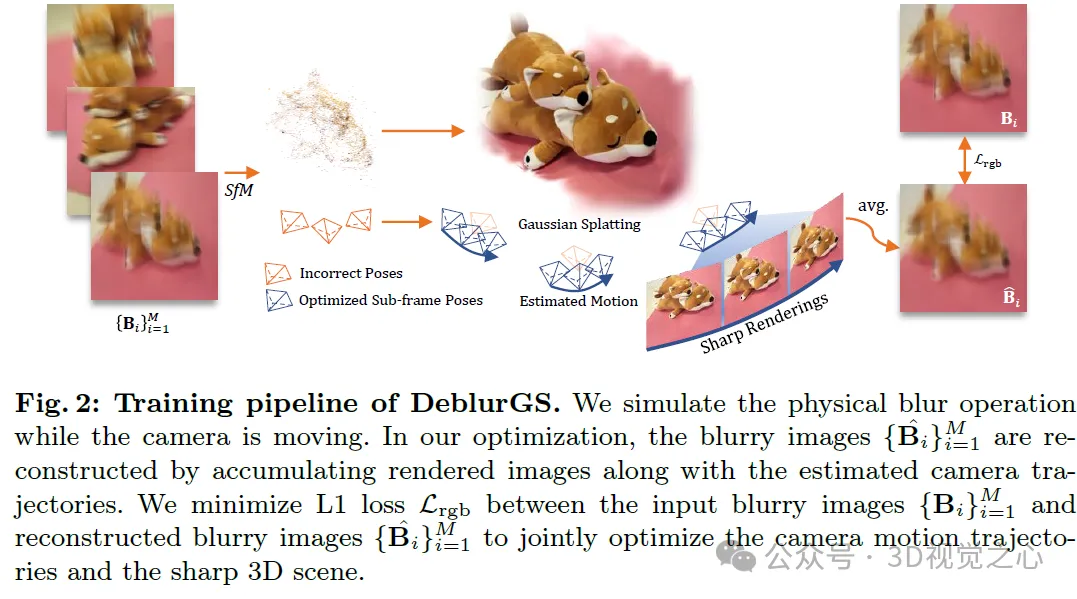

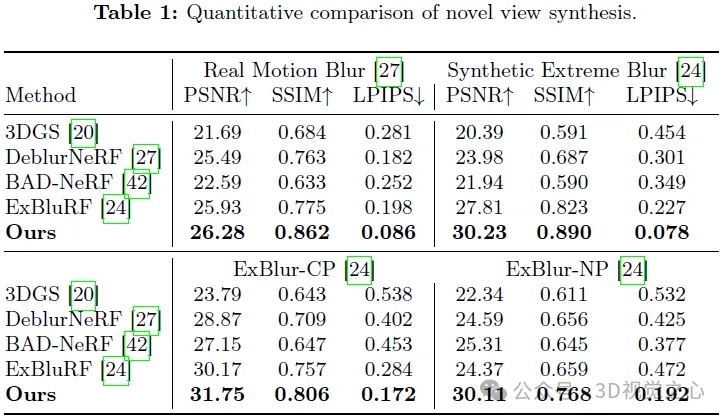

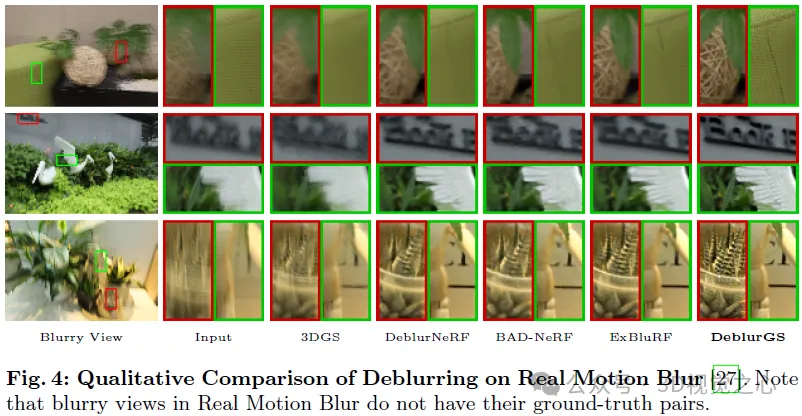

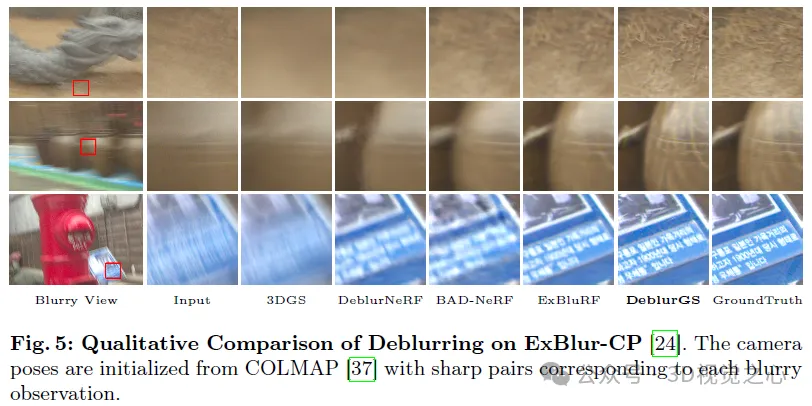

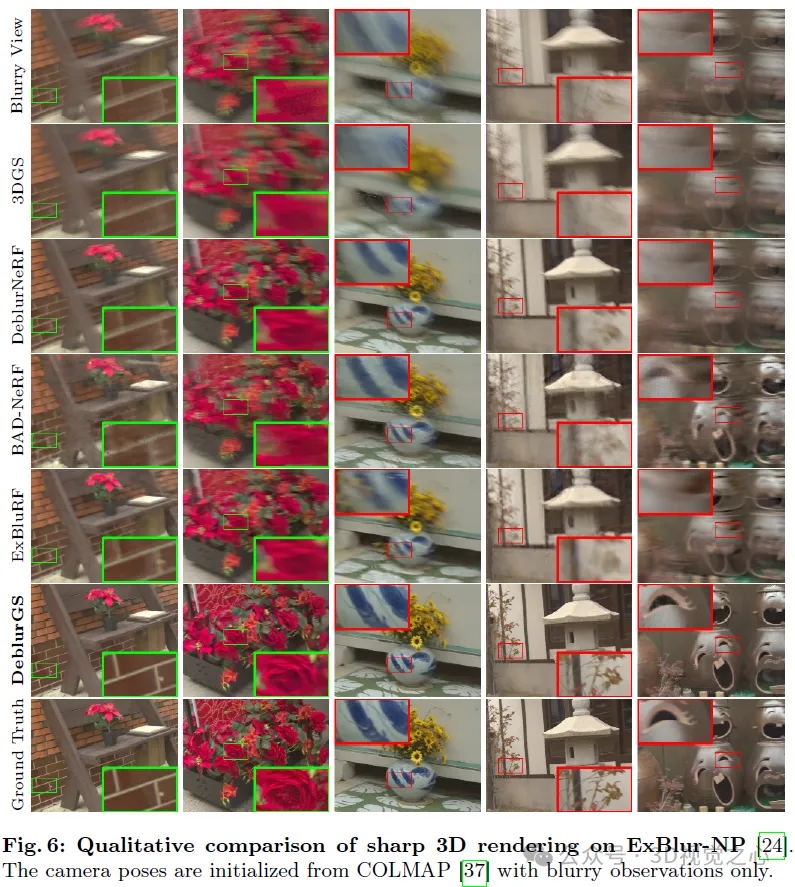

盡管在從運動模糊圖像中重建清晰的3D場景方面取得了重大進展,但向現實世界應用的過渡仍然具有挑戰性。主要障礙源于嚴重的模糊,這導致通過“Structure-from-Motion”獲取初始相機位姿的不準確,這是以前的方法經常忽略的一個關鍵方面。為了應對這一挑戰,我們提出了DeblurGS,這是一種從運動模糊圖像中優化清晰的3D GS的方法,即使在有噪聲的相機位姿初始化的情況下也是如此。我們通過利用3D GS的卓越重建能力來恢復細粒度的清晰場景。DeblurGS估計每個模糊觀測的6自由度相機運動,并為優化過程合成相應的模糊渲染。此外,我們提出了高斯密集退火策略,以防止在相機運動仍然不精確的早期訓練階段,在錯誤的位置產生不精確的高斯。綜合實驗表明,我們的DeblurGS在真實世界和合成基準數據集以及現場捕捉的模糊視頻的去模糊和新穎視圖合成方面實現了最先進的性能。

總結來說,DeblurGS的主要貢獻如下:

- 我們提出了DeblurGS,這是第一個從運動模糊圖像中優化清晰3D場景的3D GS管道。

- 我們采用高斯密集退火策略來優化輸入模糊圖像的噪聲初始相機位姿。

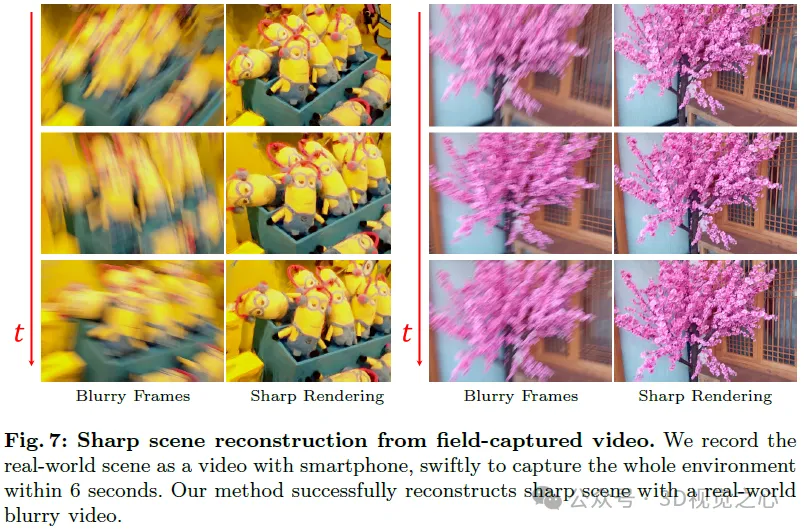

- 我們通過對現場拍攝的、快速移動的真實世界視頻進行實驗,展示了DeblurGS的實用性。

相關工作回顧

圖像去模糊圖像去模糊是圖像恢復領域的基本任務之一。從模糊輸入中恢復清晰圖像的傳統深度學習方法是CNN或基于變換器的監督學習。然而,這些方法需要大量的訓練數據與清晰的地面實況圖像配對,并且去模糊的質量取決于數據的規模。此外,由于領域差距問題,這些方法往往難以在不同條件下進行泛化,這使得它們在不同的現實世界場景中的性能不一致。相比之下,我們的DeblurGS框架偏離了傳統的數據驅動范式,消除了對由大規模數據集訓練的預訓練網絡的需求,并且本質上不受領域差距問題的影響。

NeRF和3D GS:NeRF由于其照片逼真的視圖合成結果而在3D視覺領域引起了極大的關注。NeRF的核心策略是利用可微體渲染技術優化神經隱式表示。幾種后續方法旨在提高渲染質量,而該研究的其他分支致力于減輕NeRF框架耗時的訓練和渲染速度],將渲染速度提高幾個數量級。最近,3DGS增強了輻射場模型的變體,并實現了詳細的重建性能和實時渲染速度。通過用高效且具有確定性的光柵化取代NeRF的光線行進,3DGS在不損失視覺質量的情況下實現了實時渲染。我們的DeblurGS還建立在3DGS管道上,用于從模糊的觀察中恢復潛在清晰場景的細粒度模式,并執行重建場景的實時渲染。

模糊的3D重建:最近,基于NeRF的去模糊方法試圖從模糊的多視圖圖像中重建清晰的3D場景。基于NeRF的方法將每個圖像的模糊操作與解釋所有模糊輸入的清晰3D場景聯合優化。DeblurNeRF和DP-NeRF采用2D逐像素模糊核估計器,BADNeRF和ExBluRF直接估計每個輸入圖像的相機軌跡。盡管有令人印象深刻的新穎視圖合成和去模糊性能,但基于NeRF的方法仍面臨著從不準確的初始姿態優化場景的挑戰,這是一個自然的假設,考慮到如果給出模糊視圖,SfM管道會估計錯誤的相機位姿。我們的DeblurGS通過采用高斯密集退火策略,從錯誤姿勢中恢復清晰的3D場景。

DeblurGS簡介

我們介紹了DeblurGS,這是一種從相機運動模糊圖像中優化基于清晰高斯飛濺的3D場景的方法。考慮到由于相機運動而模糊的多視圖觀察,我們的目標是恢復清晰的3D場景。為此,我們采用3DGS作為場景表示,以細粒度細節實現3D場景的真實感恢復,并結合潛在的相機運動對3DGS進行聯合優化。我們在第3.1節中簡要介紹了3DGS。接下來,我們在第3.2節中介紹了一種模糊視圖合成方法,該方法通過估計相機運動并根據近似運動累積子幀渲染。我們在第3.3節中介紹了優化過程,重點介紹了從錯誤姿態進行優化的高斯密集退火策略。最后,我們在第3.4節中推導了優化的損失項。我們在圖2中提供了訓練的概述。

Blurry View Synthesis

我們的目標是使用給定的運動模糊輸入來優化清晰的高斯飛濺。從物理上講,相機運動模糊是由相機運動過程中的輻照度積分產生的,如手抖或顫抖。因此,模糊圖像的獲取由曝光時間內時變6自由度相機位姿的輻照度的積分表示。

我們估計了解釋運動模糊的6自由度相機軌跡,以準確模擬方程(4)中描述的模糊操作。根據ExBluRF,我們用李代數空間se(3)中的Bézier曲線對相機的剛性運動進行參數化。然而,我們發現,即使我們使用Bézier曲線準確估計相機軌跡,由于相機姿態沿軌跡的采樣位置不同,模糊圖像也不是唯一合成的,如圖3所示。因此,我們定義了子幀對齊參數,該參數校準估計軌跡上的每個相機姿勢,以與時間t處的潛在相機姿勢對齊:

我們使用等式4應用對準參數的定義來公式化運動模糊圖像B:

Optimization from Inaccurate Poses

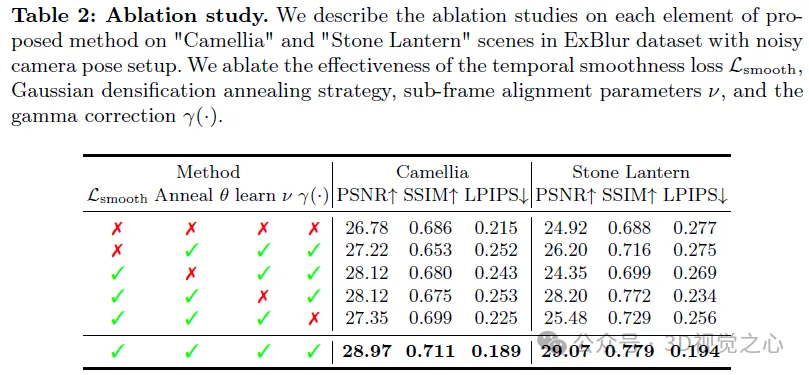

高斯密集退火:由于傳統的特征匹配算法是對模糊圖像中的噪聲特征進行的,因此COLMAP獲得的初始姿態是錯誤的。考慮到不準確的初始姿態,相機運動的聯合估計會導致在優化的早期階段在不正確的位置產生高斯。具體而言,如果相對于高斯位置的梯度超過致密化閾值θ,則高斯被一分為二。因此,處于錯誤位置的高斯試圖擬合來自錯誤位置的訓練圖像,從而破壞了優化過程。為了防止在不正確的位置產生過早的高斯分裂,我們采用了致密化閾值θ的退火策略。我們從較高的初始θ逐漸退火θ,當相機運動充分優化時,可以實現更精細的致密化。θ的退火策略在場景試圖通過致密化來表示精細細節之前,優先考慮相機運動的精確優化,從而減輕高斯在錯誤位置造成的干擾。

Loss Functions

重建損失:

Temporal Smoothness Loss:

整體損失

實驗

結論

本文提出了DeblurGS,一種從運動模糊圖像集合中重建清晰3D場景的方法。我們模擬相機運動以合成模糊視圖,并通過最小化給定模糊觀察和生成的模糊之間的距離來優化3D高斯散射。通過我們的高斯密集退火策略,相機運動收斂于潛在的相機運動,甚至從嘈雜的相機姿勢初始化,這是模糊觀測的SfM的自然結果。從不精確的姿勢進行優化的能力突出了我們框架的實用性,展示了用智能手機拍攝的視頻的成功去模糊。DeblurGS在清晰的3D場景重建任務中優于所有現有方法,在實驗和實際環境中都達到了最先進的水平。