牛津大學最新!Mickey:3D中的2D圖像匹配SOTA!(CVPR'24)

本文經自動駕駛之心公眾號授權轉載,轉載請聯系出處。

寫在前面

項目鏈接:https://nianticlabs.github.io/mickey/

給定兩張圖像,可以通過建立圖像間的對應關系來估計它們之間的相機相對姿態。通常,這些對應關系是二維到二維的,而我們估計的姿態在尺度上是不確定的。一些應用,例如隨時隨地實現即時增強現實,需要尺度度量的姿態估計,因此它們依賴于外部的深度估計器來恢復尺度。

本文提出了MicKey,這是一個關鍵點匹配流程,能夠預測三維相機空間中的度量對應關系。通過學習跨圖像的三維坐標匹配,我們能夠在沒有深度測量的情況下推斷出度量相對姿態。訓練過程中也不需要深度測量,也不需要場景重建或圖像重疊信息。MicKey僅通過圖像對及其相對姿態進行監督。MicKey在無需地圖的重新定位基準測試中取得了最先進的性能,同時所需的監督少于其他競爭方法。

Metric Keypoints(MicKey)是一個特征檢測流程,解決了兩個問題。首先,MicKey回歸相機空間中的關鍵點位置,這允許通過描述符匹配建立度量對應關系。從度量對應關系中,可以恢復度量相對姿態,如圖1所示。其次,通過使用可微分的姿態優化進行端到端的訓練,MicKey僅需要圖像對及其真實相對姿態進行監督。在訓練過程中不需要深度測量。MicKey隱式地學習關鍵點的正確深度,并且僅對實際找到且準確的特征區域進行學習。我們的訓練過程對視覺重疊未知的圖像對具有魯棒性,因此,通常通過SFM獲得的信息(如圖像重疊)是不需要的。這種弱監督使得MicKey非常易于訪問和吸引人,因為在新領域上訓練它不需要除了姿態之外的任何額外信息。

在無需地圖的重新定位基準測試中,MicKey名列前茅,超越了最近最先進的方法。MicKey提供了可靠的尺度度量姿態估計,即使在由特定針對稀疏特征匹配的深度預測所支持的極端視角變化下也是如此。

主要貢獻如下:

1)一個神經網絡MicKey,它可以從單張圖像中預測度量三維關鍵點和它們的描述符,從而允許在圖像對之間估計度量相對姿態。

2)一種端到端的訓練策略,它只需要相對姿態監督,因此,在訓練過程中既不需要深度測量,也不需要關于圖像對重疊的知識。

MicKey介紹

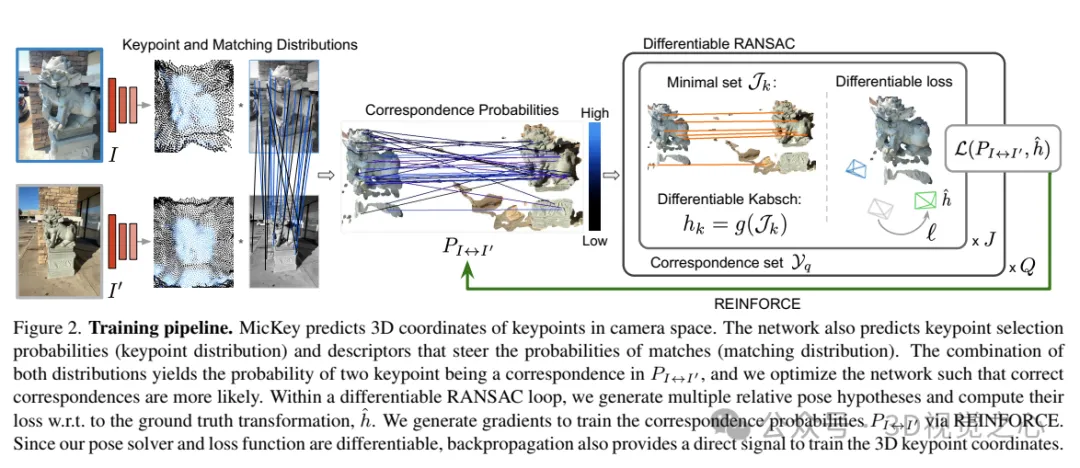

MicKey預測相機空間中關鍵點的三維坐標。網絡還預測關鍵點的選擇概率(關鍵點分布)和描述符,這些描述符引導匹配的概率(匹配分布)。將這兩種分布結合起來,得到了在中兩個關鍵點成為對應點的概率,并優化網絡,使得正確的對應點更有可能出現。在一個可微分的RANSAC循環中,生成多個相對姿態假設,并計算它們相對于真實變換的損失。通過REINFORCE生成梯度來訓練對應概率。由于我們的姿態求解器和損失函數是可微分的,反向傳播也為訓練三維關鍵點坐標提供了直接信號。

1)度量pose監督的學習

給定兩張圖像,計算它們的度量相對姿態,以及關鍵點得分、匹配概率和姿態置信度(以軟內點計數形式)。我們的目標是以端到端的方式訓練所有相對姿態估計模塊。在訓練過程中,我們假設訓練數據為,其中是真實變換,K/K'是相機內參。整個系統的示意圖如圖2所示。

為了學習三維關鍵點的坐標、置信度和描述符,我們需要系統是完全可微分的。然而,由于pipeline中的一些元素不是可微分的,例如關鍵點采樣或內點計數,重新定義了相對姿態估計管道為概率性的。這意味著我們將網絡的輸出視為潛在匹配的概率,在訓練過程中,網絡優化其輸出以生成概率,使得正確的匹配更有可能被選中。

2)網絡結構

MicKey遵循具有共享編碼器的多頭網絡架構,該編碼器可推斷3D度量關鍵點以及來自輸入圖像的描述符,如圖3所示。

編碼器。采用預訓練的DINOv2模型作為特征提取器,并在不進行進一步訓練或微調的情況下直接使用其特征。DINOv2將輸入圖像劃分為大小為14×14的塊,并為每個塊提供一個特征向量。最終的特征圖F具有(1024, w, h)的分辨率,其中w = W/14,h = H/14。

關鍵點Head。這里定義了四個并行Head,它們處理特征圖F并計算xy偏移量(U)、深度(Z)、置信度(C)和描述符(D)映射;其中映射的每個條目對應于輸入圖像中的一個14×14的block。MicKey具有一個罕見的特性,即預測關鍵點作為稀疏規則網格的相對偏移量。獲得絕對2D坐標如下:

實驗對比

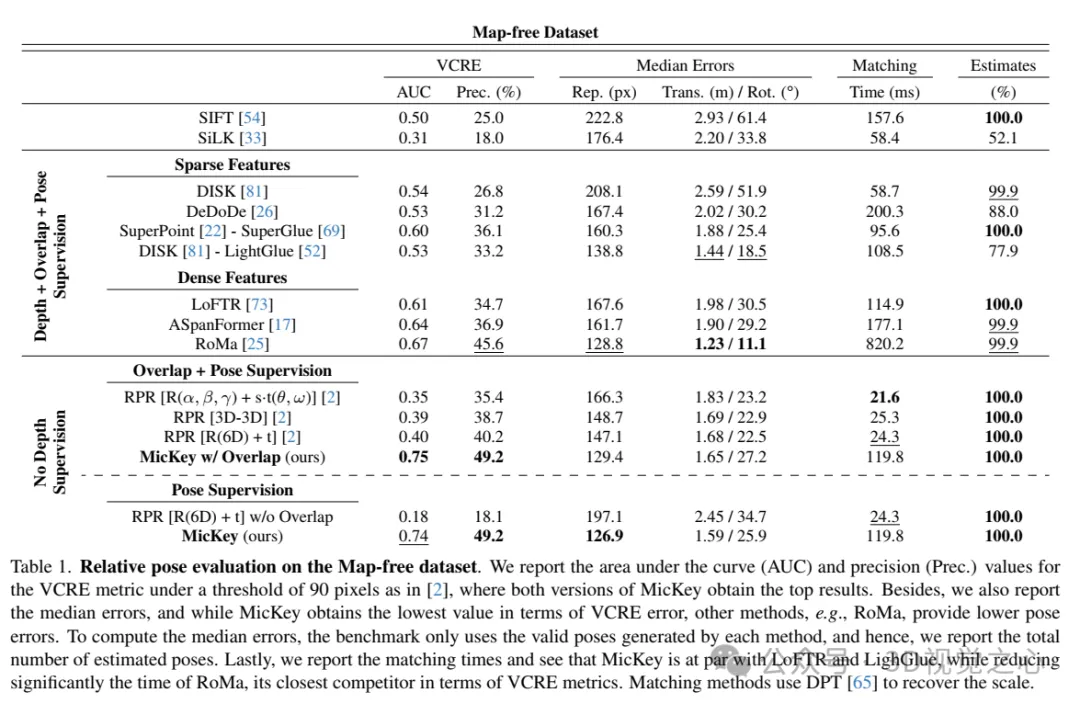

在無地圖數據集上的相對姿態評估。報告了在90像素閾值下的VCRE指標的曲線下面積(AUC)和精度(Prec.)值,MicKey的兩個版本都獲得了最高結果。此外,還報告了中位誤差,雖然MicKey在VCRE誤差方面獲得了最低值,但其他方法,例如RoMa,提供了更低的姿態誤差。為了計算中位誤差,基準僅使用每種方法生成的有效姿態,因此,我們報告了估計的總姿態數。最后,報告了匹配時間,并發現MicKey與LoFTR和LighGlue相當,同時顯著減少了RoMa的時間,RoMa是VCRE指標方面最接近MicKey的競爭對手。匹配方法使用DPT 來恢復尺度。

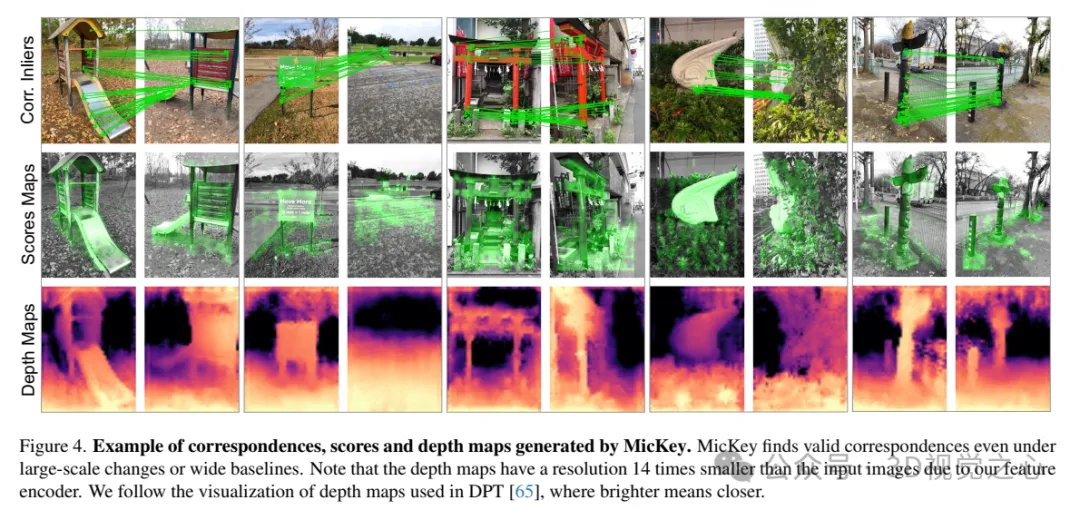

MicKey生成的對應點、得分和深度圖的示例。MicKey即使在大規模變化或寬基線的情況下也能找到有效的對應點。請注意,由于我們的特征編碼器,深度圖的分辨率比輸入圖像小14倍。我們遵循DPT 中使用的深度圖可視化方法,其中較亮的顏色表示較近的距離。

在ScanNet數據集上的相對姿態評估。所有特征匹配方法都與PlaneRCNN 結合使用,以恢復度量尺度。我們標明了每種方法的訓練信號:深度(D)、重疊分數(O)和姿態(P)。