谷歌發(fā)布“Vlogger”模型:單張圖片生成10秒視頻

谷歌發(fā)布了一個新的視頻框架:

只需要一張你的頭像、一段講話錄音,就能得到一個本人栩栩如生的演講視頻。

視頻時長可變,目前看到的示例最高為10s。

可以看到,無論是口型還是面部表情,它都非常自然。

如果輸入圖像囊括整個上半身,它也能配合豐富的手勢:

網友看完就表示:

有了它,以后咱開線上視頻會議再也不需要整理好發(fā)型、穿好衣服再去了。

嗯,拍一張肖像,錄好演講音頻就可以(手動狗頭)

用聲音控制肖像生成視頻

這個框架名叫VLOGGER。

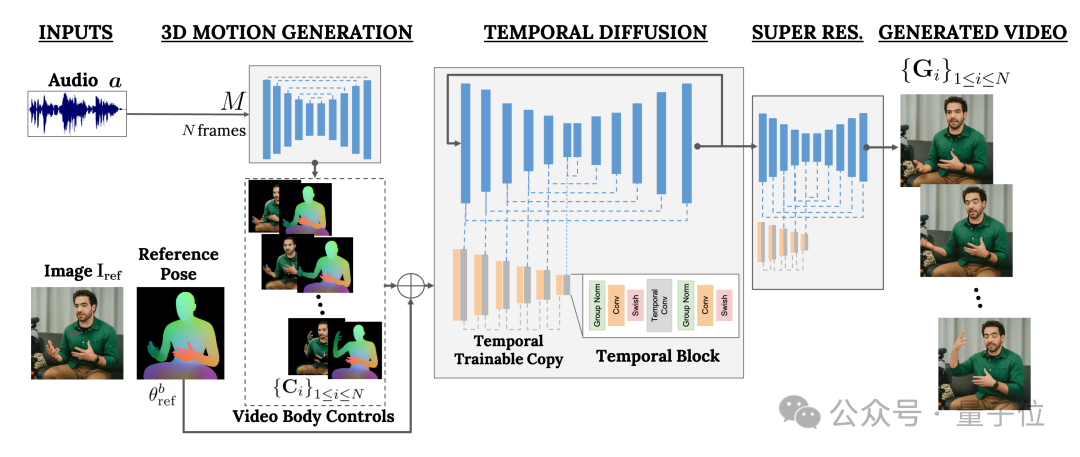

它主要基于擴散模型,并包含兩部分:

一個是隨機的人體到3D運動(human-to-3d-motion)擴散模型。

另一個是用于增強文本到圖像模型的新擴散架構。

其中,前者負責將音頻波形作為輸入,生成人物的身體控制動作,包括眼神、表情和手勢、身體整體姿勢等等。

后者則是一個時間維度的圖像到圖像模型,用于擴展大型圖像擴散模型,使用剛剛預測的動作來生成相應的幀。

為了使結果符合特定的人物形象,VLOGGER還將參數(shù)圖像的pose圖作為輸入。

VLOGGER的訓練是在一個超大的數(shù)據(jù)集(名叫MENTOR)上完成的。

有多大?全長2200小時,共包含80萬個人物視頻。

其中,測試集的視頻時長也有120小時長,共計4000個人物。

谷歌介紹,VLOGGER最突出的表現(xiàn)是具備多樣性:

如下圖所示,最后的像素圖顏色越深(紅)的部分,代表動作越豐富。

而和業(yè)內此前的同類方法相比,VLOGGER最大的優(yōu)勢則體現(xiàn)在不需要對每個人進行訓練、也不依賴于面部檢測和裁剪,并且生成的視頻很完整(既包括面部和唇部,也包括肢體動作)等等。

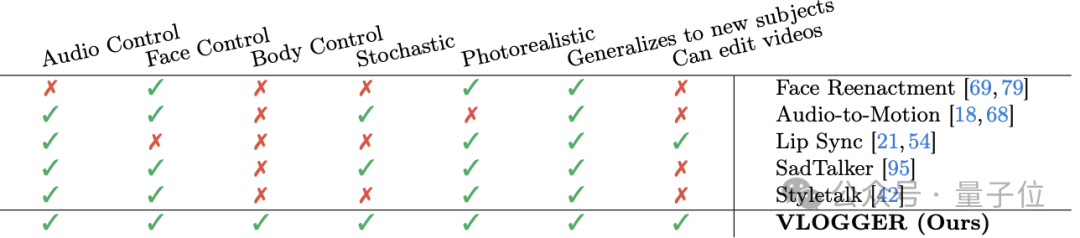

具體來看,如下表所示:

Face Reenactment方法無法用音頻和文本來控制此類視頻生成。

Audio-to-motion倒是可以音頻生成,方式也是將音頻編碼為3D人臉動作,不過它生成的效果不夠逼真。

Lip sync可以處理不同主題的視頻,但只能模擬嘴部動作。

對比起來,后面的兩種方法SadTaker和Styletalk表現(xiàn)最接近谷歌VLOGGER,但也敗在了不能進行身體控制上,并且也不能進一步編輯視頻。

說到視頻編輯,如下圖所示,VLOGGER模型的應用之一就是這個,它可以一鍵讓人物閉嘴、閉眼、只閉左眼或者全程睜眼:

另一個應用則是視頻翻譯:

例如將原視頻的英語講話改成口型一致的西班牙語。

網友吐槽

最后,“老規(guī)矩”,谷歌沒有發(fā)布模型,現(xiàn)在能看的只有更多效果還有論文。

嗯,吐槽也是不少的:

畫質模型、口型抽風對不上、看起來還是很機器人等等。

因此,有人毫不猶豫打上差評:

這就是谷歌的水準嗎?

有點對不起“VLOGGER”這個名字了。

——和OpenAI的Sora對比,網友的說法確實也不是沒有道理。。

大家覺得呢?

更多效果:https://enriccorona.github.io/vlogger/

完整論文:https://enriccorona.github.io/vlogger/paper.pdf