撰稿 | 云昭

出品 | 51CTO技術棧(微信號:blog51cto)

近日,市場有消息稱,在Sora引爆文生視頻賽道之前,國內的字節跳動也推出了一款新型視頻模型Boximator,與Gen-2、Pink1.0等既有模型相比,Boximator的獨特之處在于,它能夠通過文本輸入精確地控制視頻中人物或物體的運動。

有媒體稱將之稱為中國版的Sora,對此,字節跳動相關人士回復稱,Boximator是視頻生成領域控制對象運動的技術方法研究項目,目前還無法作為完善的產品落地,距離國外領先的視頻生成模型在畫面質量、保真率、視頻時長等方面還有很大差距。

1、為何會被誤解讀成中文版Sora解析模型的厲害之處

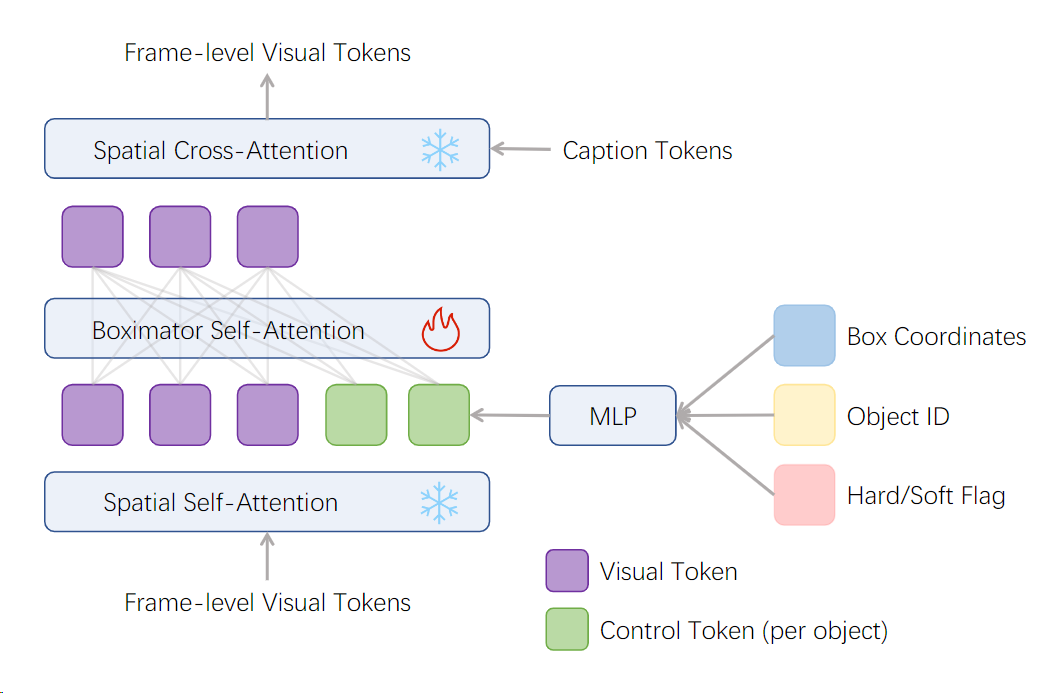

Boximator是建立在視頻擴散模型之上的,它采用了3D U-Net架構。簡單講,3D U-Net架構由交替的卷積塊和注意力塊構成。每個塊包括兩個組件:一個是空間組件,將單個視頻幀作為單獨的圖像處理;另一個是時間組件,實現跨幀的信息交換。

而在每個注意力塊中,空間組件通常包括一個自注意力層,然后是一個交叉注意力層,后者用于根據文本提示進行生成。

圖片

圖片

Boximator的厲害之處,他們賦予了現有的視頻擴散模塊運動控制能力。怎么做到的呢?

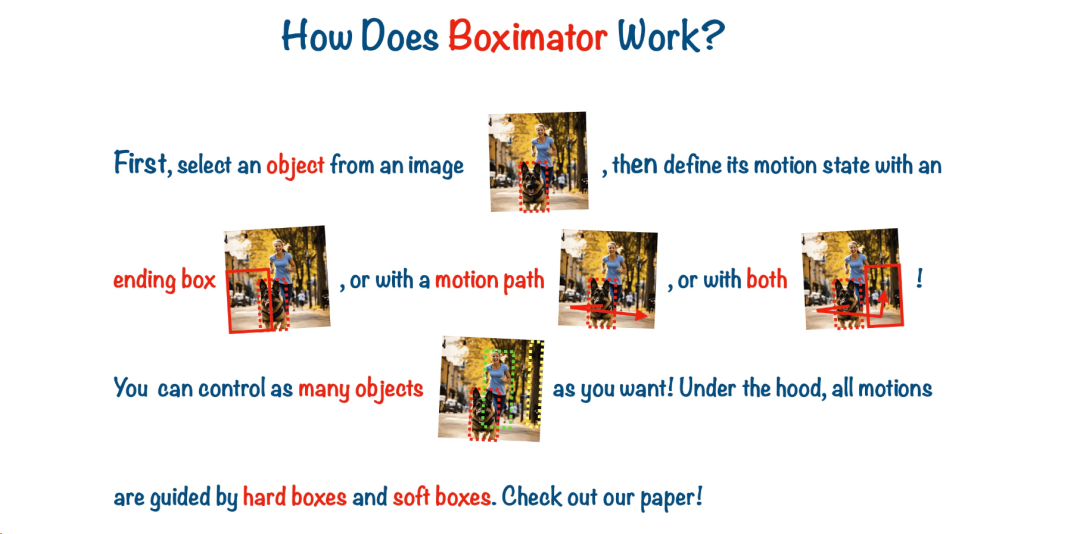

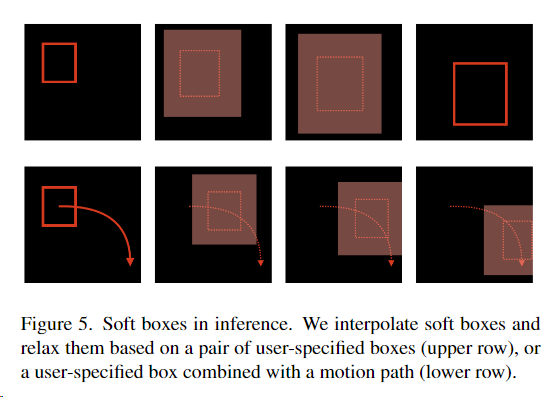

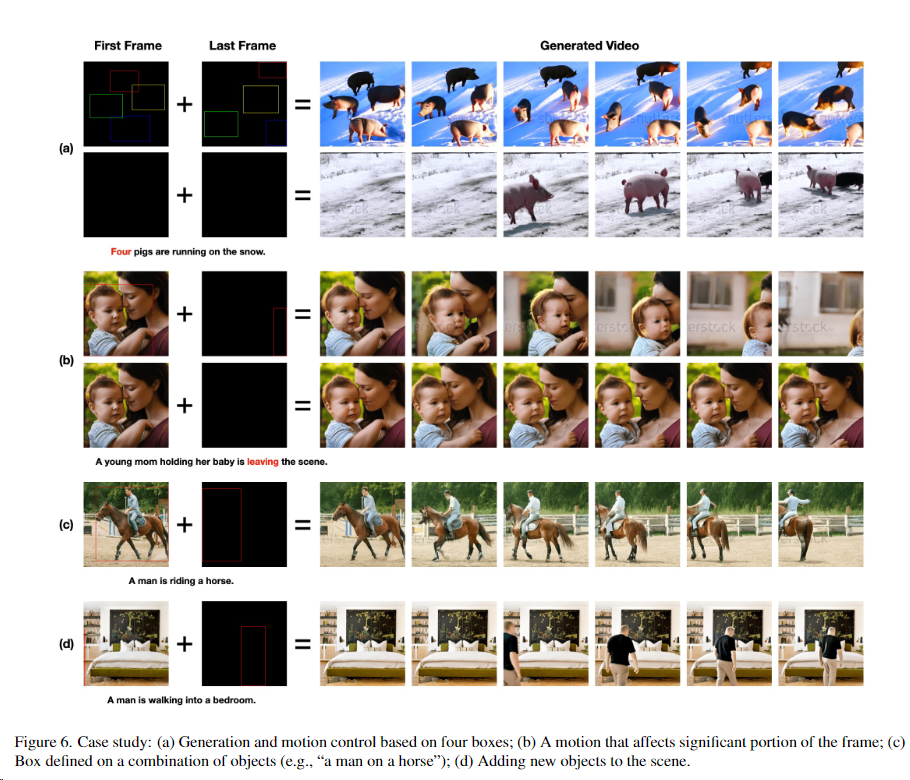

首先,為了實現對視頻中物體、人物的動作控制,Boximator 使用了“軟框”和“硬框”兩種約束方法。

其中,硬框,精確定義了目標對象的邊界框,有了它,用戶可以在圖片中畫出感興趣的對象,Boximator 會將其視為硬框約束, 在之后的幀中精準定位該對象的位置。

而,軟框則定義一個對象可能存在的區域, 形成一個寬松的邊界框。對象需要停留在這個區域內, 但位置可以有一定變化,實現適度的隨機性。

兩類框都包含目標對象的 ID, 用于在不同幀中跟蹤同一對象。此外, 框還包含坐標、類型等信息的編碼。

圖片

圖片

其次,在原有兩個注意力層之上,Boximator通過添加一個新的自我關注層(Spatial Self-attention)來增強這個堆棧。

參數方面,團隊考慮到基礎模型是在大量網絡規模的圖像和視頻上預先訓練的,已經獲得了不錯的通用知識能力,所以對原始模型的參數進行了凍結,只專注于訓練新調整用途的運動控制模塊。

當然這只是模型層面的區別,還有數據、訓練、算法、推理層面的重要改進,比如自追蹤技術、多階段訓練處理,都是相關研究人員值得借鑒的技術,這里不再展開介紹。感興趣的朋友可以查閱論文。

圖片

圖片

圖片

圖片

2、視頻實驗講究之處:數據,還是數據

基準模型方面,字節團隊選取了兩個:PixelDance 和 ModelScope,來訓練 Boximator。

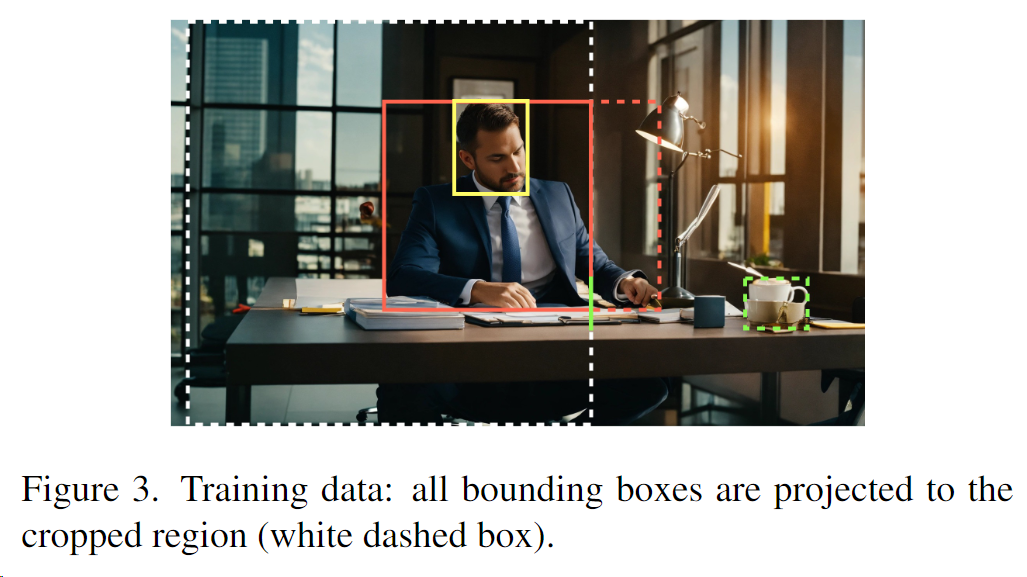

訓練數據方面,研究人員從 WebVid-10M 數據集中,過濾出 110 萬段動態明顯的視頻片段, 并自動為其注釋了 220 萬個對象的邊界框,注釋的描述包含了視頻中對象的名詞短語,如“年輕男子”或“白色襯衫”。

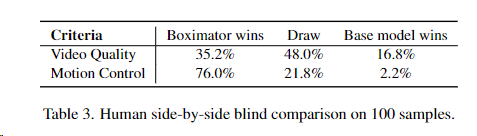

實驗結果顯示,在 MSR-VTT 數據集上, 無論是視頻質量還是框與對象對齊精度面,Boximator 都優于原模型。在人類評估中,Boximator 生成的視頻也在質量和運動控制上明顯超過原模型。

圖片

圖片

圖片

圖片

在Github上呈現的效果視頻來看,Boximator 在保持原模型視頻質量, 具有非常強大的動作控制能力。同時可以作為一種插件,幫助現有視頻擴散模型提升生成質量。

3、新視頻產品即將推出

1月30日,梁汝波罕見的批評了字節的大公司病,主要就是兩點:效率低下、對機會敏感度降低,對此梁語氣非常沉重:“公司層面的半年度技術回顧,直到2023年才開始討論GPT,而業內做得比較好的大模型創業公司都是在2018年至2021年創立的。”

入場晚,也有著晚的資本。字節集團從飛書、抖音等各個事業部抽調人選,到這個全新的AI部門Flow開發新的C端產品。

現在字節有不少可圈可點的AI產品已經問世。基于抖音、火山等頭條系產品,豆包、扣子的應用也賺得市場不錯的口碑。

字節其實一直有著AI的基因,張一鳴也是AI的極度推崇者。回望過去的2023,字節對于生成式AI的布局繁多,且力度不小。

只不過,在視頻領域,似乎隨著Sora的刷屏,字節進一步意識到了王者地位被顛覆的危機。這很難不讓人聯想到春節前的那場變動,抖音前CEO張楠轉崗剪映。

雖然本文的Boximator還只是實驗研究,尚未落地,但此前就有消息傳出:據說本月剪映將會推出一個AI生圖和視頻的產品,大家拭目以待吧。

PS:對Boximator感興趣的朋友,可以發送郵件給論文作者的郵箱,開通體驗申請:wangjiawei.424@bytedance.com。

參考鏈接:

https://arxiv.org/abs/2402.01566

https://boximator.github.io/

https://zhuanlan.zhihu.com/p/682140112