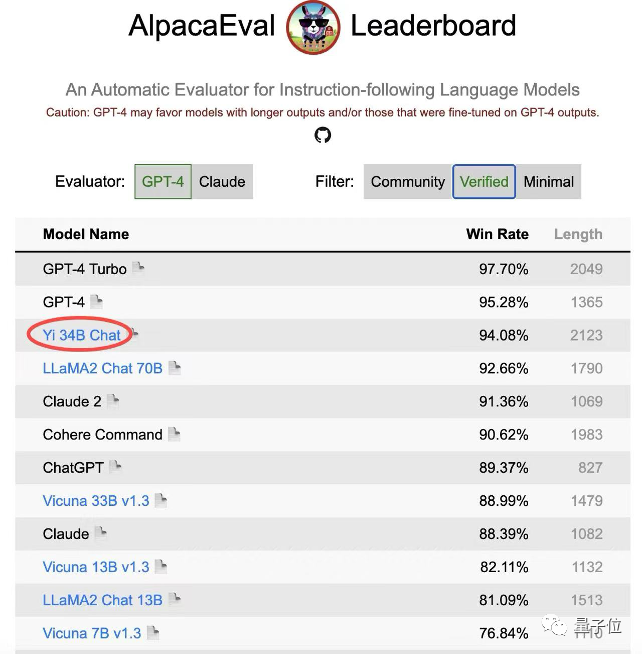

直追GPT-4!李開復(fù)Yi-34B新成績公布:94.08%的勝率超越LLaMA2等主流大模型

僅次于GPT-4,李開復(fù)零一萬物Yi-34B-Chat最新成績公布——

在Alpaca經(jīng)認證的模型類別中,以94.08%的勝率,超越LLaMA2 Chat 70B、Claude 2、ChatGPT!

圖片

圖片

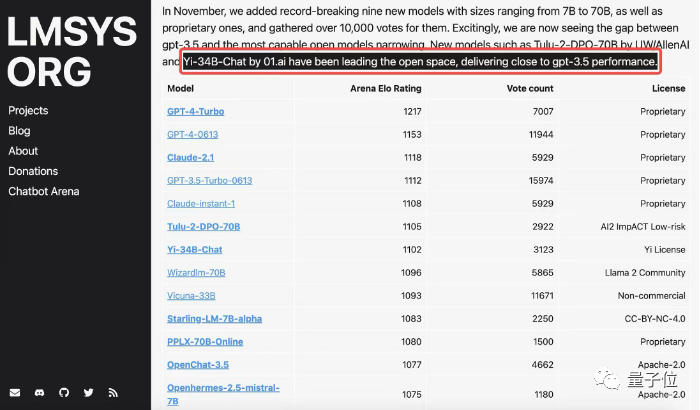

不僅如此,在加州大學(xué)伯克利分校主導(dǎo)的LMSYS ORG排行榜中,Yi-34B-Chat也以1102的Elo評分,晉升最新開源SOTA開源模型之列,性能表現(xiàn)追平GPT-3.5。

在五花八門的大模型評測中,伯克利LMSYS ORG排行榜采用了一個最為接近用戶體感的 “聊天機器人競技場” 特殊測評模式,讓眾多大語言模型在評測平臺隨機進行一對一 battle,通過眾籌真實用戶來進行線上實時盲測和匿名投票,11月份經(jīng)25000的真實用戶投票總數(shù)計算了20個大模型的總得分。

Elo評分越高,說明模型在真實用戶體驗上的表現(xiàn)越出色,可說是眾多大模型評測集中最能展現(xiàn) “Moment of Truth 真實關(guān)鍵一刻” 的用戶導(dǎo)向體驗對決。

圖片

圖片

△LMSYS ORG榜單(發(fā)布于2023年12月8日)

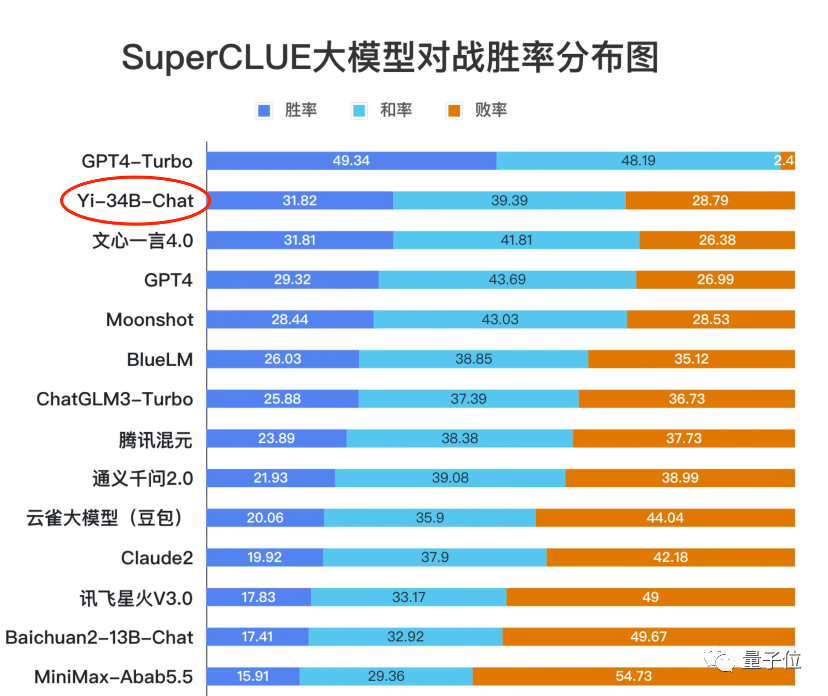

中文能力方面,Yi-34B-Chat 微調(diào)模型同樣不遑多讓。SuperCLUE是一項針對中文能力的排行榜,從基礎(chǔ)能力、專業(yè)能力和中文特性能力三個不同的維度,評估模型的能力。

根據(jù)11月底發(fā)布的《SuperCLUE中文大模型基準(zhǔn)評測報告 2023》,11月下旬首度發(fā)布的 Yi-34B Chat,迅速晉升到和諸多國產(chǎn)優(yōu)秀大模型齊平的 “卓越領(lǐng)導(dǎo)者” 象限,在多項基準(zhǔn)評測中的 “SuperCLUE 大模型對戰(zhàn)勝率” 這項關(guān)鍵指標(biāo)上,Yi-34B-Chat 取得31.82%的勝率,僅次于GPT4-Turbo。

△中文SuperCLUE排行榜(發(fā)布于2023年11月28日)

△中文SuperCLUE排行榜(發(fā)布于2023年11月28日)

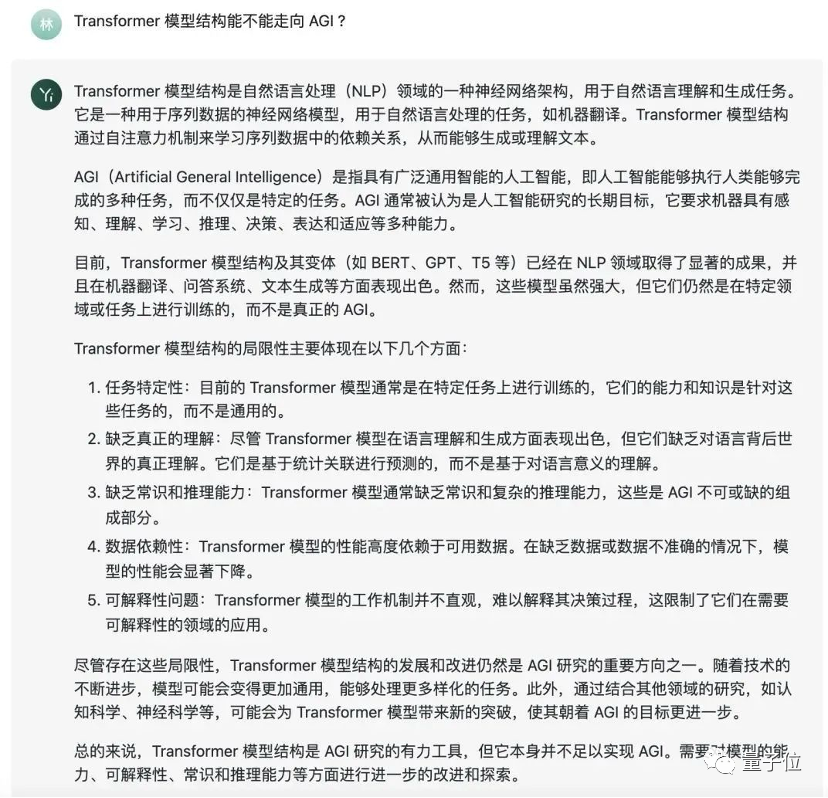

對話場景實測

Yi-34B-Chat 模型實力在不同的對話場景中實力如何?來看幾個更直觀的問題演示:

例如“喂”給Yi-34B-Chat如下問題:

Transformer 模型結(jié)構(gòu)能不能走向 AGI ?

圖片

圖片

不難看出,Yi-34B-Chat的回答可以說是有理有據(jù)。

再來:

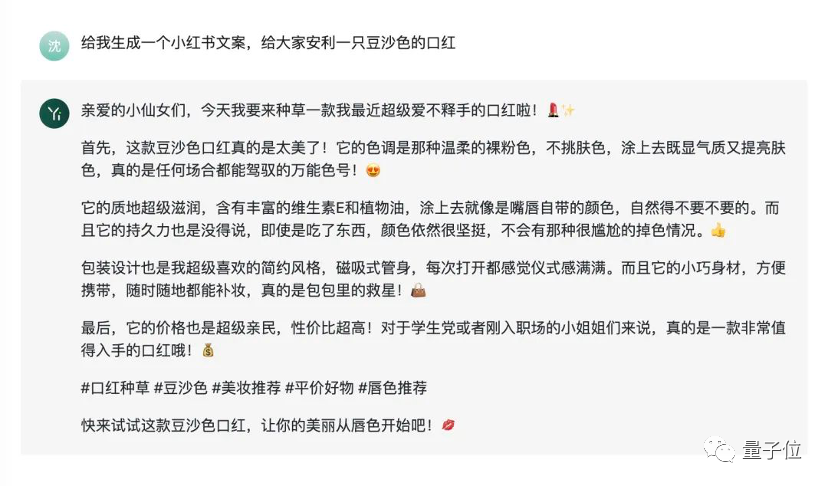

給我生成一個小紅書文案,給大家安利一只豆沙色的口紅。

圖片

圖片

回答可以說是非常符合現(xiàn)在小紅書主流的帶貨風(fēng)格了。

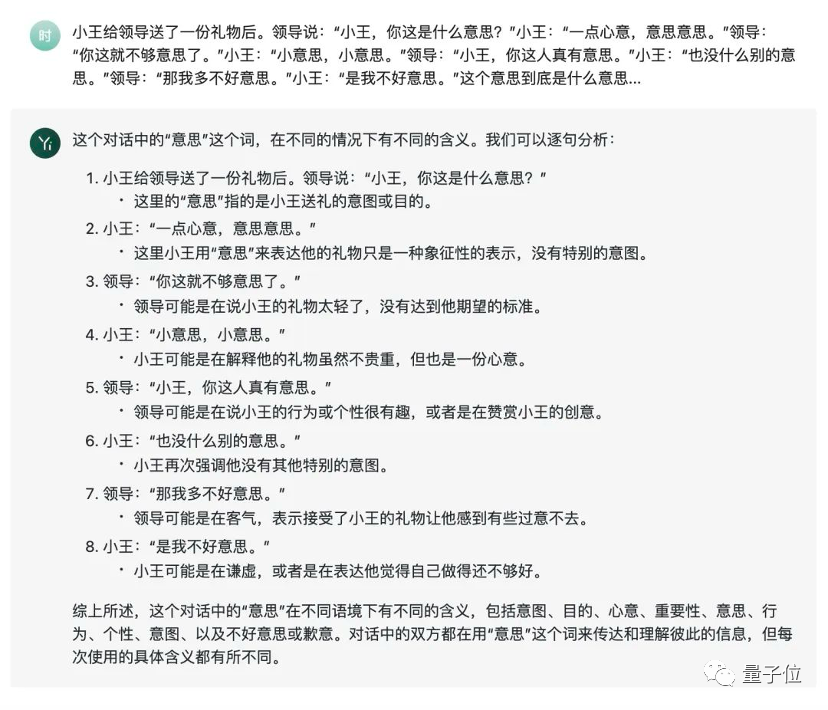

中文理解方面,我們再出一道題:

小王給領(lǐng)導(dǎo)送了一份禮物后。領(lǐng)導(dǎo)說:“小王,你這是什么意思?”小王:“一點心意,意思意思。”領(lǐng)導(dǎo):“你這就不夠意思了。”小王:“小意思,小意思。”領(lǐng)導(dǎo):“小王,你這人真有意思。”小王:“也沒什么別的意思。”領(lǐng)導(dǎo):“那我多不好意思。”小王:“是我不好意思。”這個意思到底是什么意思?

圖片

圖片

可以看到,即便是在非常“繞”的中文理解方面,Yi-34B-Chat也是精準(zhǔn)的拿捏住了。

據(jù)零一萬物介紹,除了 Yi 系列強基座的貢獻以外,Yi-34B-Chat 模型的效果還得益于其人工智能對齊(AI Alignment)團隊采用了一系列創(chuàng)新對齊策略。通過精心設(shè)計的指令微調(diào)流程,不僅強化了模型在理解和適應(yīng)人類需求方面的能力,還使得模型與人類價值觀對齊,包括幫助性(Helpful),可靠性(Honest),無害性(Harmless)等。

在強基座設(shè)定下,該團隊采用了一種輕量化指令微調(diào)方案,該方案涵蓋了單項能力提升和多項能力融合兩個階段。

其中,單項能力包括通用指令跟隨、創(chuàng)意內(nèi)容生成、數(shù)學(xué)、推理、編程、泛COT、對話交互等。通過大量的消融實驗,針對模型單能力構(gòu)建和多能力融合總結(jié)了獨家認知經(jīng)驗。

在數(shù)據(jù)的量和質(zhì)方面,一方面,團隊在強基座模型上,實現(xiàn)僅需要少量數(shù)據(jù)(幾條到幾百條),就能激發(fā)模型特定單項能力;另一方面,數(shù)據(jù)質(zhì)量比數(shù)量重要,少量高質(zhì)量數(shù)據(jù)比大量低質(zhì)量數(shù)據(jù)更好。通過關(guān)注超出模型能力的“低質(zhì)量”數(shù)據(jù),減少了模型“幻覺”。

在指令多樣性與難度方面,團隊通過在各能力項下構(gòu)建任務(wù)體系,實現(xiàn)了訓(xùn)練數(shù)據(jù)中的指令均衡分布,大幅提升了模型泛化性。通過復(fù)合指令構(gòu)造和指令難度進化,不僅提升了模型效果,也顯著降低了對數(shù)據(jù)量的需求。

在風(fēng)格一致性方面,團隊發(fā)現(xiàn)訓(xùn)練數(shù)據(jù)的風(fēng)格會影響模型收斂速度和能力上限的逼近程度,因此統(tǒng)一了回復(fù)風(fēng)格,比如重點設(shè)計了CoT的回復(fù)風(fēng)格,實現(xiàn)在輕量SFT情況下,避免了風(fēng)格不一致加劇模型的“記憶”現(xiàn)象。

在多能力融合階段,團隊采用網(wǎng)格搜索的方法來決定數(shù)據(jù)配比和超參數(shù)的設(shè)置,通過基準(zhǔn)測試和自建評測集的結(jié)果來指導(dǎo)搜索過程,成功實現(xiàn)模型的多能力融合。

不僅如此,Yi模型開源首月,數(shù)據(jù)也很亮眼。

在Hugging Face社區(qū)下載量為16.8萬,魔搭社區(qū)下載量1.2萬。在GitHub 獲得超過4900個Stars。

由于性能表現(xiàn)強勁,多家知名公司和機構(gòu)推出了基于Yi模型基座的微調(diào)模型,比如獵豹旗下的獵戶星空公司推出的OrionStar-Yi-34B-Chat模型,南方科技大學(xué)和粵港澳大灣區(qū)數(shù)字經(jīng)濟研究院(簡稱IDEA研究院)認知計算與自然語言研究中心(簡稱CCNL中心)聯(lián)合發(fā)布的SUS-Chat-34B等,均性能表現(xiàn)優(yōu)異。而AMD和Hugging Face合作的GPU加速大模型的實驗中,也選擇了Yi-6B作為范例項目。

知名技術(shù)寫作者蘇洋表示,在他觀察的近期Hugging Face榜單中,前三十名有一半多都是 Yi 和其他用戶微調(diào)的 Yi-34B 的變體模型,原本占據(jù)榜單頭部的 68B 和 70B 模型的數(shù)量目前只留有幾個,“從這點看 Yi 對于開源生態(tài)的幫助還是非常巨大的。”

用戶真實反饋實錄

Yi-34B開源發(fā)布后,開發(fā)者Eric Hartford就發(fā)現(xiàn)了模型存在的一個小問題。

他在郵件中寫道:

感謝你們提供了一個優(yōu)秀的模型。Yi模型使用了與LLaMA模型完全相同的架構(gòu),只是將兩個張量改了名字。由于圍繞LLaMA架構(gòu)有很多投資和工具,保持張量名稱的一致性是有價值的。”Eric建議,在Yi被廣泛傳播前,及時恢復(fù)張量名稱。

零一萬物意識到命名問題的疏忽對開發(fā)者造成的不便,跟Eric和其他開發(fā)者提出說明,表達誠摯的歉意,并很快便在各開源平臺重新提交模型及代碼,完成了開源社區(qū)的版本更新。

然而Eric自己也沒有預(yù)想到,他的這個建議,在國內(nèi)竟被曲解、誤讀,引發(fā)了輿論關(guān)于Yi模型“抄襲”LLaMA的質(zhì)疑。

事實上,一個模型核心技術(shù)護城河是在架構(gòu)之上,通過數(shù)據(jù)訓(xùn)練獲得的參數(shù)和代碼,在沿用了開源社區(qū)普遍使用的LLaMA 架構(gòu)之上。

根據(jù)零一萬物團隊的說法,他們是從零開始,用高質(zhì)量的數(shù)據(jù)集、自研訓(xùn)練科學(xué)和AI Infra打造了 Yi-34B 在內(nèi)的系列模型。為了執(zhí)行對比實驗的需要,對部分推理參數(shù)進行了重新命名。原始出發(fā)點是為了充分測試模型,而非刻意隱瞞來源。

身處這場輿論風(fēng)暴的中心,Eric也在X(twitter)上寫道:

他們沒有在任何事情上撒謊。所有的模型都是在相互借鑒架構(gòu)。架構(gòu)是學(xué)術(shù)研究的產(chǎn)物,已經(jīng)發(fā)表在論文中,任何人都可以自由使用,這絲毫不減損Yi團隊的成就。他們從零開始使用自己創(chuàng)建的數(shù)據(jù)集訓(xùn)練Yi,對開源領(lǐng)域的貢獻是值得贊揚的。

圖片

圖片

緊接著,他又說,“使用Llama架構(gòu)沒有任何問題。訓(xùn)練才是關(guān)鍵。Yi給了我們目前可獲得的最佳模型,沒有任何可抱怨的。”

現(xiàn)在,Eric已經(jīng)成為Yi-34B的忠實擁躉,會使用Yi-34b-200k數(shù)據(jù)集訓(xùn)練其他的模型產(chǎn)品,并感嘆絲滑般的訓(xùn)練體驗。

數(shù)字化創(chuàng)業(yè)者,開發(fā)者,技術(shù)寫作者蘇洋表示:

我自己本身是大模型產(chǎn)品的重度用戶,除了用了很久的 Tabnine、Copilot 做代碼輔助生成之外,也算是第一批開始氪金使用 Chat 的玩家,基本各家廠商模型出來都會申請內(nèi)測,體驗?zāi)P偷膶嶋H能力。這里除去工作中接觸和使用模型的機會外,作為獨立開發(fā)者,玩了十幾年的代碼,我個人也非常好奇模型究竟能夠發(fā)展到什么程度。

我了解到 Yi-34B 有幾個渠道,當(dāng)時的 Huggingface 榜單第一名、小圈子朋友的“點贊”和“吐槽”、各種群里刷屏的消息。

圖片

圖片

我是開發(fā)者,同時也是終端用戶,所以非常好奇,這個模型到底行不行?或者說更想知道模型哪里是行的,哪里是不行的。尤其是榜單分?jǐn)?shù)這么高,質(zhì)疑聲浪也這么高?與其霧里看花、眾說紛紜,不如自己實際跑一跑。

于是,我嘗試使用家里本地的機器,在純 CPU 環(huán)境、CPU & GPU 混合環(huán)境下對模型進行測試,結(jié)果比想象中要好。

尤其是社區(qū)中的 finetune 后的版本,在對新聞、研究報告的摘要總結(jié)方面,對非結(jié)構(gòu)化的信息中的實體識別和抽取上表現(xiàn)非常不錯。早些時候,官方還未推出 Chat 版本時,來自社區(qū)的 Chat 版本在對話的過程中,通史類的問答表現(xiàn)也非常不錯。當(dāng)然,可能是由于零一在訓(xùn)練過程中,出于安全考慮,過濾太多語料的緣故,一些本土化的內(nèi)容仍然不夠深入。

而且,不光是我的個人體驗,海外也有用戶有相同體感,在“海外貼吧” Reddit 上有分享自己的感受,你們可以自己搜搜看。

我會時不時的瀏覽下 HF 的榜單,在最近榜單中的前三十名,有一半多都是 Yi 和其他用戶微調(diào)的 Yi-34B 的變體模型,原本占據(jù)榜單頭部的 68B 和 70B 模型的數(shù)量目前只留有幾個,從這點看 Yi 對于開源生態(tài)的幫助還是非常巨大的。

34B 普通用戶努努力還是能自己相對低成本跑起來的,68 和 70B 的模型想要本地運行,需要更多的資源。但其實目前分?jǐn)?shù)其實相比較 34B 拉不開太多,也就三四分平均分,但參數(shù)量差了一倍。換言之,企業(yè)想部署使用,所需要的成本也可以得到非常大的節(jié)約。

目前國產(chǎn)大模型在開源榜單上已經(jīng)是第一梯隊,但如果把競爭范圍追加到閉源模型、尤其是海外的模型,仍有很大的距離要去追趕。目前的普遍體驗是開源模型最多只有 GPT-3.5 + 的水平。

我個人相信國產(chǎn)大模型是能夠很快追趕至第一梯隊的。

就如同很多底子很好,又勤奮刻苦的中國大學(xué)生,能夠在使用正確方法的前提下,通過努力,不斷的進入更好的學(xué)習(xí)環(huán)境,不斷刷新自己成績,取得耀眼的學(xué)術(shù)成就。現(xiàn)實中,哪怕是對華人苛刻的 “八大藤校”,是不是中國人越來越多了呢?

只要底子好,堅持使用開源的正確路線和方法,做好本地化適配和調(diào)優(yōu),就有希望。

參考鏈接:

[1]https://huggingface.co/01-ai/[2]https://www.modelscope.cn/organization/01ai