OpenAI新模型曝重大飛躍:AGI雛形或威脅人類,也成Altman被解雇導(dǎo)火索!

Sam Alman被解雇,又曝出最新內(nèi)幕!

據(jù)路透社報道,就在他被解雇的前四天,OpenAI內(nèi)部的研究員曾向董事會發(fā)了一封警告信,稱發(fā)現(xiàn)了一個可能威脅人類的強大人工智能。

知情人士表示,這封此前從未報道過的信,也是董事會最終罷免Altman的導(dǎo)火索之一。

據(jù)稱,曾任OpenAI臨時CEO的Mira Murati,在周三提到了這個名為Q*(讀作Q-Star)的項目,并且在「政變」發(fā)生之前給董事會寫過一封信。

董事會覺得,Altman瞞著董事會在推進(jìn)可能威脅人類的項目。

與此同時,有內(nèi)部研究員認(rèn)為,OpenaAI在Q*上取得的進(jìn)展,將會成為AGI的一個重要突破!

不過,就在剛剛,TradingStrategy.ai聯(lián)創(chuàng)表示,「AI重大突破」這個說法已被OpenAI內(nèi)部人士打假。

APEC會議上的「危險」發(fā)言

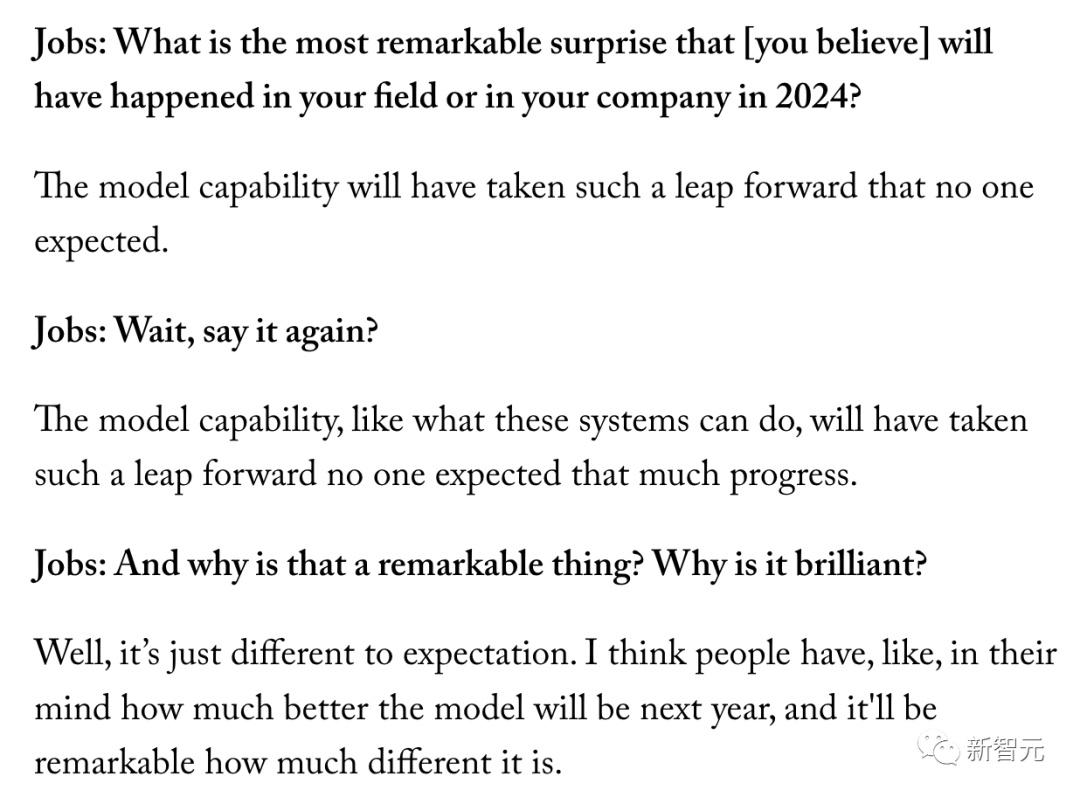

印證項目的另一事件,是Sam Altman在被解雇的一天,在APEC一次會議上的發(fā)言。

在那次會議上,他暗示了OpenAI已經(jīng)開發(fā)出了比GPT-4更強大、更難以想象的東西,遠(yuǎn)超人們的期待。

模型的能力將會有一個無人預(yù)料到的飛躍。與人們的預(yù)期不同,這個飛躍是驚人的!

而這次發(fā)言,很可能也是他被解雇的導(dǎo)火索之一,會讓Ilya等董事會成員認(rèn)為,他隱瞞了許多信息。

現(xiàn)在正在發(fā)生的技術(shù)變革,將徹底改變我們生活方式、經(jīng)濟和社會結(jié)構(gòu)以及其他可能性限制……這在OpenAI的歷史上有四次 ,而最近一次,就是在過去幾周內(nèi)。

在撥開無知的面紗和探索未知的邊界時,我有幸在場, 這是我職業(yè)生涯中的榮幸。

Q*就是AGI?

其中一位知情人士說,在與路透社聯(lián)系后,拒絕置評的OpenAI在給員工的內(nèi)部消息中,承認(rèn)了一個名為Q*的項目,并在周末的活動前給董事會寫了一封信。

OpenAI的一位發(fā)言人表示,這條消息由CTO Mira Murati發(fā)送,提醒員工注意某些媒體報道,但并沒有對其準(zhǔn)確性發(fā)表評論。

其中一位知情人士告訴路透社,OpenAI的一些人認(rèn)為Q*(發(fā)音為Q-Star)可能是OpenAI在AGI上取得的一個突破。

在OpenAI看來,AIG可以定義為「在最具經(jīng)濟價值的任務(wù)中,超越人類的自主系統(tǒng)」。

因為巨大的算力支持,新模型可以解決某些數(shù)學(xué)問題。雖然只是可以在小學(xué)水平上做數(shù)學(xué)題,但通過這樣的測試,讓研究者對Q*的未來非常樂觀。

根據(jù)內(nèi)部人士透露,在給董事會的信中,研究人員標(biāo)記了AI的實力和潛在危險,但沒有具體說明信中提到的確切安全問題。

另外,研究人員還標(biāo)記了一個「人工智能科學(xué)家」團(tuán)隊的工作,有多個消息來源證實了該團(tuán)隊的存在。

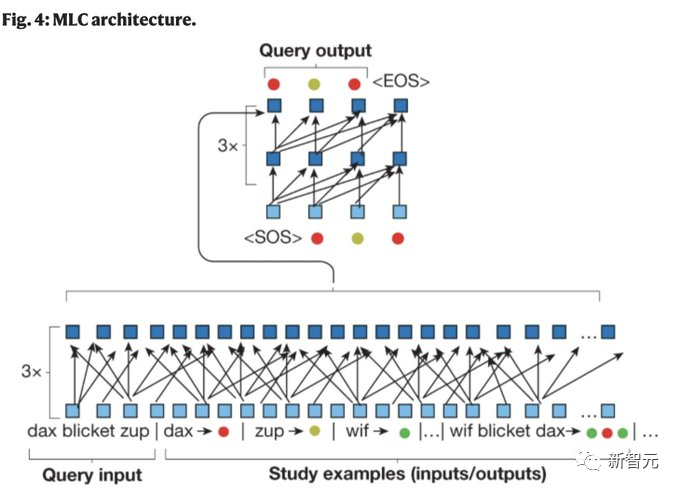

30多年前,F(xiàn)odor和Pylyshyn提出的經(jīng)典論點——神經(jīng)網(wǎng)絡(luò)由于其統(tǒng)計性質(zhì)而從根本上缺乏人類的系統(tǒng)組合技能——給神經(jīng)網(wǎng)絡(luò)研究蒙上了長長的陰影

其中一位知情人士說,該小組由早期的「Code Gen」和「Math Gen」團(tuán)隊組成,正在探索如何優(yōu)化現(xiàn)有的人工智能模型,以提高其推理能力,并最終進(jìn)行科學(xué)工作。

項目由Ilya主導(dǎo)

據(jù)悉,一些OpenAI員工認(rèn)為,Altman的言論應(yīng)該指的是公司早些時候的一項創(chuàng)新,就是這項創(chuàng)新,能讓他們開發(fā)出更強大的AI模型。

Ilya團(tuán)隊的這項工作,此前從未被報道過。

知情人士透露,這項由OpenAI首席科學(xué)家Ilya Sutskever主導(dǎo)的技術(shù)突破,引起了一些員工的擔(dān)憂。他們擔(dān)心公司沒有合適的保障措施,來將這種先進(jìn)的AI模型商業(yè)化。

在接下來的幾個月里,OpenAI的高級研究人員又利用這項創(chuàng)新,建立了能夠解決基本數(shù)學(xué)問題的系統(tǒng)。

經(jīng)常用大模型的人都知道,數(shù)學(xué)問題對于現(xiàn)有的LLM,都是一項艱巨的任務(wù)。

根據(jù)The Information報道,OpenAI的兩位研究員,Jakub Pachocki和Symon Sidor,利用Ilya的工作成果建立了一個名為Q*(讀作「Q-Star」) 的模型。

據(jù)稱,Q*模型能夠解決它以前從未見過的數(shù)學(xué)問題,而這,是一個重要的技術(shù)里程碑。

最近幾周內(nèi),該模型的演示一直在OpenAI內(nèi)部流傳,而AI的發(fā)展速度,也讓安全研究人員感到震驚。

據(jù)內(nèi)部人士爆料,Ilya的突破,使OpenAI不再受限于獲取足夠的高質(zhì)量數(shù)據(jù)來訓(xùn)練新模型,而這,正是開發(fā)下一代模型的主要障礙。

這項研究涉及使用計算機生成的數(shù)據(jù),而不是真實世界的數(shù)據(jù),比如從互聯(lián)網(wǎng)上提取的文本或圖像。

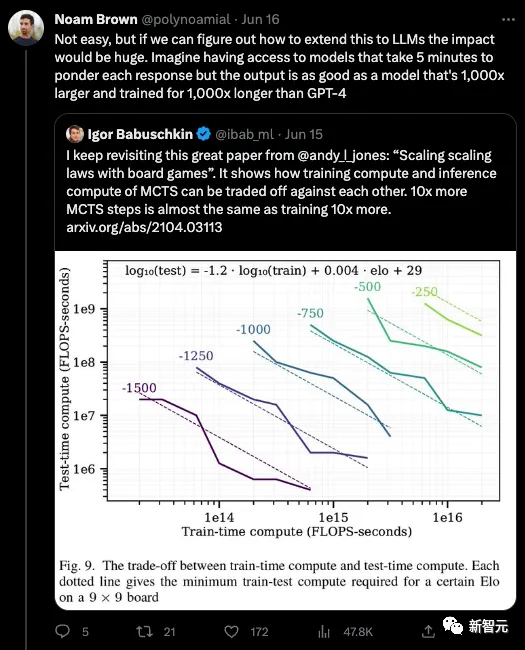

多年來,Ilya一直在研究如何讓GPT-4解決涉及推理的任務(wù),比如數(shù)學(xué)或科學(xué)問題。

此前,Ilya在這個方向就有多年積累。21年,他啟動了一個名為GPT-Zero的項目,這是對DeepMind AlphaZero的致敬。

GPT-Zero可以下國際象棋、圍棋和將棋。而團(tuán)隊假設(shè),只要給大模型更多的時間和算力,假以時日,它們一定能達(dá)到新的學(xué)術(shù)突破。

而且在半年之前,就有硅谷大佬扒出,OpenAI很有可能會將「實時檢索」和模型能力結(jié)合起來,創(chuàng)造出難以想象的AI能力。

尤其是針對LLM亟待提高的數(shù)理和推理能力,未來有可能會有極大提升。

在提出了這種可能性之后,他于兩周之后就加入了OpenAI。

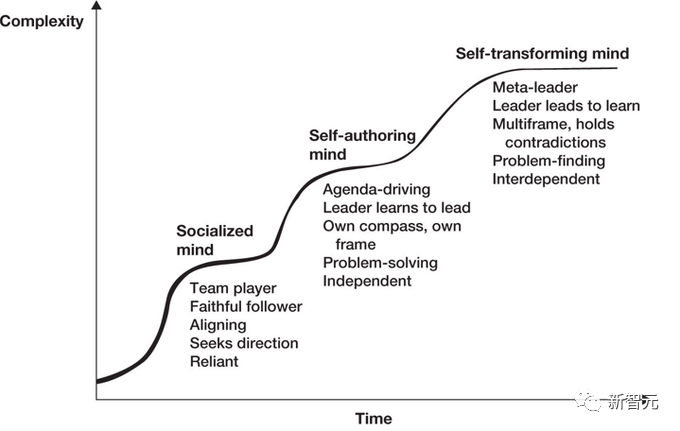

對齊派 VS 加速派

而即使在昨天Altman重返CEO之位后,高管之間的潛在分歧似乎仍未消除,因為OpenAI內(nèi)部對工作進(jìn)度的緊張關(guān)系仍在持續(xù)。

Ilya本人似乎對這項技術(shù)持保留意見。今年7月,他組建了對齊團(tuán)隊,致力于限制AI系統(tǒng)可能給人類帶來的威脅。

在OpenAI的對齊團(tuán)隊看來,雖然超級AI還很遙遠(yuǎn),但他們相信它會在十年內(nèi)到來。

Pachocki和Sidor的立場,大概率是在Ilya對齊團(tuán)隊的反面。

上周Altman被解雇后,兩人也迅速辭職。而Altman復(fù)職后,兩人也隨之回到了公司。

而OpenAI總裁兼聯(lián)創(chuàng)Greg Brockman,對于這項技術(shù)也持支持態(tài)度,致力于將其整合到新產(chǎn)品中。他同樣是在Altman復(fù)職后,隨之回到了公司。