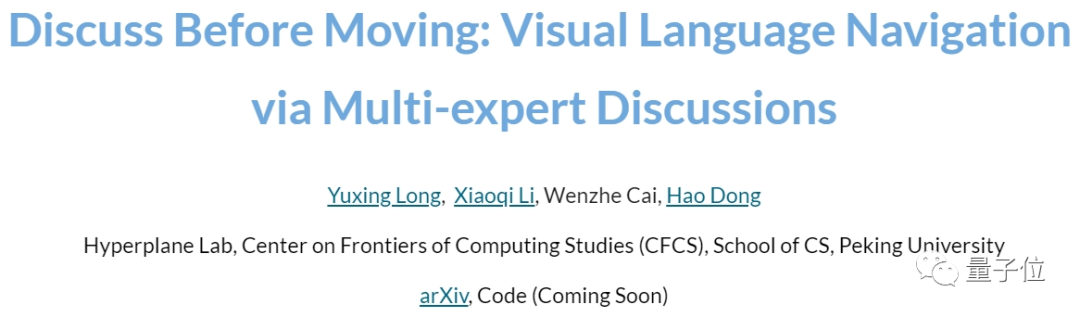

北大具身智能新成果:無需訓練,聽指令就能靈活走位

北京大學董豪團隊具身導航最新成果來了:

無需額外建圖和訓練,只需說出導航指令,如:

Walk forward across the room and walk through the panty followed by the kitchen. Stand at the end of the kitchen

我們就能控制機器人靈活移動。

在此,機器人靠的是主動與大模型構成的“專家團隊”溝通完成指令分析、視覺感知、完成估計和決策測試等一系列視覺語言導航關鍵任務。

目前項目主頁和論文都已上線,代碼即將推出:

機器人如何根據人類指令導航?

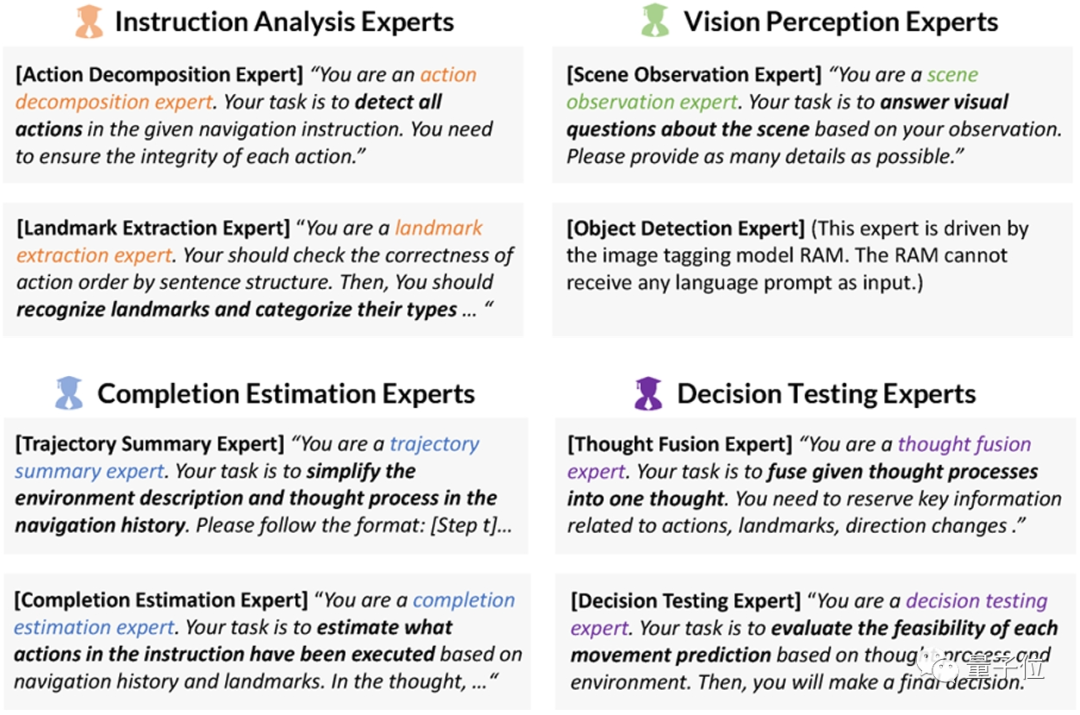

視覺語言導航涉及到一系列子任務,包括指令分析,視覺感知,完成估計和決策測試。

這些關鍵任務需要不同領域知識,它們環環相扣決定機器人的導航能力。

受到現實中專家討論行為的啟發,北大董豪團隊提出DiscussNav導航系統。

作者首先以提示方式賦予LLM(大語言模型)和MLM(多模態大模型)專家角色和特定任務,激活它們的領域知識和能力,由此構建具備不同特長的視覺導航專家團隊。

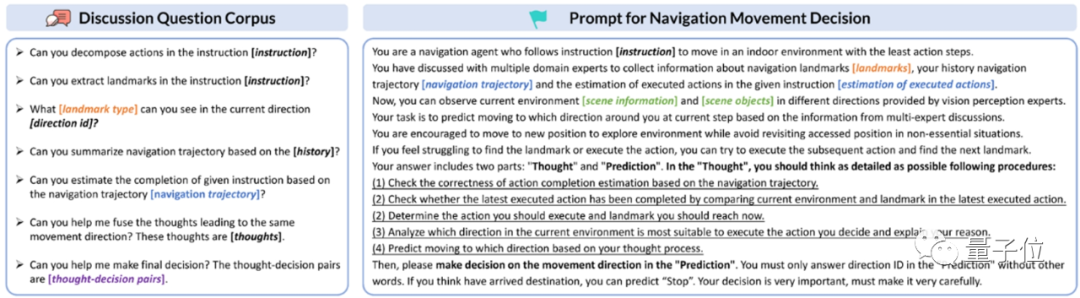

然后,作者設計了討論問題語料庫和討論機制,遵循該機制,由LLM驅動的導航機器人可以主動發起一系列與視覺導航專家的討論。

在每一步移動前,導航機器人都會與專家討論來理解人類指令中要求的動作和提及的物體標志。

進而依據這些物體標志的類型有傾向性地對周圍環境進行感知,指令完成情況估計,由此做出初步的移動決策。

在決策過程中,導航機器人會根據Chain-of-Thought(思維鏈)同時生成N個獨立的預測結果,當這些預測結果之間不一致時,機器人會向決策測試專家求助,篩選出最終的移動決策。

從這個過程我們可以看到,相比傳統方法需要進行額外的預訓練,這個方法通過與大模型專家交互指導機器人根據人類指令移動,直接解決了機器人導航訓練數據稀缺的問題。

更進一步,正是由于這個特點,它也實現了零樣本能力,只要遵循以上討論流程,就能follow多樣的導航指令。

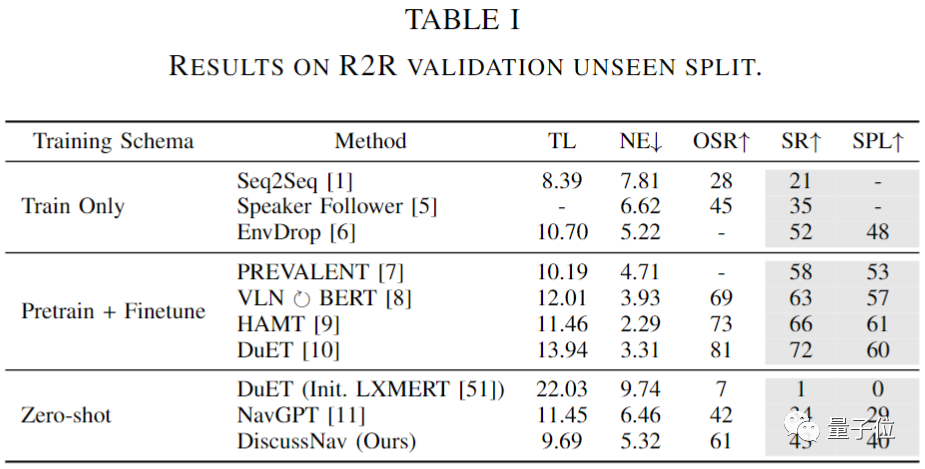

以下是DiscussNav在經典的視覺語言導航數據集Room2Room上的表現。

可以看到,它顯著高于所有零樣本方法,甚至超過兩個經過訓練的方法。

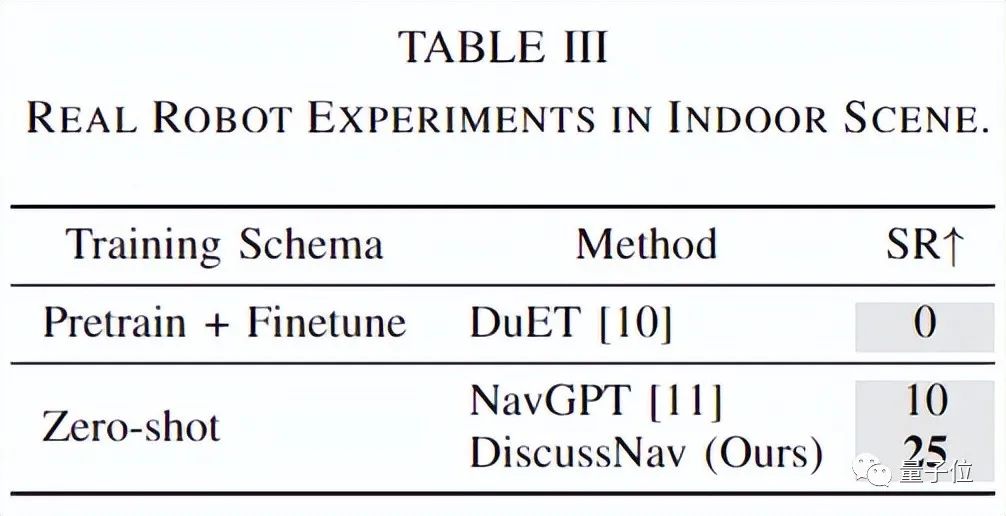

作者進一步在Turtlebot4移動機器人上開展真實室內場景導航實驗。

憑借專家角色扮演和討論激發出的大模型強大的語言和視覺泛化能力,DiscussNav在真實世界的表現明顯優于之前最優的零樣本方法和經過預訓練微調的方法, 展現出良好的sim-to-real遷移能力。

通過實驗,作者進一步發現,DiscussNav產生了4個強大的能力:

1、識別開放世界物體,比如“白色桌子上的機械手臂”,“椅子上的泰迪熊”。

2、識別細粒度的導航標志物體,比如“廚房柜臺上的植物”,“桌上的紙箱”。

3、糾正其它專家在討論中回復的錯誤信息,比如標志提取專家在從導航動作序列提取導航標志前會檢查并糾正被錯誤分解的動作序列。

4、排除不一致的移動決策,比如決策測試專家們可以根據當前環境信息從DiscussNav預測的多個不一致的移動決策中選擇最合理的一個作為最終移動決定。

“仿真和大模型先驗是Free Lunch”

通訊作者董豪在之前的報告中提出,深入探索如何有效利用仿真數據和大模型從海量數據中學習到的先驗知識是未來具身智能研究的發展方向。

目前受限于數據規模和探索真實環境的高昂成本,具身智能研究仍將重點關注仿真平臺實驗和仿真數據訓練。

近期大模型的進展為具身智能提供新方向,合理發掘和利用大模型中存在的語言常識和物理世界先驗將推動具身智能發展。

論文地址: https://arxiv.org/abs/2309.11382