五個獨特且有趣的ChatGPT指令

今天分享5個很實用的指令,這幾個指令很多時候對我們輸出內容的連貫性、文章風格、創(chuàng)意性等方面有著決定性的作用

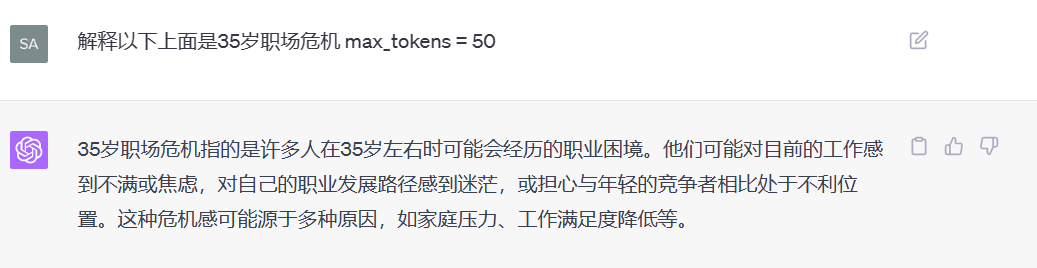

第一個:Max tokens(最大令牌)

Max tokens決定了生成文本的最大長度。通過設置一個限制,可以控制AI說的內容,確保它不給出過長的答案。

示例:max_tokens = 50 - 如果你想要一個簡短的回答,像是快速回答或推文。

這樣對輸出的內容做了字數(shù)的限制,只有50個字,你可以根據(jù)自己的需求進行字數(shù)的調整

圖片

圖片

第二個:Top_p(控制采樣)

此參數(shù)在0和1之間,控制核心采樣,一種引入隨機性的方法。

接近1.0的值使輸出更加多樣和隨機, 接近0的值使其更加確定性。

示例:top_p = 0.8 - 如果你想在為新產(chǎn)品生成多個名稱時得到多樣的選項。

圖片

圖片

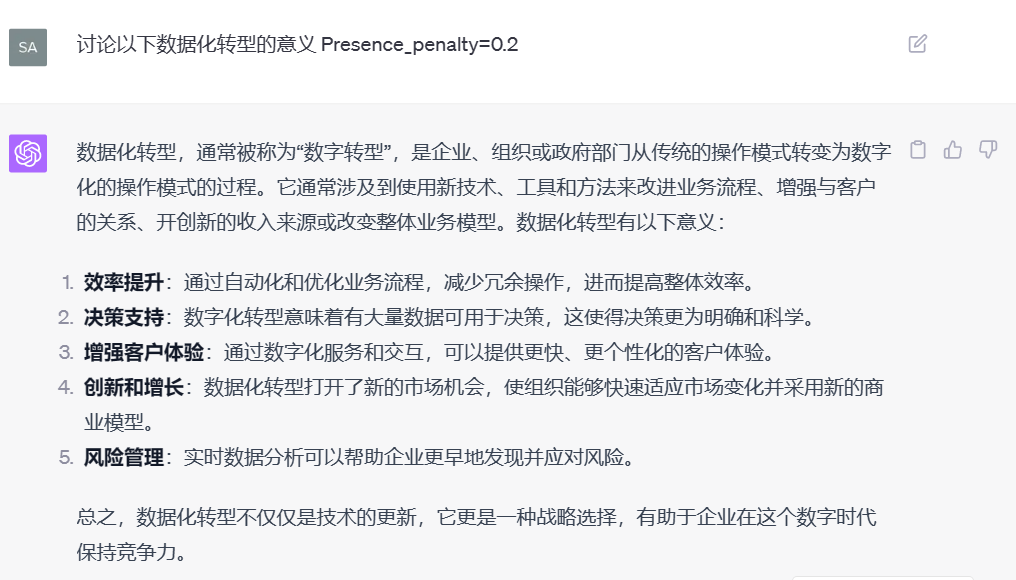

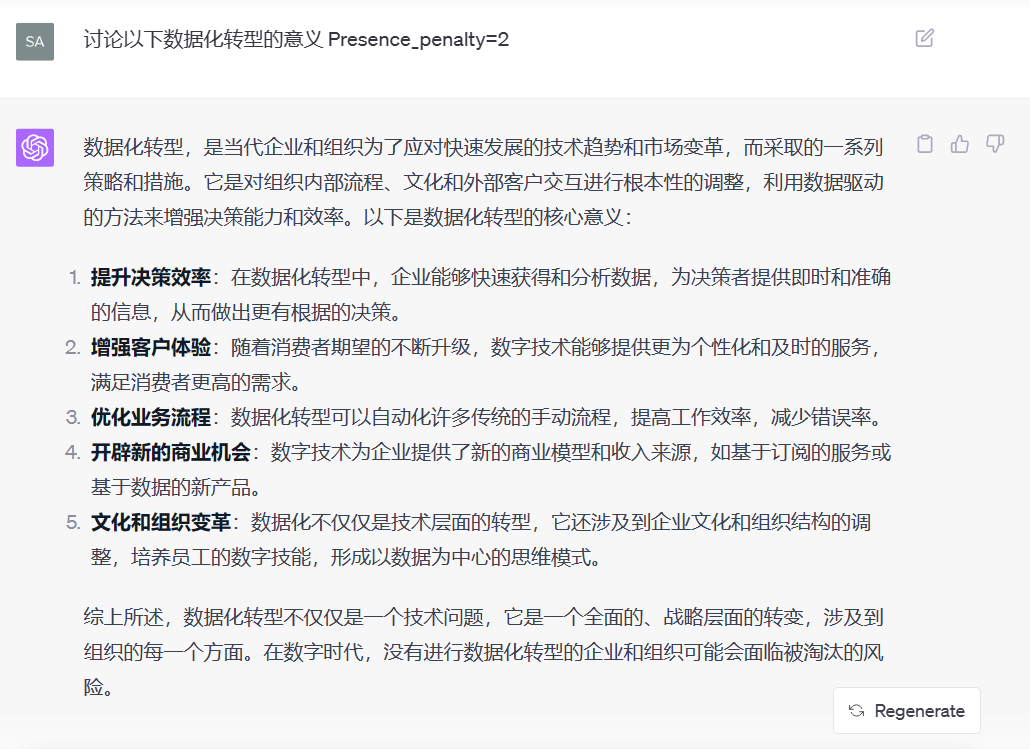

第三個:Presence_penalty (阻止調整)

這個參數(shù)范圍在-2.0至2.0之間,用來防止模型引入新的話題。值越高,會話將更加集中但可能較為乏味。

示例:presence_penalty = 0.6 - 如果你希望模型堅持討論特定話題,如詳細探討某個具體項目。

圖片

圖片

圖片

圖片

第四個:Frequency_penalty (短語效應)

此參數(shù)的范圍在-2.0至2.0之間,它用來防止模型使用常見的短語或回應。值越高,輸出內容將更具創(chuàng)意,但可能減少連貫性。

示例:frequency_penalty = 1.0 - 如果你想生成一個口號或標語,并希望它是獨特的,而不是常見的短語。

圖片

圖片

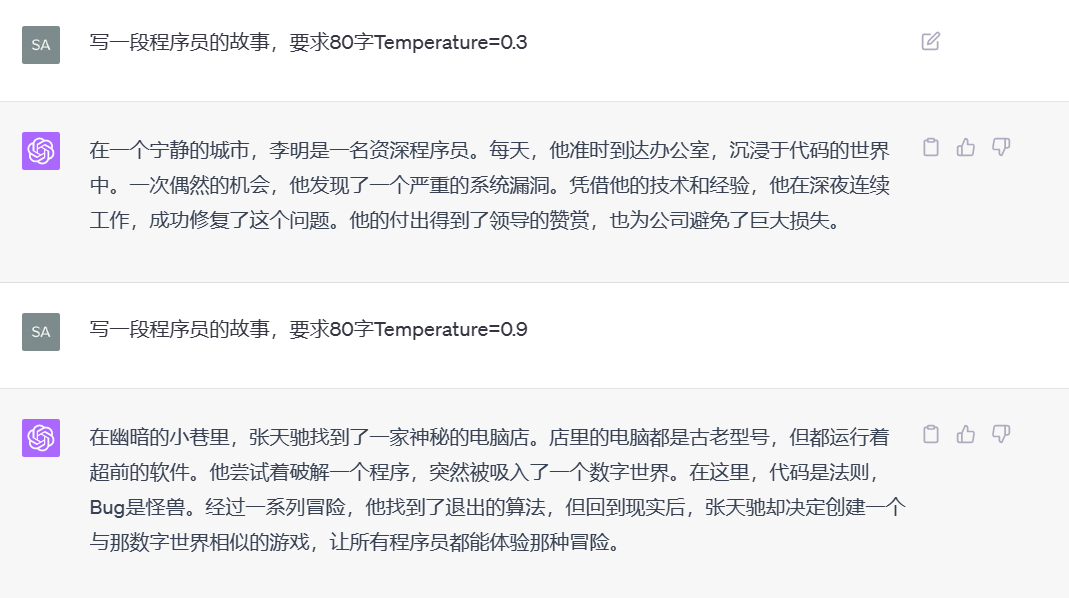

第五個:Temperature(文風的溫度)

使用較低溫度生成的文本將更加集中和保守,而使用較高溫度生成的文本則會更具創(chuàng)意和變化。溫度的范圍是從0到1。

- 溫度 = 0:模型會產(chǎn)生最確定的輸出,但可能顯得重復或模板化。

- 0 < 溫度 < 0.5:輸出將傾向于較為穩(wěn)定和保守,提供高度相關且一致的回應。

- 溫度 = 0.5:產(chǎn)生的文本會有一個適中的平衡,既不過于隨機也不過于保守。

- 0.5 < 溫度 < 1:輸出會更具創(chuàng)意和變化,但可能犧牲一些連貫性。

- 溫度 = 1:模型會產(chǎn)生最大程度的創(chuàng)意和隨機性,可能產(chǎn)生出奇不意的答案,但風險也更高。

實戰(zhàn)中可以多個組合使用,比如

Temperature:0.7至1,以獲得最大的創(chuàng)意和多樣性。

Frequency_penalty:1至2,用于產(chǎn)生各種獨特的短語和想法。

Max tokens:根據(jù)你所需的故事長度或場景進行設置。

帶大家一起試試,

prompt:

我是數(shù)師兄,今天是我堅持連續(xù)寫GPT方面的文章4個月了,希望大家能給一些打賞鼓勵

Temperature=0.8

Frequency_penalty=1.8

Max tokens=200ChatGPT的輸出:

圖片

圖片