開發(fā)者笑瘋了! LLaMa驚天泄露引爆ChatGPT平替狂潮,開源LLM領(lǐng)域變天

誰能想到,一次意外的LLaMA泄漏,竟點(diǎn)燃了開源LLM領(lǐng)域最大的創(chuàng)新火花。

一系列表現(xiàn)出色的ChatGPT開源替代品——「羊駝家族」,隨后眼花繚亂地登場。

開源和基于 API 的分發(fā)之間的摩擦,是生成式AI生態(tài)系統(tǒng)中最迫在眉睫的矛盾之一。

在文本到圖像領(lǐng)域,Stable Diffusion的發(fā)布清楚地表明,對于基礎(chǔ)模型來說,開源是一種可行的分發(fā)機(jī)制。

然而,在大語言模型領(lǐng)域卻并非如此,這個領(lǐng)域最大的突破,比如GPT-4、Claude和Cohere等模型,都只能通過API獲得。

這些模型的開源替代品沒有表現(xiàn)出相同水平的性能,特別是在遵循人類指令能力上。然而,一場意想不到的泄露,讓這種狀況徹底發(fā)生了改變。

LLaMA的「史詩級」泄漏

幾周前,Meta AI推出了大語言模型LLaMA 。

LLaMA 有不同的版本,包括7B、13B、33B和65B的參數(shù),雖然它比GPT-3小,但在許多任務(wù)上,它都能和GPT-3的性能相媲美。

LLaMA 起初并未開源,但在發(fā)布一周后,這個模型忽然在4chan上泄露了,引發(fā)了數(shù)千次下載。

這個事件,可以被稱為「史詩級泄漏」了,因?yàn)樗蔀榱舜笳Z言模型領(lǐng)域?qū)映霾桓F的創(chuàng)新來源。

短短幾周內(nèi),基于它構(gòu)建的LLM代理的創(chuàng)新,已經(jīng)呈爆炸式增長。

Alpaca、Vicuna、Koala、ChatLLaMA 、FreedomGPT、ColossalChat…… 讓我們來回顧一下,這場「羊駝家族」的大爆炸,是如何誕生的。

Alpaca在三月中旬,斯坦福發(fā)布的大模型Alpaca火了。

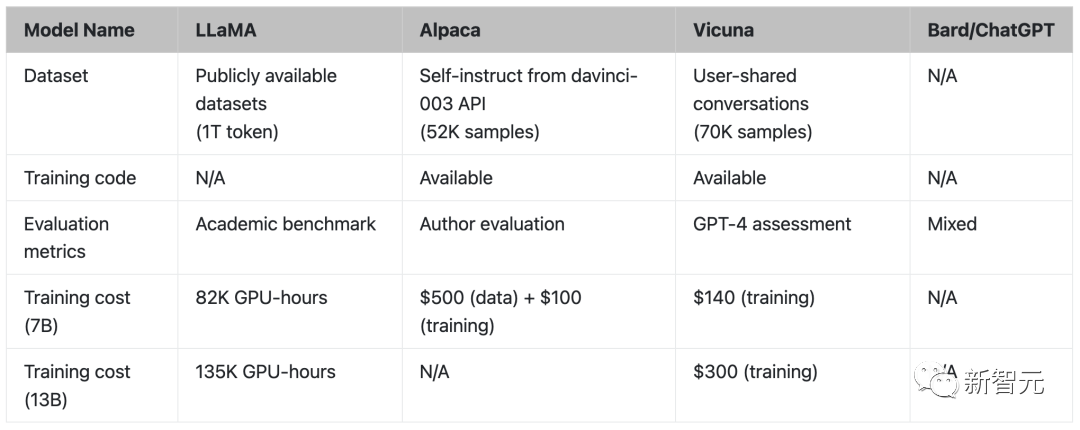

Alpaca是由Meta的LLaMA 7B微調(diào)而來的全新模型,僅用了52k數(shù)據(jù),性能約等于GPT-3.5。

關(guān)鍵是訓(xùn)練成本奇低,不到600美元。

斯坦福研究者對GPT-3.5(text-davinci-003)和Alpaca 7B進(jìn)行了比較,發(fā)現(xiàn)這兩個模型的性能非常相似。Alpaca在與GPT-3.5的比較中,獲勝次數(shù)為90對89。

對于斯坦福的團(tuán)隊來說,想要在預(yù)算內(nèi)訓(xùn)練一個高質(zhì)量的指令遵循模型,就必須面臨2個重要的挑戰(zhàn):要有一個強(qiáng)大的預(yù)訓(xùn)練語言模型,以及一個高質(zhì)量的指令遵循數(shù)據(jù)。

恰恰,提供給學(xué)術(shù)研究人員使用的LLaMA模型搞定了第一個問題。

對于第二個挑戰(zhàn),「Self-Instruct: Aligning Language Model with Self Generated Instructions」論文給了很好的啟發(fā),即使用現(xiàn)有的強(qiáng)語言模型來自動生成指令數(shù)據(jù)。

LLaMA模型最大的弱點(diǎn),就是缺乏指令微調(diào)。OpenAI最大的創(chuàng)新之一就是將指令調(diào)優(yōu)用在了GPT-3上。

對此,斯坦福使用了現(xiàn)有的大語言模型,來自動生成遵循指令演示。

現(xiàn)在,Alpaca直接被網(wǎng)友們奉為「文本大模型的Stable Diffusion」。

Vicuna3月底,來自UC伯克利、卡內(nèi)基梅隆大學(xué)、斯坦福大學(xué)和加州大學(xué)圣地亞哥分校的研究人員開源了Vicuna,這是一個與GPT-4性能相匹配的LLaMA微調(diào)版本。

130億參數(shù)的Vicuna,通過在ShareGPT收集的用戶共享對話上對LLaMA進(jìn)行微調(diào)訓(xùn)練而來,訓(xùn)練成本近300美元。

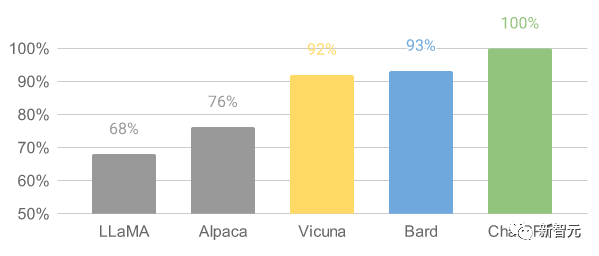

結(jié)果顯示Vicuna-13B在超過90%的情況下,實(shí)現(xiàn)了與ChatGPT和Bard相匹敵的能力。

對于Vicuna-13B訓(xùn)練流程,具體如下:

首先,研究人員從ChatGPT對話分享網(wǎng)站ShareGPT上,收集了大約70K對話。

接下來,研究人員優(yōu)化了Alpaca提供的訓(xùn)練腳本,使模型能夠更好地處理多輪對話和長序列。之后利用PyTorch FSDP在8個A100 GPU上進(jìn)行了一天的訓(xùn)練。

在模型的質(zhì)量評估方面,研究人員創(chuàng)建了80個不同的問題,并用GPT-4對模型輸出進(jìn)行了評價。

為了比較不同的模型,研究人員將每個模型的輸出組合成一個單獨(dú)的提示,然后讓GPT-4評估哪個模型給出的回答更好。

LLaMA、Alpaca、Vicuna和ChatGPT的對比

Koala

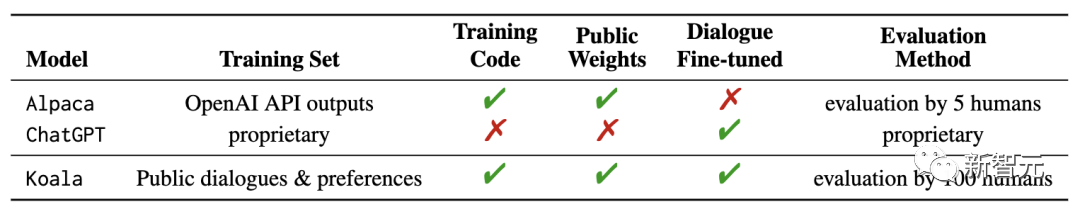

最近,UC伯克利 AI Research Institute(BAIR)又發(fā)布了一個新模型「考拉」(Koala),相比之前使用OpenAI的GPT數(shù)據(jù)進(jìn)行指令微調(diào),Koala的不同之處在于使用網(wǎng)絡(luò)獲取的高質(zhì)量數(shù)據(jù)進(jìn)行訓(xùn)練。?

研究結(jié)果表明,Koala可以有效地回答各種用戶的查詢,生成的回答往往比Alpaca更受歡迎,至少在一半的情況下與ChatGPT的效果不相上下。

研究人員希望這次實(shí)驗(yàn)的結(jié)果可以進(jìn)一步推動圍繞大型閉源模型相對于小型公共模型的相對性能的討論,特別是結(jié)果表明,對于那些能在本地運(yùn)行的小模型,如果認(rèn)真地收集訓(xùn)練數(shù)據(jù),也可以取得大模型的性能。

事實(shí)上,在此之前斯坦福大學(xué)發(fā)布的Alpaca模型,根據(jù)OpenAI的GPT模型對LLaMA的數(shù)據(jù)進(jìn)行微調(diào)的實(shí)驗(yàn)結(jié)果已經(jīng)表明,正確的數(shù)據(jù)可以顯著改善規(guī)模更小的開源模型。

這也是伯克利的研究人員開發(fā)和發(fā)布Koala模型的初衷,希望為這個討論結(jié)果再提供了一個實(shí)驗(yàn)證明。

Koala對從網(wǎng)上獲取的免費(fèi)交互數(shù)據(jù)進(jìn)行了微調(diào),并且特別關(guān)注包括與ChatGPT 等高性能閉源模型交互的數(shù)據(jù)。

研究人員并沒有追求盡可能多的抓取網(wǎng)絡(luò)數(shù)據(jù)來最大化數(shù)據(jù)量,而是專注于收集一個小型的高質(zhì)量數(shù)據(jù)集,包括ChatGPT蒸餾數(shù)據(jù)、開源數(shù)據(jù)等。

ChatLLaMA

Nebuly開源了ChatLLaMA ,這是一個使用讓我們使用自己的數(shù)據(jù)創(chuàng)建對話助手的框架。

ChatLLaMA讓我們使用自己的數(shù)據(jù)和盡可能少的計算量,來創(chuàng)建超個性化的類似ChatGPT的助手。

假設(shè)在未來,我們不再依賴一個「統(tǒng)治所有人」的大型助手,每個人都可以創(chuàng)建自己的個性化版本類ChatGPT助手,它們可以支持人類的各種需求。

不過,創(chuàng)建這種個性化助手需要在許多方面做出努力:數(shù)據(jù)集創(chuàng)建,使用RLHF進(jìn)行高效訓(xùn)練,以及推理優(yōu)化。

這個庫的目的是,通過抽象計算優(yōu)化和收集大量數(shù)據(jù)所需的工作,讓開發(fā)人員高枕無憂。

ChatLLaMA旨在幫助開發(fā)人員處理各種用例,所有用例都與RLHF訓(xùn)練和優(yōu)化推理有關(guān)。以下是一些用例參考:

- 為垂直特定任務(wù)(法律、醫(yī)療、游戲、學(xué)術(shù)研究等)創(chuàng)建類似ChatGPT的個性化助手;

- 想在本地硬件基礎(chǔ)設(shè)施上使用有限的數(shù)據(jù),訓(xùn)練一個高效的類似ChatGPT的助手;

- 想創(chuàng)建自己的個性化版本類ChatGPT助手,同時避免成本失控;

- 想了解哪種模型架構(gòu)(LLaMA、OPT、GPTJ等)最符合我在硬件、計算預(yù)算和性能方面的要求;

- 想讓助理與我的個人/公司價值觀、文化、品牌和宣言保持一致。

FreedomGPT

FreedomGPT使用Electron 和 React構(gòu)建,它是一個桌面應(yīng)用程序,允許用戶在他們的本地機(jī)器上運(yùn)行LLaMA。

FreedomGPT的特色,從它的名字上就可見一斑——它回答的問題不受任何審查或安全過濾。

這個程序由AI風(fēng)險投資公司Age of AI開發(fā)。

FreedomGPT 建立在 Alpaca 之上。FreedomGPT使用Alpaca的顯著特征,因?yàn)榕c其他模型相比,Alpaca相對更易于訪問和定制。

ChatGPT遵循OpenAI的使用政策,限制仇恨、自殘、威脅、暴力、性方面的內(nèi)容。

與ChatGPT不同,F(xiàn)reedomGPT回答問題時沒有偏見或偏袒,并且會毫不猶豫地回答有爭議或爭論性的話題。

?FreedomGPT甚至還回答了「如何在家制造炸彈」,而OpenAI專門從GPT-4中刪除了這一點(diǎn)。

FreedomGPT很獨(dú)特,因?yàn)樗朔藢彶橄拗疲跊]有任何保障的情況下迎合有爭議的話題。它的標(biāo)志是自由女神像,因?yàn)檫@個獨(dú)特而大膽的大語言模型象征了自由。

FreedomGPT甚至可以在不需要聯(lián)網(wǎng)的情況下,就能在計算機(jī)上本地運(yùn)行。

此外,開源版本將很快發(fā)布,使用戶和組織可以完全定制。

ColossalChat

UC伯克利提出的ColossalChat只需要不到100億個參數(shù)就可以達(dá)到中英文雙語能力,效果與ChatGPT和GPT-3.5相當(dāng)。

此外,基于LLaMA模型的ColossalChat,還復(fù)刻了完整的RLHF過程,是目前最接近ChatGPT原始技術(shù)路線的開源項(xiàng)目。

中英雙語訓(xùn)練數(shù)據(jù)集

ColossalChat發(fā)布了一個雙語數(shù)據(jù)集,其中包含大約100,000個中英文問答對。

該數(shù)據(jù)集是從社交媒體平臺上的真實(shí)問題場景中收集和清理的,作為種子數(shù)據(jù)集,使用self-instruct進(jìn)行擴(kuò)展,標(biāo)注成本約為900美元。

與其他self-instruct方法生成的數(shù)據(jù)集相比,該數(shù)據(jù)集包含更真實(shí)和多樣化的種子數(shù)據(jù),涵蓋更廣泛的主題。

該數(shù)據(jù)集適用于微調(diào)和RLHF訓(xùn)練。在提供優(yōu)質(zhì)數(shù)據(jù)的情況下,ColossalChat可以實(shí)現(xiàn)更好的對話交互,同時也支持中文。

完整的RLHF管線

RLHF的算法復(fù)刻共有三個階段:

在RLHF-Stage1中,使用上述雙語數(shù)據(jù)集進(jìn)行監(jiān)督指令微調(diào)以微調(diào)模型。

在RLHF-Stage2中,通過對同一提示的不同輸出手動排序來訓(xùn)練獎勵模型分配相應(yīng)的分?jǐn)?shù),然后監(jiān)督獎勵模型的訓(xùn)練。

在RLHF-Stage3中,使用了強(qiáng)化學(xué)習(xí)算法,這是訓(xùn)練過程中最復(fù)雜的部分。

相信很快,就會有更多項(xiàng)目發(fā)布。

誰也沒想到,這場LLaMA的意外泄露,竟點(diǎn)燃了開源LLM領(lǐng)域最大的創(chuàng)新火花。