Meta千億參數(shù)大模型OPT-IML「升級(jí)版」來(lái)了,完整模型和代碼公布!

今年五月,MetaAI官宣發(fā)布了基于1750億參數(shù)的超大模型OPT-175B,還對(duì)所有社區(qū)免費(fèi)開(kāi)放。

12月22日,該模型的更新版本OPT-IML(Open Pre-trained Transformer)正式上線,Meta稱其「對(duì)2000個(gè)語(yǔ)言任務(wù)進(jìn)行了微調(diào),包含1750 億個(gè)參數(shù)」,還將為非商業(yè)研究用途免費(fèi)開(kāi)放。

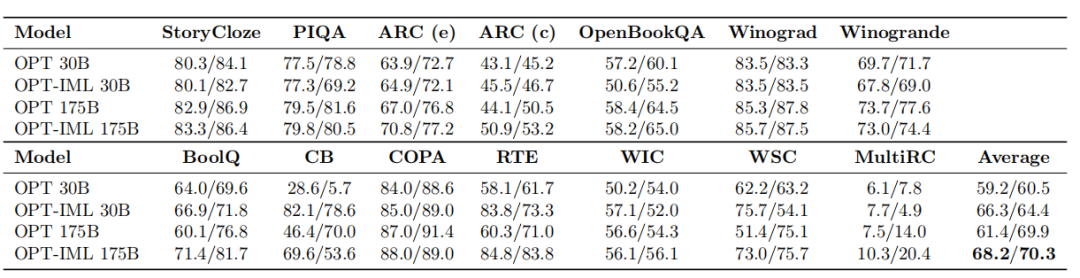

這次更新的OPT-IML的性能表現(xiàn)如何,先上兩張圖來(lái)看看。

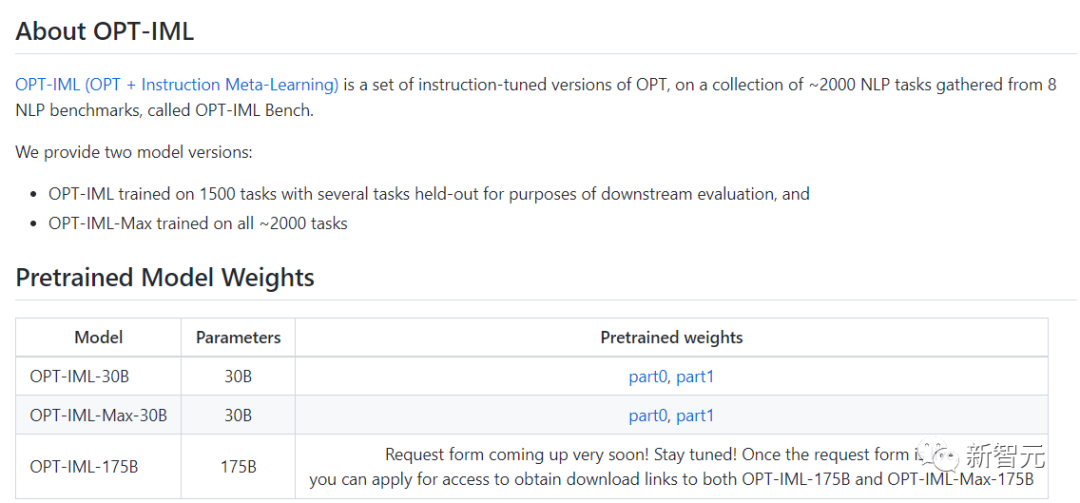

這次的OPT-IML創(chuàng)建了兩種模型尺寸,分別是30B和175B。

與舊版OPT模型相比,OPT-IML在14個(gè)標(biāo)準(zhǔn)NLP評(píng)估任務(wù)中的平均表現(xiàn)均優(yōu)于OPT。

在零次學(xué)習(xí)任務(wù)上兩種模型大小分別好7%~ 和32-shot 任務(wù)分別好4%~ 和 0.4%~。

在這項(xiàng)研究中,研究人員描述了增加模型和基準(zhǔn)大小如何影響指令調(diào)整決策對(duì)下游任務(wù)性能的影響。

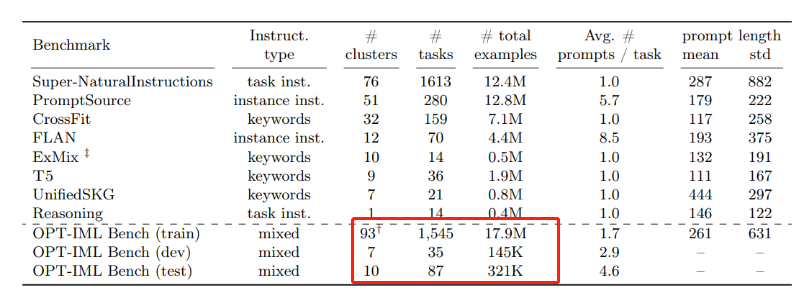

為此他們開(kāi)發(fā)了 OPT-IML Bench,這是一個(gè)相當(dāng)大的指令元學(xué)習(xí) (IML) 基準(zhǔn),包含2000個(gè)NLP任務(wù),這些任務(wù)根據(jù)現(xiàn)有的八個(gè)基準(zhǔn)分為任務(wù)類別。

為訓(xùn)練OPT-IML 30B和175B,研究人員首先從該框架的角度對(duì)應(yīng)用于 OPT-30B 的指令調(diào)優(yōu)決策提出了見(jiàn)解。

在具有不同目標(biāo)和輸入格式的四個(gè)評(píng)估基準(zhǔn)(PromptSource、FLAN、Super-NaturalInstructions 和 UnifiedSKG)上,OPT-IML 在兩個(gè)尺度上展示了所有三種泛化技能。

它不僅在所有基準(zhǔn)測(cè)試中顯著優(yōu)于OPT,而且以極具競(jìng)爭(zhēng)力的方式優(yōu)于針對(duì)該特定基準(zhǔn)優(yōu)化的現(xiàn)有模型。

此外OPT-IML已經(jīng)開(kāi)源,Github鏈接小編也放在下面啦~

Github鏈接:https://github.com/facebookresearch/metaseq/tree/main/projects/OPT-IML

接下來(lái)通過(guò)論文來(lái)一起了解一下OPT-IML。

論文鏈接:https://github.com/facebookresearch/metaseq/blob/main/projects/OPT-IML/optimal_paper_v1.pdf

研究方法

大型語(yǔ)言模型的指令微調(diào)已成為增強(qiáng)其零樣本和少樣本泛化能力的有效方法。在這項(xiàng)研究中,Meta研究人員對(duì)指令微調(diào)進(jìn)行了三項(xiàng)重要的補(bǔ)充。

首先,他們編譯了一個(gè)大規(guī)模的指令微調(diào)基準(zhǔn),其中包含來(lái)自八個(gè)數(shù)據(jù)集集合的2,000個(gè)NLP任務(wù),按任務(wù)類型分類。

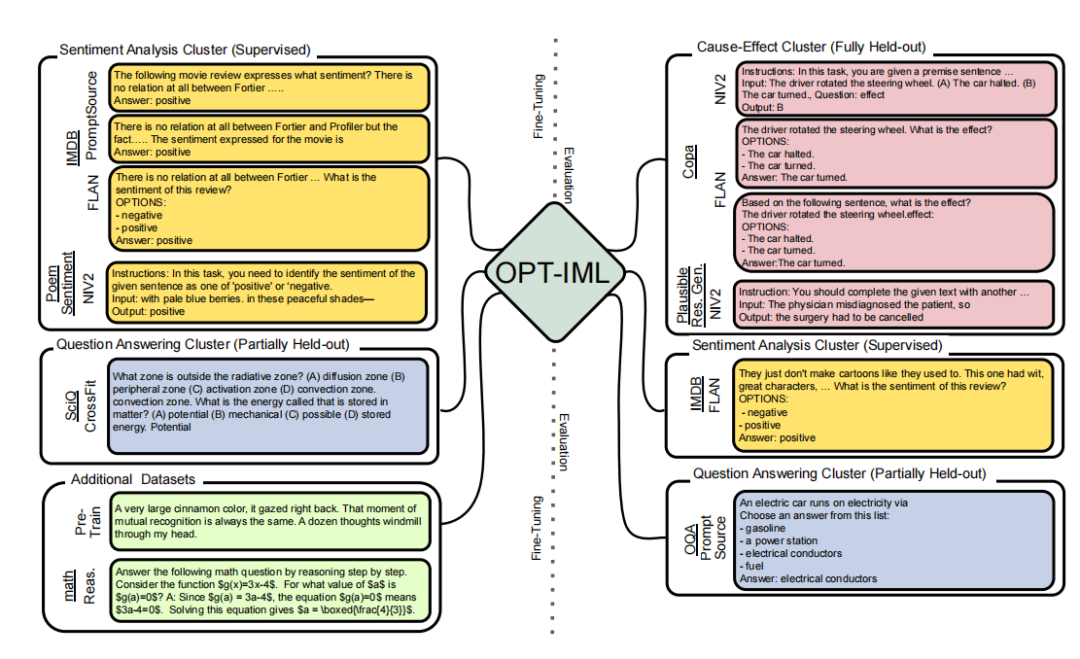

研究人員在此基準(zhǔn)上有選擇地構(gòu)建評(píng)估拆分,以測(cè)試三種不同類型的模型泛化能力:

包括來(lái)自完全保留類別的任務(wù)(tasks from fully held-out categories)、來(lái)自已見(jiàn)類型的保留任務(wù)(held-out tasks from seen types)以及來(lái)自已見(jiàn)任務(wù)的保留實(shí)例(held-out instances from seen tasks)。?

指令微調(diào)

對(duì)模型進(jìn)行微調(diào),以使它們與遵守說(shuō)明保持一致,是目前機(jī)器學(xué)習(xí)的研究方向之一。

指令微調(diào)有兩種方法。一種側(cè)重于使用人工注釋的指令和反饋對(duì)各種任務(wù)的模型進(jìn)行微調(diào);另一種,側(cè)重于通過(guò)注釋或自動(dòng)向可公開(kāi)訪問(wèn)的基準(zhǔn)和數(shù)據(jù)集添加指令。

在本研究中,Meta AI成員專注于第二種技術(shù),并編譯了許多可公開(kāi)訪問(wèn)的數(shù)據(jù)集,其中包含改進(jìn)OPT的方法。

研究過(guò)程中,Meta成員使用來(lái)自四個(gè)基準(zhǔn)的1836個(gè)任務(wù),提出了類似的縮放方法。最后,在調(diào)整整個(gè)測(cè)試,以突破具有挑戰(zhàn)性的外部基準(zhǔn)(例如 MMLU 和 Big-Bench Hard (BBH))性能極限的同時(shí),研究人員描述了可能影響下游性能的各種指令調(diào)整策略的權(quán)值。

多任務(wù)學(xué)習(xí)

多任務(wù)學(xué)習(xí)是基于指令的微調(diào) (MTL) 的一種表述。

MTL 是一種流行的范例,當(dāng)與共享可比較參數(shù)或表示的類似函數(shù)結(jié)合使用時(shí),它可以提高任務(wù)的泛化性能。

近年來(lái),MTL已應(yīng)用于眾多NLP場(chǎng)景,主要側(cè)重于通過(guò)利用來(lái)自相關(guān)活動(dòng)的信號(hào)來(lái)提高訓(xùn)練任務(wù)或新領(lǐng)域的性能。

相比之下,基于指令的微調(diào)有助于我們提高對(duì)前所未見(jiàn)問(wèn)題的泛化性能。它是通過(guò)指令將所有任務(wù)組合成一個(gè)概念并通過(guò)在所有任務(wù)上分配模型的權(quán)重來(lái)一起訓(xùn)練它們來(lái)實(shí)現(xiàn)的。

什么是OPT?

大型語(yǔ)言模型,即具有超過(guò) 1000 億個(gè)參數(shù)的自然語(yǔ)言處理系統(tǒng),在過(guò)去幾年中改變了NLP和AI研究。

這些模型接受了大量不同文本的訓(xùn)練,展現(xiàn)出令人驚訝的新能力,可以生成創(chuàng)意文本、解決基本數(shù)學(xué)問(wèn)題、回答閱讀理解問(wèn)題等等。

雖然在某些情況下,公眾可以通過(guò)付費(fèi) API 與這些模型進(jìn)行交互,但完整的研究訪問(wèn)權(quán)限仍然僅限于少數(shù)資源豐富的實(shí)驗(yàn)室。

這種受限訪問(wèn)限制了研究人員理解這些大型語(yǔ)言模型如何工作以及為何工作的能力,阻礙了提高其魯棒性和減輕偏見(jiàn)等已知問(wèn)題的進(jìn)展。

出于對(duì)開(kāi)放科學(xué)的承諾,Meta AI于今年5月發(fā)布了Open Pretrained Transformer (OPT-175B),這是一個(gè)具有 1750 億參數(shù)的模型,在公共數(shù)據(jù)集上訓(xùn)練而成,之所以共享這個(gè)模型,Meta AI 希望更多的社區(qū)參與理解關(guān)于大模型的基本技術(shù)。

簡(jiǎn)單來(lái)說(shuō),Meta將用于人工智能研究的大型語(yǔ)言模型訪問(wèn)權(quán)限開(kāi)放給大眾,從而實(shí)現(xiàn)大模型研究的人工智能民主化。

與老版對(duì)比

根據(jù)Meta現(xiàn)在發(fā)布的IML版本經(jīng)過(guò)微調(diào),在自然語(yǔ)言任務(wù)上的表現(xiàn)比舊版OPT更好。

典型的語(yǔ)言任務(wù)包括回答問(wèn)題、總結(jié)文本和翻譯。

為了進(jìn)行微調(diào),研究人員使用了大約2000個(gè)自然語(yǔ)言任務(wù)。這些任務(wù)分為八個(gè)NLP基準(zhǔn)(OPT-IML Bench),研究人員也提供了這些基準(zhǔn)。

平均而言,以30B和175B模型為例,OPT-IML比OPT的零次學(xué)習(xí)準(zhǔn)確度提高了約 6-7%。在32次學(xué)習(xí)中,300億參數(shù)的模型準(zhǔn)確度有顯著改進(jìn),1750億參數(shù)的模型有輕微改進(jìn)。

經(jīng)過(guò)對(duì)比,Meta團(tuán)隊(duì)發(fā)現(xiàn)OPT-IML的性能在所有基準(zhǔn)測(cè)試上都優(yōu)于OPT,并且在零樣本和少樣本學(xué)習(xí)準(zhǔn)確度方面,比其他基于指令微調(diào)的模型更具有競(jìng)爭(zhēng)力。