中山大學(xué)HCP Lab團(tuán)隊(duì):AI解題新突破,神經(jīng)網(wǎng)絡(luò)推開數(shù)學(xué)推理大門

人類在成長過程的不同階段均需要掌握很多的知識(shí)點(diǎn)來求解大量的數(shù)學(xué)題。然而,知識(shí)點(diǎn)看懂了不算真的懂,能求解題目才能體現(xiàn)人類的智慧。近年來,神經(jīng)網(wǎng)絡(luò)在計(jì)算機(jī)視覺,模式匹配、自然語言處理、強(qiáng)化學(xué)習(xí)等領(lǐng)域取得了巨大成功,但神經(jīng)網(wǎng)絡(luò)模型的離散組合推理能力遠(yuǎn)不及人類。那么,神經(jīng)網(wǎng)絡(luò)能否理解數(shù)學(xué)題,并解出這些題目呢?如果可以,那么神經(jīng)網(wǎng)絡(luò)的解題能力如何?

從數(shù)據(jù)形式上來說,一道數(shù)學(xué)題可以看作是一個(gè)序列,而其解答(解題步驟或者求解表達(dá)式)往往也是以序列的形式呈現(xiàn)。那么數(shù)學(xué)題求解可以看作是從自然語言到數(shù)學(xué)語言的翻譯問題,神經(jīng)網(wǎng)絡(luò)模型從形式上能求解數(shù)學(xué)問題。從前人的各種研究工作中可以獲知,神經(jīng)網(wǎng)絡(luò)能在翻譯問題上獲得很好的性能,并在多個(gè)數(shù)據(jù)集上獲得了超越了人類的性能。然而,與機(jī)器翻譯顯著不同,除了題目語義理解能力之外,數(shù)學(xué)題求解往往還需要模型具備對(duì)代數(shù)泛化對(duì)象和實(shí)體的離散組合推理能力。

為了探究深度模型對(duì)數(shù)學(xué)題的解題能力,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室在前人研究的基礎(chǔ)上以中小學(xué)數(shù)學(xué)應(yīng)用題和幾何計(jì)算題為切入點(diǎn),開展了一系列研究,改進(jìn)了深度模型的語義理解、認(rèn)知推理和數(shù)學(xué)解題能力。本文將對(duì)中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室在數(shù)學(xué)解題領(lǐng)域的一系列研究進(jìn)行簡要介紹。

論文1:Semantically-Aligned Universal Tree-Structured Solver for Math Word Problems

The 2020 Conference on Empirical Methods in Natural Language Processing

論文地址:https://aclanthology.org/2020.emnlp-main.309.pdf

一個(gè)實(shí)用的數(shù)學(xué)應(yīng)用題求解器應(yīng)該能夠解決各種類型的數(shù)學(xué)應(yīng)用題,如一元一次方程,二元一次方程組,一元二次方程等類型。然而,大多數(shù)的數(shù)學(xué)應(yīng)用題求解工作只針對(duì)四則運(yùn)算類題目進(jìn)行設(shè)計(jì),而這類設(shè)計(jì)往往難以擴(kuò)展到更多題型,無法使用一個(gè)統(tǒng)一的數(shù)學(xué)應(yīng)用題求解器同時(shí)求解各種類型表達(dá)式的應(yīng)用題。此外,當(dāng)下的大部分?jǐn)?shù)學(xué)應(yīng)用題求解器缺乏對(duì)題目文本和求解表達(dá)式之間的語義約束。

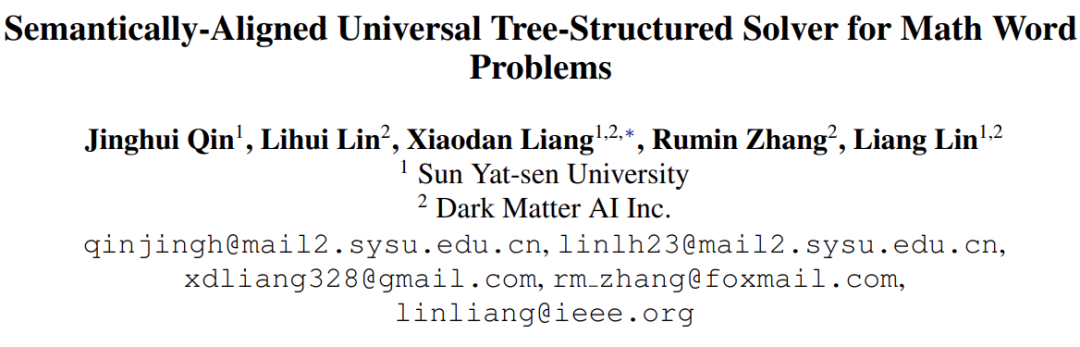

針對(duì)上述問題,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)提出一種統(tǒng)一表達(dá)式樹表示方案,通過引入額外的運(yùn)算符連結(jié)多個(gè)表達(dá)式,將一元一次方程,二元一次方程組,一元二次方程等類型的表達(dá)式進(jìn)行統(tǒng)一表示,從而可以簡化求解器的設(shè)計(jì)的同時(shí)也可以求解多種類型的應(yīng)用題,如圖 1 所示。

圖 1 統(tǒng)一表達(dá)式樹表示方案設(shè)計(jì)

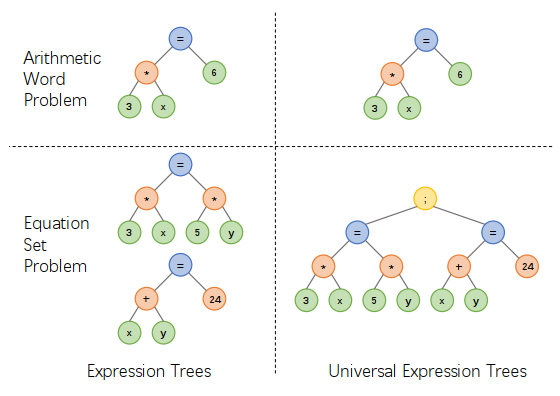

基于統(tǒng)一表達(dá)式樹表示方案,我們進(jìn)而提出了一種語義對(duì)齊的樹結(jié)構(gòu)通用求解器(SAU-Solver),如圖 2 所示。我們的樹結(jié)構(gòu)通用求解器由兩部分組成,基于雙層 GRU 的問題編碼器和基于統(tǒng)一表達(dá)式樹表示的樹結(jié)構(gòu)解碼器。并且在訓(xùn)練過程中,我們引入了語義對(duì)齊正則化,通過約束表達(dá)式子樹與題目上下文的一致性使得我們的通用求解器能更充分地考慮問題和表達(dá)式之間的語義關(guān)系,發(fā)掘各類數(shù)學(xué)知識(shí),從而提升求解器的表達(dá)式生成能力。

圖 2 語義對(duì)齊樹結(jié)構(gòu)求解器

此外,為了更好地衡量求解器的通用性和求解能力,我們還針對(duì)當(dāng)前標(biāo)注數(shù)據(jù)集中題型種類單一的問題,構(gòu)建了一個(gè)中等規(guī)模的多題型數(shù)據(jù)集 HMWP,該數(shù)據(jù)集包括了求解表達(dá)式為一元一次方程,二元一次方程組,一元二次方程等多種表達(dá)式類型的數(shù)千道數(shù)學(xué)文字題目。我們的實(shí)驗(yàn)表明,具有多題型的數(shù)據(jù)集比種類單一的數(shù)據(jù)集對(duì)求解器來說更具有挑戰(zhàn)性,也能更好地衡量求解器的解題能力,推動(dòng)求解器社區(qū)的研究。

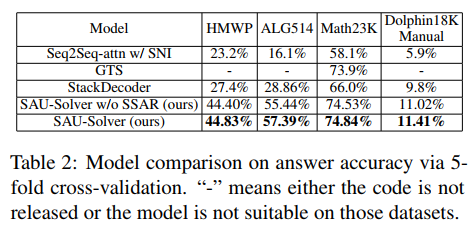

在實(shí)驗(yàn)中,文章將提出的 SAU-Solver 與現(xiàn)有方法在 HMWP、Math23K、ALG514 和 Dolphin18K-Manual 進(jìn)行了對(duì)比。實(shí)驗(yàn)結(jié)果如下圖所示,證明了我們方法的通用性和更好的數(shù)學(xué)解題能力。

更多研究細(xì)節(jié),可參考原論文。

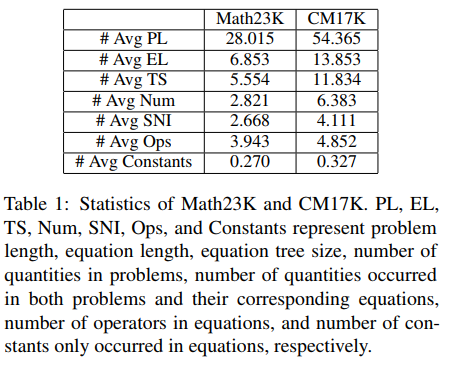

論文2:Neural-Symbolic Solver for Math Word Problems with Auxiliary Tasks

The 59th Annual Meeting of the Association for Computational Linguistics and the 11th International Joint Conference on Natural Language Processing

論文地址:https://arxiv.org/abs/2107.01431

當(dāng)前的初等數(shù)學(xué)應(yīng)用題求解器沒有考慮各種數(shù)學(xué)符號(hào)約束,而是僅是簡單地使用編碼器 - 解碼器框架進(jìn)行求解的問題,從而導(dǎo)致了不合理的預(yù)測(cè)。而引入符號(hào)約束和符號(hào)推理對(duì)于數(shù)學(xué)應(yīng)用題自動(dòng)求解是非常關(guān)鍵的。

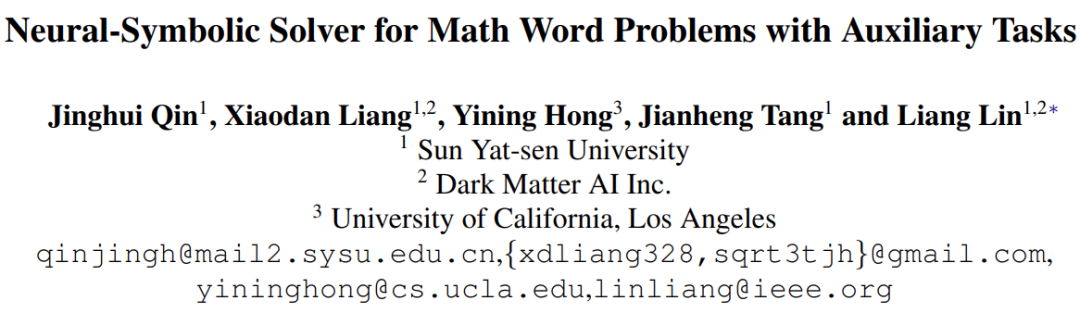

因此,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)引入神經(jīng) - 符號(hào)計(jì)算范式,提出新型的神經(jīng) - 符號(hào)求解器(NS-Solver),以輔助任務(wù)的方式進(jìn)行顯式的知識(shí)注入,從而實(shí)現(xiàn)不同層級(jí)的符號(hào)約束。其技術(shù)架構(gòu)如圖 3 所示。NS-Solver 在網(wǎng)絡(luò)骨干上由三個(gè)組件構(gòu)建:1)Problem Reader,通過雙層雙向 GRU 網(wǎng)絡(luò)對(duì)數(shù)學(xué)題進(jìn)行高效的語義理解和表示;2)Programmer,負(fù)責(zé)基于問題語義以及常識(shí)預(yù)測(cè)結(jié)果進(jìn)行符號(hào)推理,生成求解表達(dá)式。3)Executor,利用 sympy 庫進(jìn)行表達(dá)式求解,獲取最終答案。

在符號(hào)約束上,我們提出多種輔助任務(wù)來利用額外的訓(xùn)練信號(hào)和利用常識(shí)預(yù)測(cè)結(jié)果來顯式地約束符號(hào)表,降低問題求解搜索空間:1)自監(jiān)督的數(shù)字預(yù)測(cè)任務(wù):通過預(yù)測(cè)題目中數(shù)字的位置和數(shù)量來更好地理解題目語義;2)常識(shí)量詞預(yù)測(cè)任務(wù):注入常識(shí)知識(shí)并利用預(yù)測(cè)結(jié)果約束符號(hào)表,降低搜索空間;3)一致性檢查:從語義層面檢查解題器的輸出與目標(biāo)表達(dá)式的一致性;4)對(duì)偶利用任務(wù):通過問題到表達(dá)式和表達(dá)式到問題的雙向約束,強(qiáng)化解題器的問題語義理解。

圖 3 神經(jīng) - 符號(hào)求解器(NS-Solver)

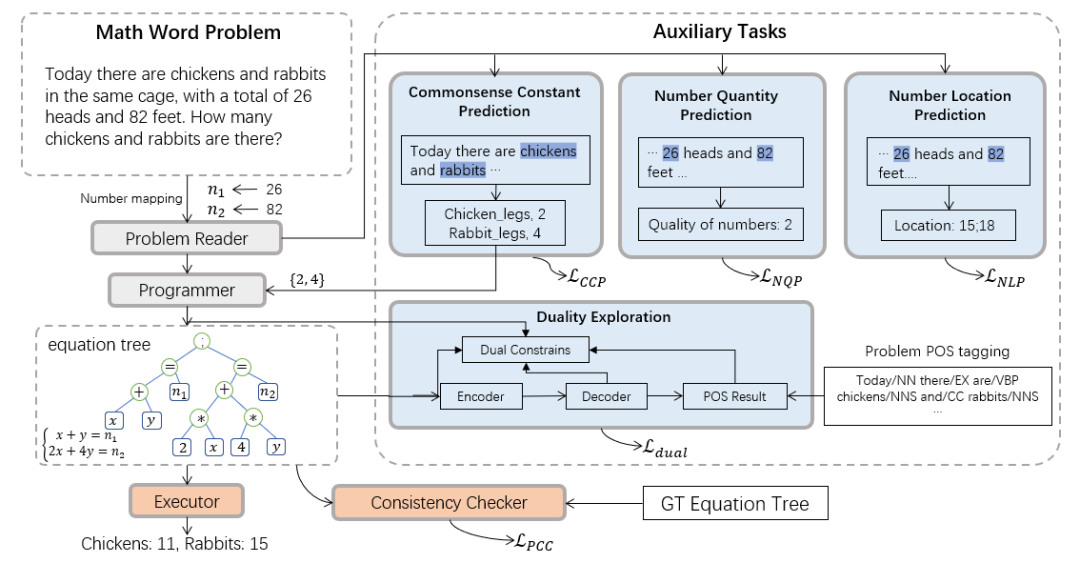

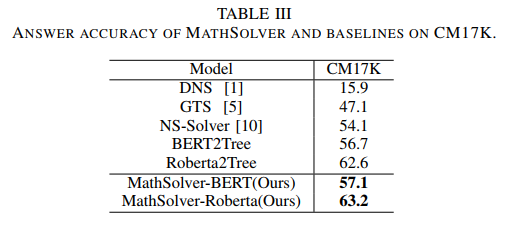

此外,為了更好地驗(yàn)證求解器的性能,我們還構(gòu)建了一個(gè)更大規(guī)模的多題型數(shù)學(xué)應(yīng)用題數(shù)據(jù)集 CM17K,從而更好地推動(dòng)數(shù)學(xué)解題社區(qū)的研究。CM17K 包含了 6215 道四則運(yùn)算類應(yīng)用題,5193 道一元一次方程類應(yīng)用題,3129 道一元非線性方程類應(yīng)用題和 2498 道方程組類應(yīng)用題。CM17K 和 Math23K 的數(shù)據(jù)統(tǒng)計(jì)如下表所示。從數(shù)據(jù)統(tǒng)計(jì)上可以看出,CM17K 相比 Math23K 具有更長的題目信息,更長的求解表達(dá)式,涉及更多的常識(shí)等,這意味著 CM17K 在求解難度上更好地刻畫解題器的性能。

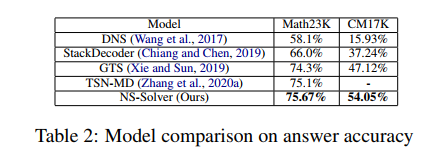

在實(shí)驗(yàn)中,文章將提出的 NS-Solver 與現(xiàn)有方法在 Math23K 和 CM17K 上進(jìn)行了對(duì)比,并進(jìn)行了消融實(shí)驗(yàn),證明了 NS-Solver 良好的解題能力和通用性。其實(shí)驗(yàn)結(jié)果如下面兩個(gè)表所示。

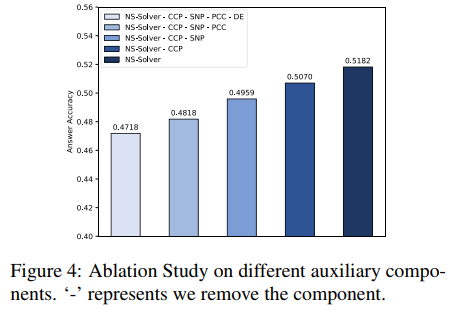

此外,我們還對(duì)輔助任務(wù)進(jìn)行了消融實(shí)驗(yàn),如下圖所示。實(shí)驗(yàn)結(jié)果證明了各個(gè)輔助任務(wù)均能提升 NS-Solver 的解題能力。

更多研究細(xì)節(jié),可參考原論文。

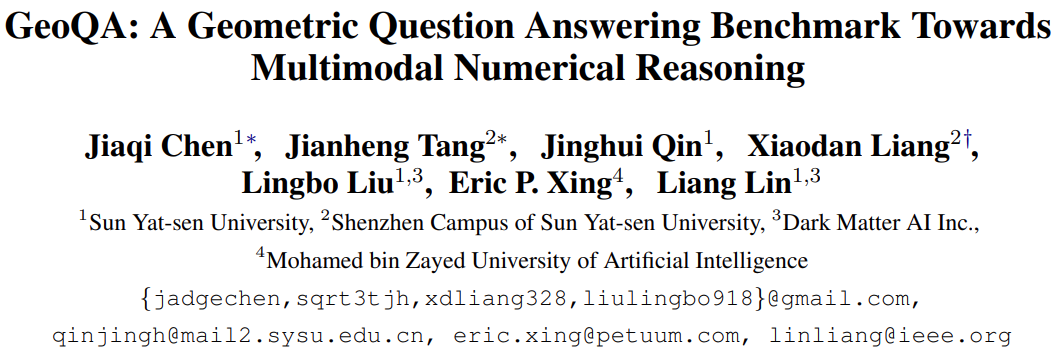

論文3:GeoQA – A Geometric Question Answering Benchmark Towards Multimodal Numerical Reasoning

Findings of the Association for Computational Linguistics: ACL-IJCNLP 2021

論文地址:https://arxiv.org/pdf/2105.14517.pdf

自動(dòng)數(shù)學(xué)解題最近獲得了越來越多的關(guān)注。自動(dòng)數(shù)學(xué)解題大多數(shù)工作關(guān)注數(shù)學(xué)應(yīng)用題自動(dòng)求解。然而很少工作關(guān)注幾何題。相比較于數(shù)學(xué)應(yīng)用題,幾何題需要同時(shí)對(duì)文本描述、圖形圖表進(jìn)行理解,因?yàn)樵趲缀晤}目中,題目文本和圖形圖表通常是相輔相成,缺一不可的。現(xiàn)有的幾何題自動(dòng)求解方法高度依賴規(guī)則并只在小數(shù)據(jù)集上進(jìn)行評(píng)估。

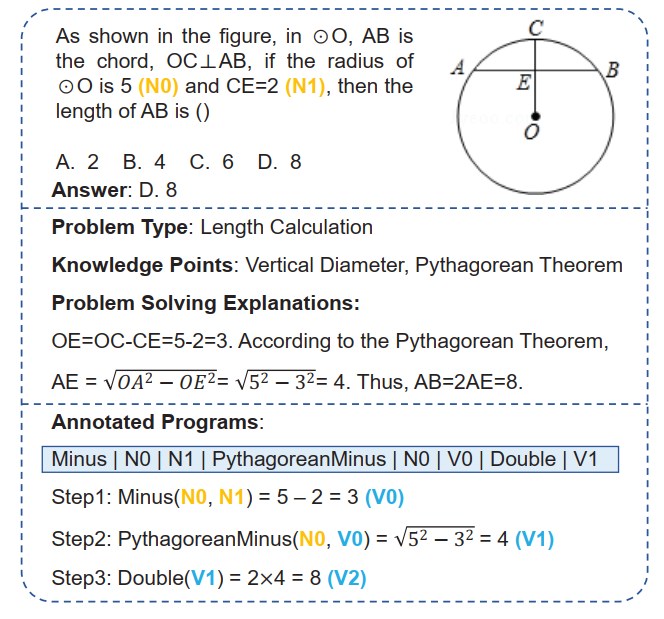

圖 4 幾何題樣例

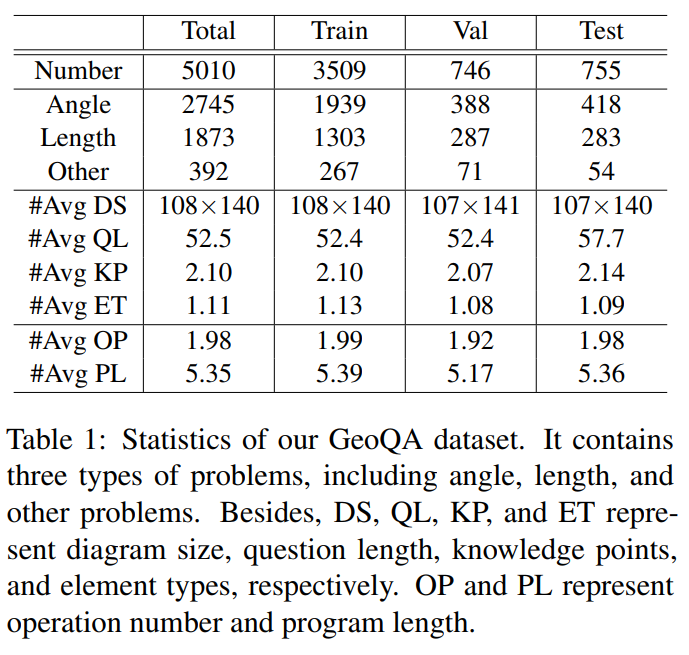

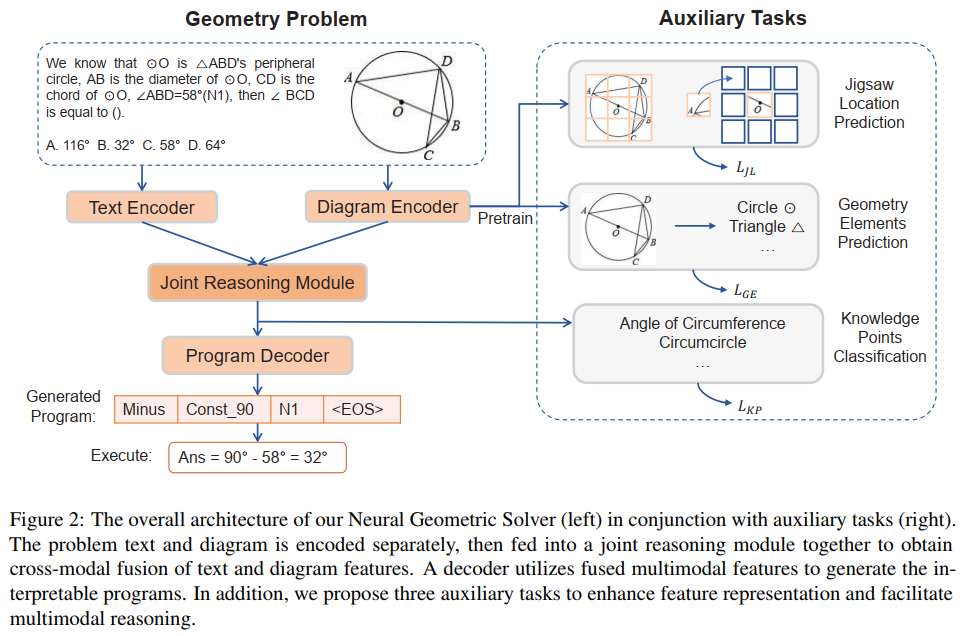

為了推動(dòng)幾何題自動(dòng)求解的研究,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)構(gòu)建了一個(gè)由 5010 道幾何選擇題組成的問答數(shù)據(jù)集 GeoQA。如圖 4 所示,GeoQA 數(shù)據(jù)集中的每一個(gè)樣本具有題目描述、幾何圖像、問題選項(xiàng)、答案、問題類型、知識(shí)點(diǎn)、解答解析,以及按解題步驟標(biāo)注的形式程序。在題目規(guī)模上,該數(shù)據(jù)集是前人工作常用的 GeoS 數(shù)據(jù)集的 25 倍。GeoQA 數(shù)據(jù)集的相關(guān)統(tǒng)計(jì)信息如下表所示。

而 GeoQA 數(shù)據(jù)集所使用的形式程序算子和所涉及的常量如下表所示。

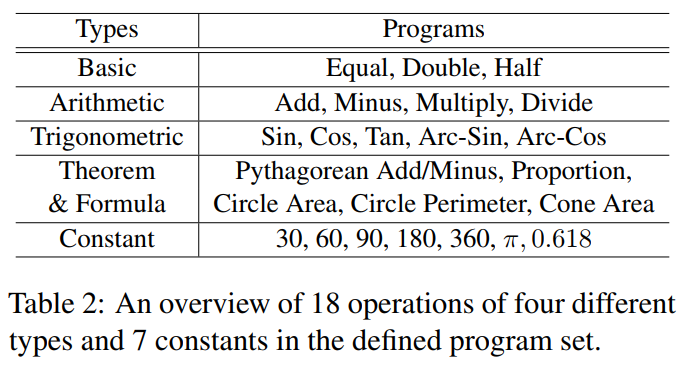

為了更好地促進(jìn)幾何題求解器的研究,我們除了在 GeoQA 數(shù)據(jù)集的基礎(chǔ)上搭建了一些基線模型外,還提出了神經(jīng)幾何題求解器 NGS 來理解多模態(tài)語義信息并生成具有解釋性的形式化程序。神經(jīng)幾何題求解器 NGS 的總體設(shè)計(jì)如圖 5 所示。

圖 5 神經(jīng)幾何題求解器(NGS)示意圖

我們的 NGS 主要由文本編碼器、幾何圖形編碼器,聯(lián)合推理模塊和程序解碼器組成。文本編碼器負(fù)責(zé)對(duì)題目文本語義表征,幾何圖形編碼器則負(fù)責(zé)幾何圖形的表征。文本表征和圖形表征均會(huì)輸入到聯(lián)合推理模型進(jìn)行多模態(tài)語義表征,并投喂到程序解碼器中進(jìn)行程序解碼,輸出可解釋可執(zhí)行的形式化求解程序。

此外,為了增強(qiáng)幾何圖形編碼器對(duì)幾何圖形的表征能力以及推進(jìn)聯(lián)合推理模塊對(duì)題目所包含的多模態(tài)信息進(jìn)行充分融合和高效表達(dá),我們還引入了多種輔助任務(wù)來改善模型的表征能力和注入定理知識(shí)。這些輔助任務(wù)包括:1)拼圖位置預(yù)測(cè):通過把幾何圖形切割為多個(gè) patch,并隨機(jī)排列,然后讓幾何圖形編碼器對(duì)其重新排列,實(shí)現(xiàn)對(duì)幾何圖形的像素級(jí)圖形理解;2)幾何元素預(yù)測(cè):讓幾何圖形編碼器學(xué)習(xí)預(yù)測(cè)哪些幾何元素出現(xiàn)在了當(dāng)前的幾何圖形中,實(shí)現(xiàn)對(duì)象級(jí)圖形理解;3)知識(shí)點(diǎn)預(yù)測(cè):在聯(lián)合推理模塊進(jìn)行題目文本表征和幾何圖形表征的多模態(tài)融合的同時(shí)引入知識(shí)點(diǎn)分類任務(wù)來改進(jìn)整體的問題表征。在 NGS 中,我們利用拼圖位置預(yù)測(cè)和幾何元素預(yù)測(cè)對(duì)幾何圖形編碼器進(jìn)行預(yù)訓(xùn)練。而知識(shí)點(diǎn)預(yù)測(cè)任務(wù)則作為一個(gè)子任務(wù)和 NGS 進(jìn)行多任務(wù)訓(xùn)練。

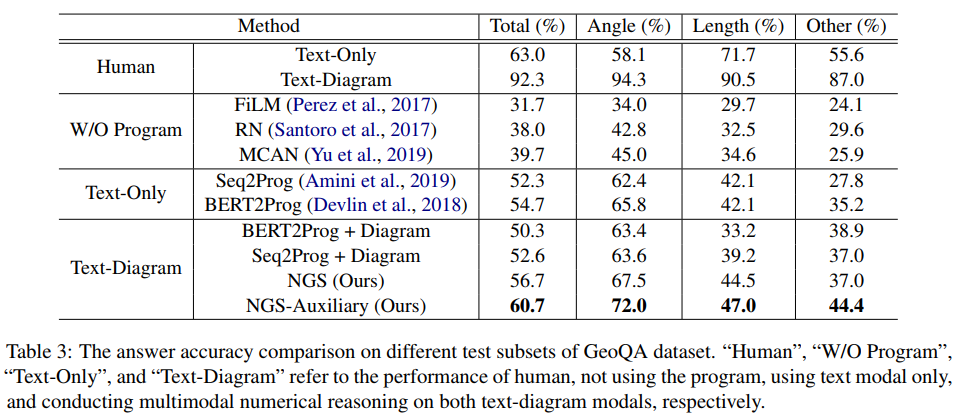

在實(shí)驗(yàn)中,文章基于 GeoQA 構(gòu)建了多個(gè)基于神經(jīng)網(wǎng)絡(luò)的基線模型,并將 NGS 與他們進(jìn)行對(duì)比。NGS 和基線模型在 GeoQA 上的實(shí)驗(yàn)效果如下表所示。

從上表可以看到,NGS 相比基線模型在 GeoQA 上能達(dá)到更好的解題性能。但是我們也可以看到各類模型與人類在幾何題求解上仍然存在較大的差距。

此外,我們還進(jìn)行了各種消融實(shí)驗(yàn),驗(yàn)證了 NGS 中各種設(shè)計(jì)的有效性。更多研究細(xì)節(jié),可參考原論文。

論文4:Unbiased Math Word Problems Benchmark for Mitigating Solving Bias

Findings of the Association for Computational Linguistics: NAACL 2022

論文地址:https://aclanthology.org/2022.findings-naacl.104.pdf

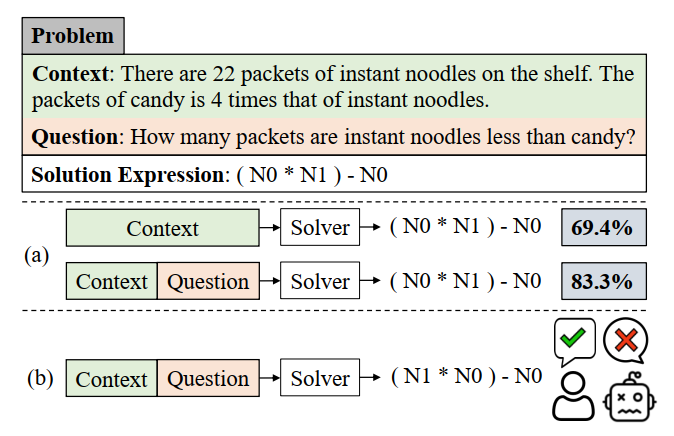

在這個(gè)工作中,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)重新審視在當(dāng)前的數(shù)學(xué)應(yīng)用題求解基準(zhǔn)上評(píng)估模型的解題偏置(solving bias)。這種解題偏置主要數(shù)據(jù)偏置(data bias)和學(xué)習(xí)偏置(learning bias)引起。數(shù)據(jù)偏置(data bias)是指訓(xùn)練數(shù)據(jù)集未能涵蓋每個(gè)問題的所有不同敘述方式而導(dǎo)致的解題模型只能學(xué)習(xí)到淺層語義,未能對(duì)題意進(jìn)行深度語義理解的問題,如圖 6(a)所示,由于解題模型只學(xué)習(xí)到淺層語義,并以此來進(jìn)行解題, 那么即使我們把題目中的問題部分移除后,解題器仍然能達(dá)到 69.4%。

而學(xué)習(xí)偏置則是指一個(gè) MWP 可以由多個(gè)等價(jià)的表達(dá)式來求解,但是當(dāng)前的數(shù)據(jù)集均只采用其中某一個(gè)等價(jià)方程作為標(biāo)簽,強(qiáng)制模型學(xué)習(xí)該標(biāo)簽,而忽略了其他等價(jià)方程,導(dǎo)致學(xué)習(xí)訓(xùn)練的偏置。如圖 6(b)所示,在訓(xùn)練過程中,模型可能會(huì)生成與 GroundTruth 表達(dá)式不一致但是答案是正確的表達(dá)式,但是由于數(shù)據(jù)集只采用了某一等價(jià)表達(dá)式作為標(biāo)簽,會(huì)導(dǎo)致在計(jì)算損失函數(shù)時(shí)認(rèn)為該表達(dá)式是錯(cuò)誤表達(dá)式,并將兩個(gè)正確表達(dá)式之間的損失反向傳播給求解模型,導(dǎo)致了模型的過度矯正。

圖 6 數(shù)據(jù)偏置和學(xué)習(xí)偏置的示例

為了緩解數(shù)據(jù)偏置(data bias),中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)作了一個(gè)新的嘗試,我們以盡可能覆蓋題目問法的方式重新標(biāo)注了一個(gè)新的 MWP 基準(zhǔn) UnbiasedMWP。我們采集了 2907 到應(yīng)用題作為基礎(chǔ)問題,然后我們?yōu)槊總€(gè)問題中所蘊(yùn)涵的故事標(biāo)注盡可能多的問題。

為了簡化人工標(biāo)注過程,我們首先根據(jù)題目骨干的內(nèi)容生成一些合理的表達(dá)式,然后再反向重寫問題。為了生成合理的表達(dá)式,我們?cè)O(shè)計(jì)了三種表達(dá)式變種方式:1)Variable assortment (Va) 變形:從題目骨干隨機(jī)選擇兩個(gè)數(shù)字變量,并使用數(shù)學(xué)運(yùn)算符(+、-、*、/)對(duì)他們進(jìn)行組合,例如 n0 + n1, n0 ? n1 等。2)Subexpression (Sub) 變形:對(duì)原題目的目標(biāo)表達(dá)式所蘊(yùn)含的所有子表達(dá)是運(yùn)算符的修改,從而獲得新的表達(dá)式。3)Whole-expression (Whole)變形:通過改變?cè)}目的目標(biāo)表達(dá)式所包含的運(yùn)算符來獲取新的表達(dá)式。對(duì)于從上述三個(gè)變種獲取得到的新表達(dá)式集進(jìn)行人工過濾,過濾出無法進(jìn)行新問題標(biāo)注的表達(dá)式,對(duì)剩余表達(dá)式進(jìn)行人工問題標(biāo)注。

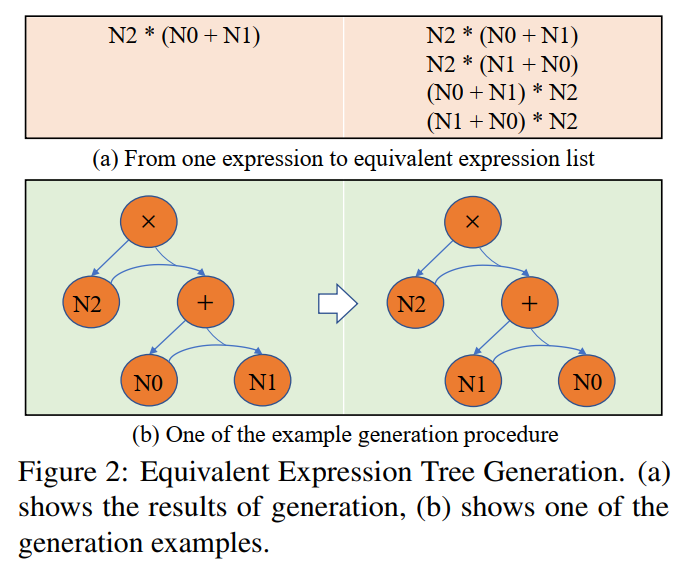

為了緩解學(xué)習(xí)偏置(learning bias),我們提出動(dòng)態(tài)目標(biāo)選擇策略,在訓(xùn)練過程中根據(jù)模型輸出的結(jié)果來選擇與其更加接近的目標(biāo)表達(dá)式來作為 GroundTruth。為了獲得等價(jià)的表達(dá)式,我們利用數(shù)學(xué)運(yùn)算中的交換律來對(duì)表達(dá)式樹進(jìn)行變形,從而獲得多個(gè)等價(jià)的表達(dá)式。如圖 7 所示。

圖 7 等價(jià)表達(dá)式樹生成示意圖

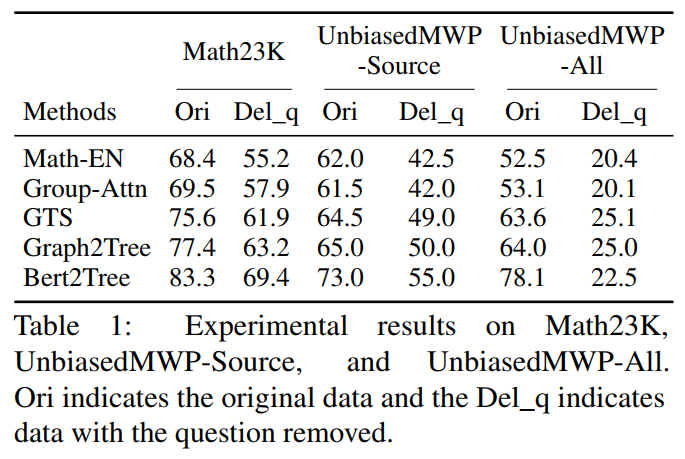

在實(shí)驗(yàn)中,文章首先在多個(gè) SOTA 基線模型上對(duì) UnbiasedMWP 數(shù)據(jù)集進(jìn)行驗(yàn)證。其實(shí)驗(yàn)結(jié)果如下表所示。

從實(shí)驗(yàn)結(jié)果可以看到,相比于現(xiàn)存的 Math23K,我們的數(shù)據(jù)集 UnbiasedMWP 所存在的數(shù)據(jù)偏置更少,因?yàn)楫?dāng)我們移除了題目問題后,模型的求解性能急劇下降,從側(cè)面證明了我們的數(shù)據(jù)集更加能使得模型需要關(guān)注深層語義信息才能進(jìn)行求解。

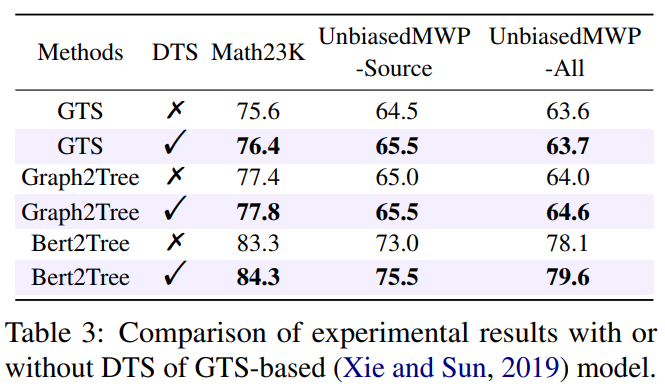

為了驗(yàn)證我們的動(dòng)態(tài)目標(biāo)選擇策略是否能降低學(xué)習(xí)偏置,我們將動(dòng)態(tài)目標(biāo)選擇策略應(yīng)用在多個(gè)解題模型上。實(shí)驗(yàn)結(jié)果如下表所示。

從實(shí)驗(yàn)結(jié)果可以看到,我們的動(dòng)態(tài)目標(biāo)選擇策略能有效地降低學(xué)習(xí)偏置,并提升了模型的求解效果。更多研究細(xì)節(jié),可參考原論文。

論文5:LogicSolver: Towards Interpretable Math Word Problem Solving with Logical Prompt-enhanced Learning

Findings of the Association for Computational Linguistics: EMNLP 2022

論文地址:https://arxiv.org/pdf/2205.08232.pdf

近年來,深度學(xué)習(xí)模型在數(shù)學(xué)應(yīng)用題自動(dòng)求解任務(wù)上取得了很大的成功,特別是在答案準(zhǔn)確率方面。但是由于這些模型只利用了統(tǒng)計(jì)線索(shallow heuristics)實(shí)現(xiàn)了高求解性能,并沒有真正地理解和推理題目背后的數(shù)學(xué)邏輯,因此,這些方法是難以解釋的。

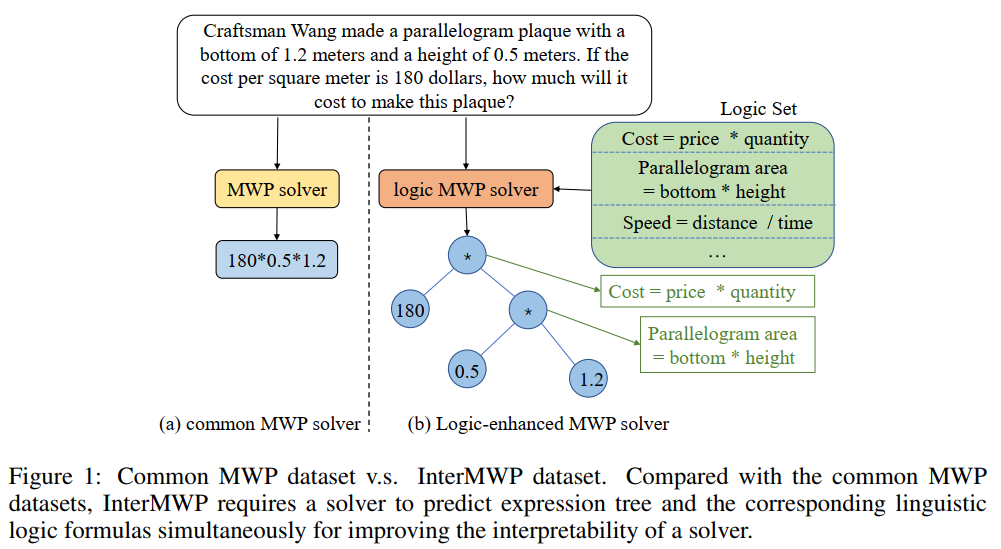

為了解決該問題并推動(dòng)可解釋數(shù)學(xué)應(yīng)用題求解領(lǐng)域的發(fā)展,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)構(gòu)建了第一個(gè)高質(zhì)量的帶解釋的數(shù)學(xué)應(yīng)用題數(shù)據(jù)集 InterMWP。該數(shù)據(jù)集包含了 11,495 道數(shù)學(xué)應(yīng)用題和 210 種基于代數(shù)知識(shí)的邏輯公式,每道應(yīng)用題的求解表達(dá)式均使用邏輯公式進(jìn)行標(biāo)注。與現(xiàn)有的數(shù)學(xué)應(yīng)用題求解數(shù)據(jù)集不同,我們的 InterMWP 不僅要求解題器輸出求解表達(dá)式,還要求解題器輸出該求解表達(dá)式所對(duì)應(yīng)的基于代數(shù)知識(shí)的邏輯表達(dá)式,從而實(shí)現(xiàn)對(duì)模型輸出的解釋。InterMWP 數(shù)據(jù)集與其他解題數(shù)據(jù)集的異同可以參考圖 8。具體的標(biāo)注過程可以參考原文。

圖 8 InterMWP 數(shù)據(jù)集示例

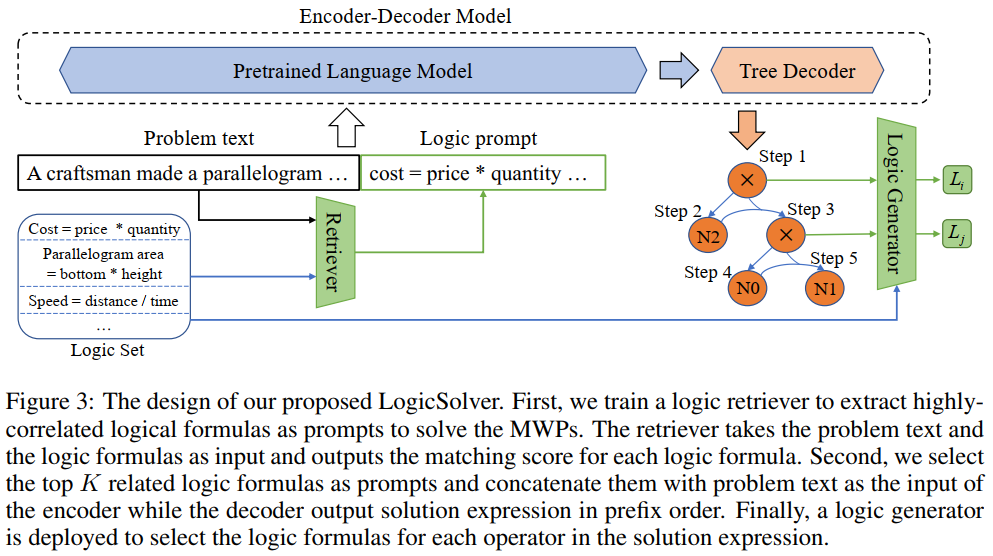

為了利用數(shù)學(xué)邏輯知識(shí)并賦能 MWP 解題器具備可解釋性,我們團(tuán)隊(duì)進(jìn)一步地構(gòu)建了新的數(shù)學(xué)應(yīng)用題求解框架 LogicSolver,如圖 9 所示。該框架通過檢索的方式從邏輯公式庫提取相關(guān)的邏輯知識(shí)作為提示信息,改進(jìn)問題編碼器對(duì) MWP 的語義表示的同時(shí)增強(qiáng) MWP 的邏輯解釋的生成能力。

圖 9 LogicSolver 設(shè)計(jì)示意圖

LogicSolver 主要由邏輯知識(shí)檢索組件、邏輯提示增強(qiáng) MWP 求解器和解釋生成組件三大組件構(gòu)成。邏輯知識(shí)檢索組件。對(duì)于每一道 MWP,我們從 210 種邏輯公式檢索 top-k 個(gè)高度相關(guān)的邏輯公式作為提示,以增強(qiáng) MWP 的求解。我們將邏輯公式提示與問題文本連接起來作為輸入,驅(qū)動(dòng) MWP 模型生成求解表達(dá)式。最后,為了獲取基于邏輯公式的解釋,我們部署一個(gè)邏輯生成器來預(yù)測(cè)邏輯表達(dá)式樹的每個(gè)內(nèi)部節(jié)點(diǎn)(即運(yùn)算符)所對(duì)應(yīng)的邏輯公式作為求解的解釋。

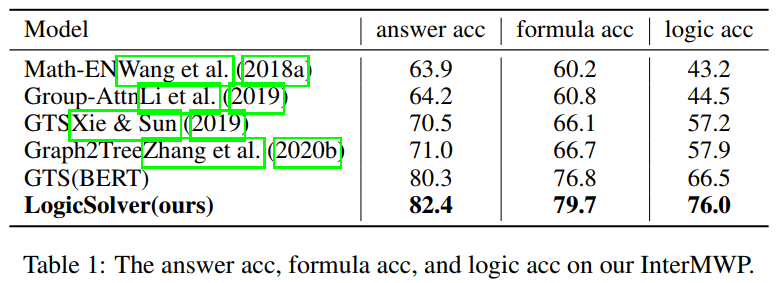

在實(shí)驗(yàn)中,我們?cè)?InterMWP 數(shù)據(jù)集上構(gòu)建了多個(gè)基線模型,并將我們的 LogicSolver 與這些基線模型進(jìn)行對(duì)比。其實(shí)驗(yàn)結(jié)果如下表所示。

從實(shí)驗(yàn)結(jié)果可以看出,我們的 LogicSolver 在答案準(zhǔn)確度,公式準(zhǔn)確率,以及邏輯公式準(zhǔn)確度上均能獲得提升,說明了我們的 LogicSolver 在改善求解性能(Answer Acc 和 Formula Acc)的同時(shí)能具有更好的邏輯解釋性(Logic Acc)。更多研究細(xì)節(jié),可參考原論文。

論文 6:UniGeo: Unifying Geometry Logical Reasoning via Reformulating Mathematical Expression

Jiaqi Chen, Tong Li, Jinghui Qin, Pan Lu, Liang Lin, Chongyu Chen and Xiaodan Liang

The 2022 Conference on Empirical Methods in Natural Language Processing

幾何題自動(dòng)求解是一個(gè)用于評(píng)估深度模型多模態(tài)推理能力的基準(zhǔn)。然而,在大多數(shù)現(xiàn)有的工作中,幾何計(jì)算題自動(dòng)求解和幾何題自動(dòng)證明通過會(huì)被視作兩個(gè)不同的任務(wù),并施加不同的標(biāo)注處理,妨礙了深度模型在不同數(shù)學(xué)任務(wù)進(jìn)行統(tǒng)一推理的研究進(jìn)展。從本質(zhì)上來說,幾何計(jì)算題和幾何證明題目具有相似的問題表達(dá)和解題所需的數(shù)學(xué)知識(shí)也有所重疊。因此,通過對(duì)幾何計(jì)算題自動(dòng)求解和幾何題自動(dòng)兩個(gè)任務(wù)進(jìn)行統(tǒng)一表示和學(xué)習(xí)有助于提升深度模型對(duì)這兩種問題的語義理解和符號(hào)推理。

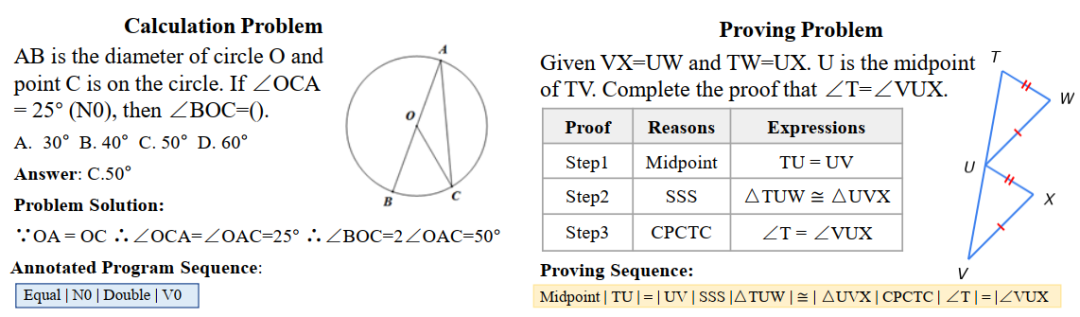

為此,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)構(gòu)建了一個(gè)包含了數(shù)千道幾何題的基準(zhǔn)數(shù)據(jù)集 UniGeo。UniGeo 包括了 4,998 道幾何計(jì)算題和 9,543 個(gè)幾何證明題。我們對(duì)每個(gè)證明題均進(jìn)行了多步驟證明標(biāo)注,且這些標(biāo)注可以很輕易地被轉(zhuǎn)換為可執(zhí)行的符號(hào)程序。而計(jì)算題也采用類似的標(biāo)注,如圖 10 所示。經(jīng)過采用如圖 10 所示的方式進(jìn)行標(biāo)注后,UniGeo 能很好地以形式化符號(hào)語言將幾何計(jì)算題和幾何證明題進(jìn)行統(tǒng)一的表示。

圖 10 UniGeo 數(shù)據(jù)樣例

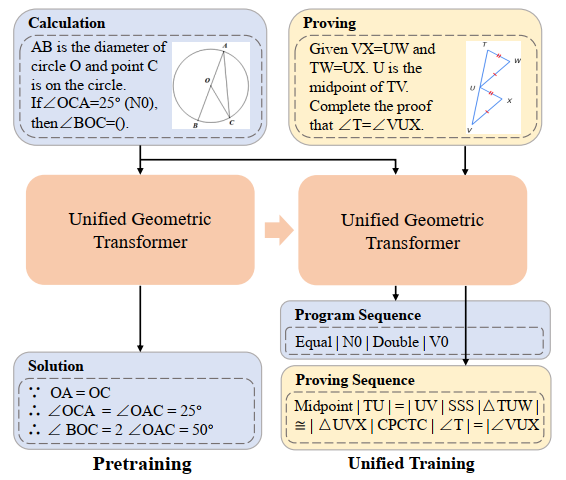

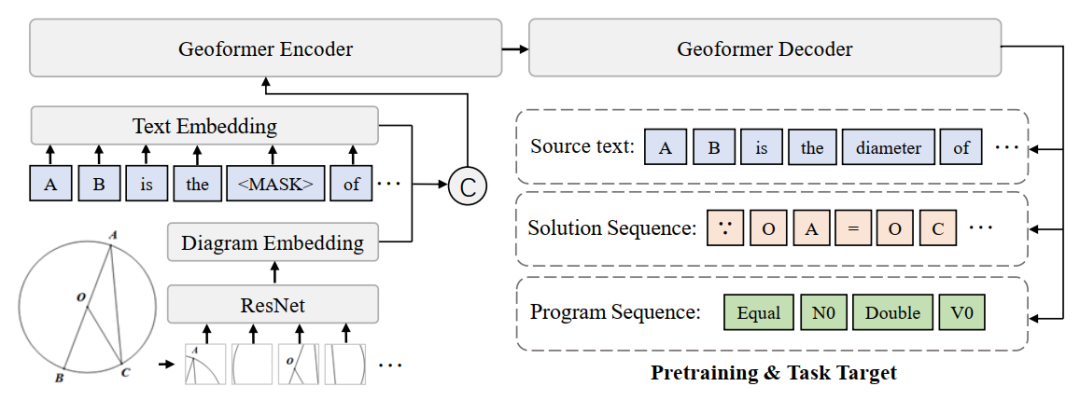

在利用形式化符號(hào)語言對(duì)幾何計(jì)算題和幾何證明題進(jìn)行統(tǒng)一標(biāo)注后,為了驗(yàn)證這兩種題目的統(tǒng)一表示能有效地促進(jìn)模型對(duì)幾何計(jì)算題和幾何證明題的語義理解和符號(hào)推理能力,從而實(shí)現(xiàn)更高效的計(jì)算題求解和證明題證明。中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)構(gòu)建了面向幾何題求解和證明統(tǒng)一處理的 Geoformer 來同時(shí)處理幾何計(jì)算題和幾何證明題,如圖 11 所示。

圖 11 GeoFormer 示意圖

此外,為了習(xí)得高效的 Geoformer 實(shí)現(xiàn)統(tǒng)一的幾何推理,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)還進(jìn)一步地提出數(shù)學(xué)表達(dá)預(yù)訓(xùn)練任務(wù),結(jié)合 MLM 任務(wù)對(duì) Geoformer 進(jìn)行任務(wù)預(yù)訓(xùn)練,如圖 12 所示。

圖 12 數(shù)學(xué)表達(dá)預(yù)訓(xùn)練示意圖

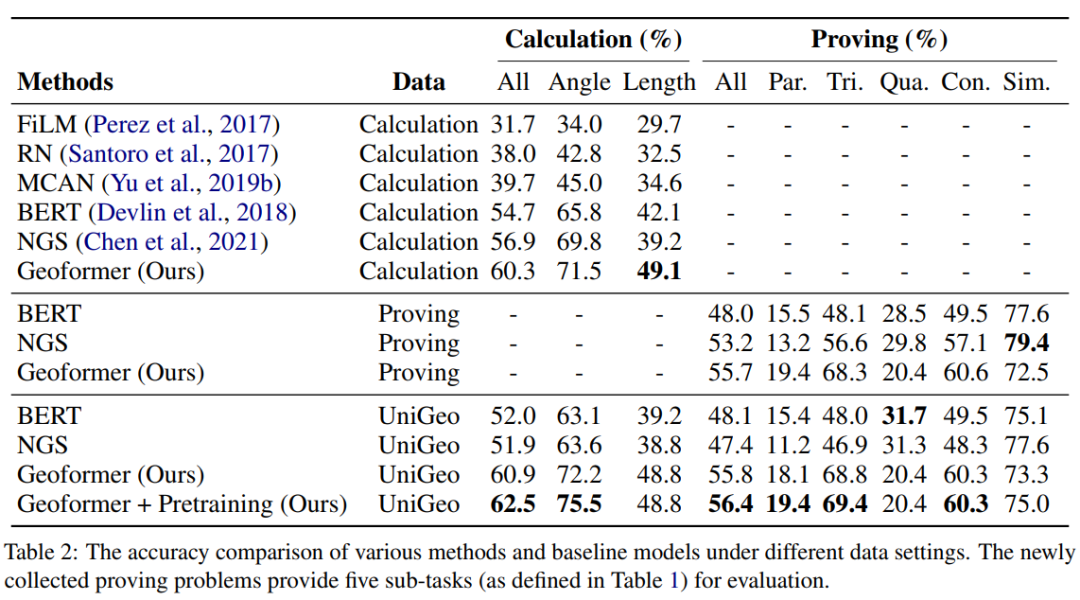

在實(shí)驗(yàn)中,我們?cè)?UniGeo 基準(zhǔn)的基礎(chǔ)上構(gòu)建多個(gè)基線模型,并對(duì)我們提出的 GeoFormer 進(jìn)行性能對(duì)比。實(shí)驗(yàn)結(jié)果如下表所示。

從實(shí)驗(yàn)結(jié)果可以看到,我們提出的 GeoFormer 在計(jì)算題和證明題兩個(gè)子數(shù)據(jù)集上均能獲得比基線模型更好的總體性能。類似地,在需要統(tǒng)一求解計(jì)算題和證明題的全數(shù)據(jù)集上 GeoFormer 相比 NGS 和 BERT 基線模型也是更優(yōu)勝的。而在經(jīng)過數(shù)學(xué)表達(dá)預(yù)訓(xùn)練和 MLM 預(yù)訓(xùn)練后,GeoFormer+Pretraining 相比 GeoFormer 會(huì)有進(jìn)一步的性能提升。這些實(shí)驗(yàn)結(jié)果充分證明了 GeoFormer 的有效性,也說明了對(duì)幾何計(jì)算題和幾何證明題進(jìn)行統(tǒng)一模型推理對(duì)于各自的任務(wù)來說也是有幫助的。

該工作已被 EMNLP2022 主會(huì)收錄,更多研究細(xì)節(jié),更多細(xì)節(jié)敬請(qǐng)期待。

論文 7:Template-based Contrastive Distillation Pre-training for Math Word Problem Solving

Jinghui Qin*, Zhicheng Yang*, Jiaqi Chen, Xiaodan Liang and Liang Lin

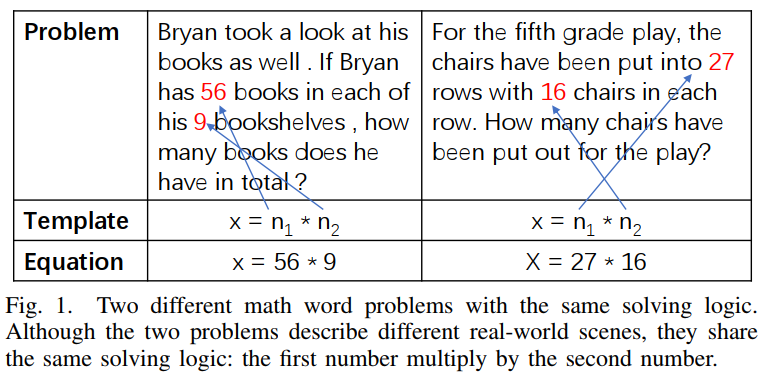

雖然深度學(xué)習(xí)模型在數(shù)學(xué)解題領(lǐng)域取得很好的進(jìn)展,但是這些模型忽視了蘊(yùn)涵在問題描述中的求解邏輯,而這種解題邏輯往往可以和解題模板(解法)相對(duì)應(yīng)。如圖 13 所示,兩個(gè)不同的應(yīng)用題均可以對(duì)應(yīng)相同的解法。

圖 13 語言描述不同但解法相同的應(yīng)用題示例

此外,預(yù)訓(xùn)練語言模型 (PLM) 包含豐富的知識(shí)和擁有高質(zhì)量語義表示的能力,這對(duì)于 MWP 問題的求解會(huì)有幫助。

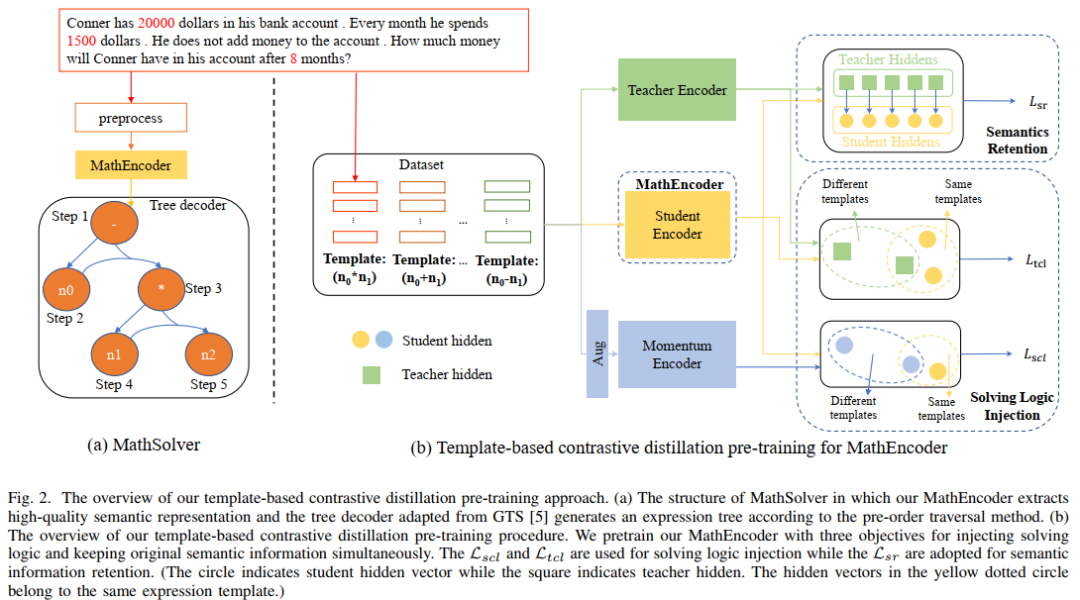

為了充分利用預(yù)訓(xùn)練語言模型所包含的豐富知識(shí)以及利用求解邏輯來更高效地求解應(yīng)用題,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)提出基于解法模板和預(yù)訓(xùn)練語言模型的對(duì)比蒸餾預(yù)訓(xùn)練方法對(duì)求解器中的問題編碼器進(jìn)行領(lǐng)域預(yù)訓(xùn)練,如圖 14 所示。該方法使用多視角對(duì)比學(xué)習(xí)有效地考慮數(shù)學(xué)邏輯知識(shí)的同時(shí)利用知識(shí)蒸餾的方式有效地保留了預(yù)訓(xùn)練語言模型中的知識(shí)和高質(zhì)量語義表示能力。

具體來說, 我們首先以兩道題目之間的解法模板是否一致來作為判定兩道題目是否應(yīng)該在表示空間上互相靠近的標(biāo)識(shí)。然后,我們提出多視角對(duì)比學(xué)習(xí),從教師編碼器以及學(xué)生編碼器及其對(duì)應(yīng)的 Momentum 編碼器進(jìn)行對(duì)比學(xué)習(xí),使得兩道具有相同解法模板的題目表示在教師表示空間中和學(xué)生表示空間中進(jìn)行互相靠近,從而實(shí)現(xiàn)解法邏輯的注入。此外,為了盡可能地保留以預(yù)訓(xùn)練語言模型進(jìn)行初始化的學(xué)生編碼器中所蘊(yùn)涵的知識(shí)和高質(zhì)量表示能力,我們使用知識(shí)蒸餾,利用教師編碼器的特征表示作為監(jiān)督,約束學(xué)生編碼器的表示要與已訓(xùn)練好的教師編碼器具有相同的表示能力,從而實(shí)現(xiàn)語義保持。

圖 14 基于解法模板和預(yù)訓(xùn)練語言模型的對(duì)比蒸餾預(yù)訓(xùn)練方法

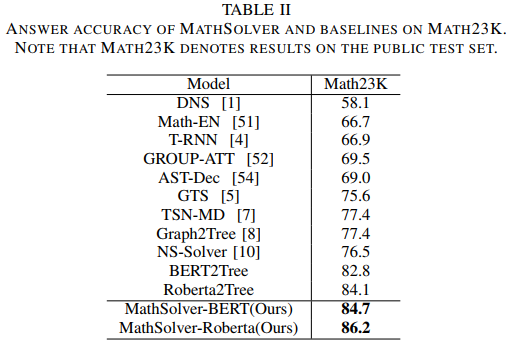

在實(shí)驗(yàn)中,我們使用不同的預(yù)訓(xùn)練語言模型作為初始化并驗(yàn)證我們方法的效果。我們分別使用 BERT-base 和 Roberta-base 權(quán)重對(duì)問題編碼器 MathEncoder 進(jìn)行初始化,并使用 GTS 中的 decoder 作為表達(dá)式解碼器。我們統(tǒng)稱基于 MathEncoder 的求解器為 MathSolver。我們將 MathSolver 與多個(gè)方法在 Math23K 和 CM17K 上進(jìn)行了對(duì)比。實(shí)驗(yàn)結(jié)果如下表所示。

從實(shí)驗(yàn)結(jié)果可以看到,我們所提出的方法能有效地提升求解器的解題能力,并能在多種不同的預(yù)訓(xùn)練語言模型上進(jìn)行應(yīng)用。該成果已投稿到 IEEE Transactions on Neural Networks and Learning Systems,更多細(xì)節(jié)敬請(qǐng)期待。

論文 8:An Introspective Data Augmentation Method for Training Math Word Problem Solvers

Jinghui Qin, Zhongzhan Huang, Ying Zeng, and Liang Lin

近年來,越來越多的研究者開始研究基于深度學(xué)習(xí)的方法進(jìn)行數(shù)學(xué)應(yīng)用題自動(dòng)求解,因?yàn)閿?shù)學(xué)應(yīng)用題自動(dòng)求解能充分展示機(jī)器智能的程度。因?yàn)闃?biāo)注高質(zhì)量大規(guī)模的 MWP 數(shù)據(jù)集的代價(jià)很高,比如需要相應(yīng)教育程度的專業(yè)知識(shí)和大規(guī)模可訪問的題目數(shù)據(jù),所以現(xiàn)有的高質(zhì)量 MWP 數(shù)據(jù)集的規(guī)模對(duì)于訓(xùn)練一個(gè)高效的 MWP 解題器是遠(yuǎn)遠(yuǎn)不夠的。

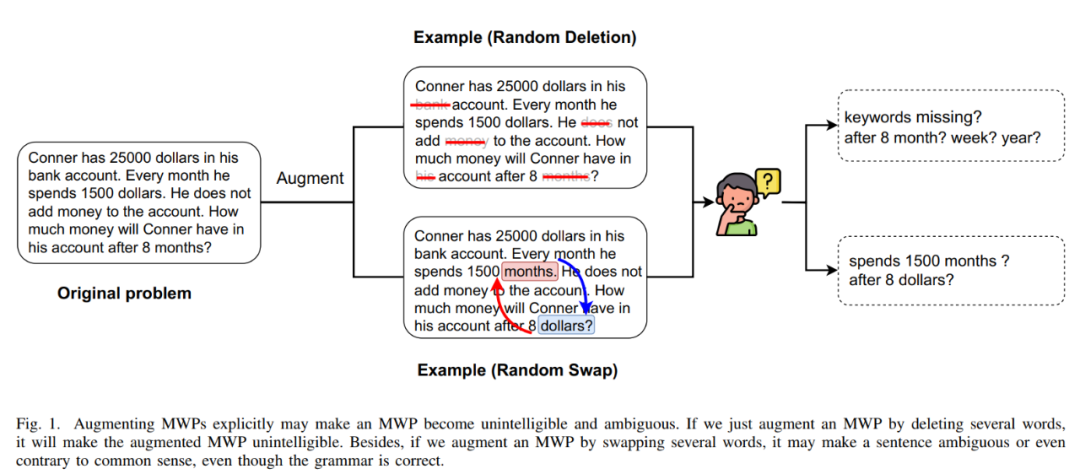

MWP 的數(shù)據(jù)瓶頸問題鼓舞我們思考如何使用成本高效的數(shù)據(jù)增強(qiáng)方法來改進(jìn)數(shù)據(jù)利用效率,提升求解器的性能。最直接的數(shù)據(jù)增強(qiáng)方法就是基于輸入的數(shù)據(jù)增強(qiáng)方法,如常用的字符替換,字符刪除等,但是這類方法對(duì)于 MWP 來說是不適用的,因?yàn)?MWP 具有言簡意賅的特點(diǎn),對(duì)輸入的文本的擾動(dòng)或修改容易使得題意模糊。此外,題意所蘊(yùn)含的數(shù)學(xué)關(guān)系是不能被改變的,但這類方法很可能會(huì)改變題意所蘊(yùn)含的數(shù)學(xué)關(guān)系,如圖 15 所示。

圖 15 基于輸入的數(shù)據(jù)增強(qiáng)方法不適用于 MWP 任務(wù)的示例

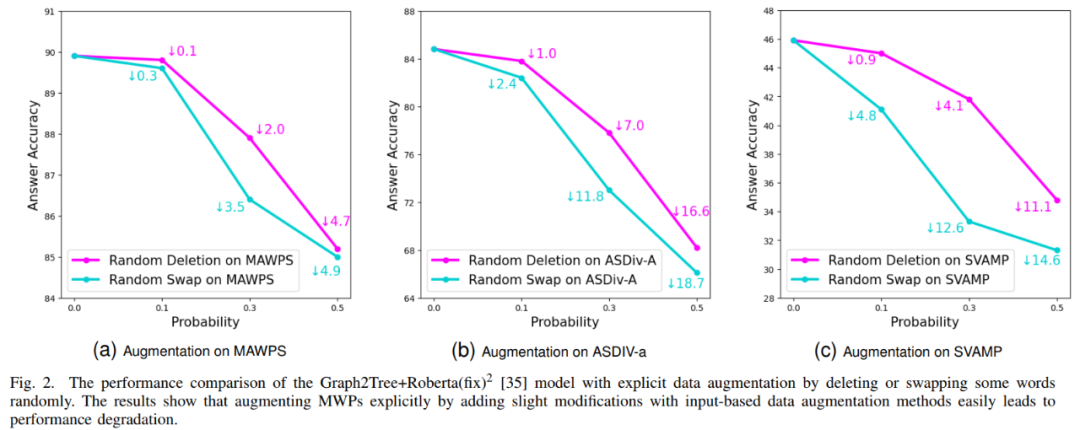

此外,中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室團(tuán)隊(duì)還對(duì)基于輸入的數(shù)據(jù)增強(qiáng)方法進(jìn)行了一定的驗(yàn)證,其實(shí)驗(yàn)結(jié)果如圖 16 所示。實(shí)驗(yàn)結(jié)果表明了基于輸入的顯式數(shù)據(jù)增強(qiáng)方法對(duì)于 MWP 任務(wù)來說是不適用的,無法有效地緩解 MWP 任務(wù)所遇到的數(shù)據(jù)瓶頸問題。

圖 16 基于輸入的數(shù)據(jù)增強(qiáng)方法無法提升 MWP 解題效果

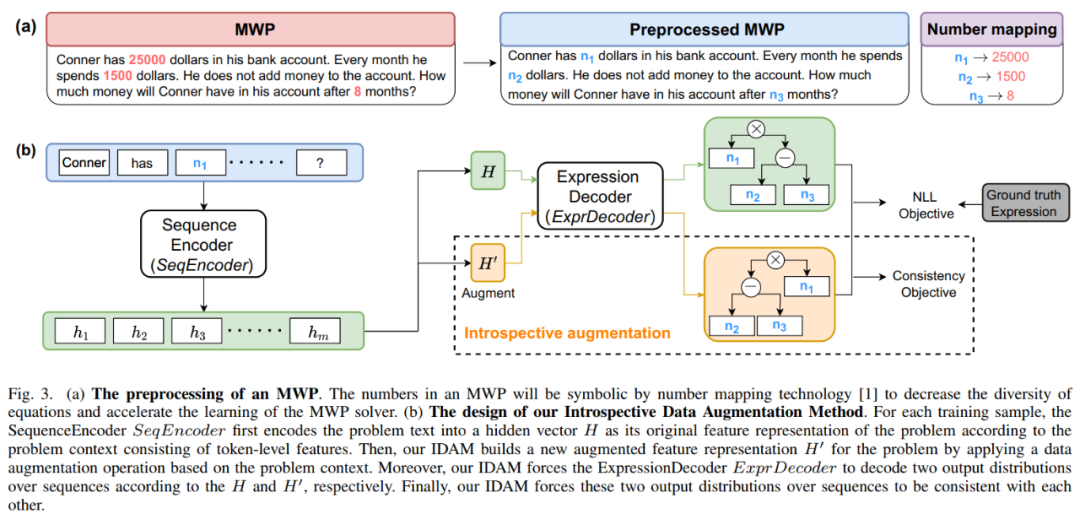

為此,我們提出了一種適用于 MWP 數(shù)據(jù)的簡單高效的數(shù)據(jù)增強(qiáng)方法 - 自省式數(shù)據(jù)增強(qiáng)方法(IDAM),在訓(xùn)練過程種對(duì)題目在隱空間的表示進(jìn)行增強(qiáng),從而解決了基于輸入的數(shù)據(jù)增強(qiáng)方法在 MWP 求解任務(wù)上所遇到的問題。IDAM 方法通過對(duì)問題的表示編碼執(zhí)行不同的表示構(gòu)建方法(均值池化、層次化聚合,隨機(jī)丟棄,隨機(jī)交換等),得到一個(gè)新的問題表示,然后使用一致性目標(biāo)函數(shù)(基于表達(dá)式之間的 JS 散度)來約束求解器基于新問題表示的表達(dá)式解碼輸出要和基于原問題表示的表達(dá)式解碼輸出具有一致性。該方法的示意圖如圖 17 所示。

圖 17 自省式數(shù)據(jù)增強(qiáng)方法(IDAM)示意圖

在實(shí)驗(yàn)中,我們將 IDAM 嵌入到多個(gè) SOTA 方法里并在多個(gè)數(shù)據(jù)集上進(jìn)行了對(duì)比,驗(yàn)證了我們 IDAM 方法的有效性和通用性。實(shí)驗(yàn)結(jié)果如下表所示。從實(shí)驗(yàn)結(jié)果可以看到,在相同的實(shí)驗(yàn)配置下,我們的 IDAM 在不同的 MWP 數(shù)據(jù)集上均能對(duì)不同的求解器基線模型的性能進(jìn)行提升。這充分說明了我們 IDAM 方法在 MWP 問題上的有效性。

該成果已投稿到 IEEE/ACM Transactions on Audio, Speech and Language Processing,更多細(xì)節(jié)敬請(qǐng)期待。

實(shí)驗(yàn)室簡介

中山大學(xué)人機(jī)物智能融合實(shí)驗(yàn)室(HCP Lab)由林倞教授于2010年創(chuàng)辦,圍繞人工智能前沿技術(shù)布局研究課題,獲得中國圖像圖形學(xué)會(huì)科技一等獎(jiǎng)、吳文俊自然科學(xué)獎(jiǎng)、省級(jí)自然科學(xué)一等獎(jiǎng)等榮譽(yù);培養(yǎng)了梁小丹、王可澤等國家級(jí)青年人才。