僅做兩項修改,蘋果就讓StyleGANv2獲得了3D生成能力

如何讓一個已有的 2D GAN 變成 3D 級別?這是一個有趣且實用的問題。

為了解決這個問題,來自蘋果和伊利諾伊大學厄巴納 - 香檳分校的研究者試圖盡可能少地修改經典 GAN,即 StyleGANv2。該研究發現只有兩個修改是絕對必要的:1)一個多平面圖像樣式生成器分支,它產生一組以深度為條件的 alpha 圖;2)一個以位姿為條件的鑒別器。

論文地址:https://arxiv.org/abs/2207.10642

該研究將生成的輸出結果稱為「生成型多平面圖像(GMPI)」。GMPI 方法不僅渲染質量高,還能保證視圖一致。更重要的是,alpha 映射的數量可以動態調整,并且可以在訓練和推理階段有所變化,從而減輕內存問題,在不到半天的時間內以 1024^2 的分辨率快速訓練 GMPI。

首先來看一下 GMPI 方法在三個具有挑戰性的常見高分辨率數據集(FFHQ、AFHQv2 和 MetFaces)上的效果:

方法簡介

該研究通過添加「alpha 分支」來修改經典生成器,并結合簡單高效的 alpha 合成渲染。

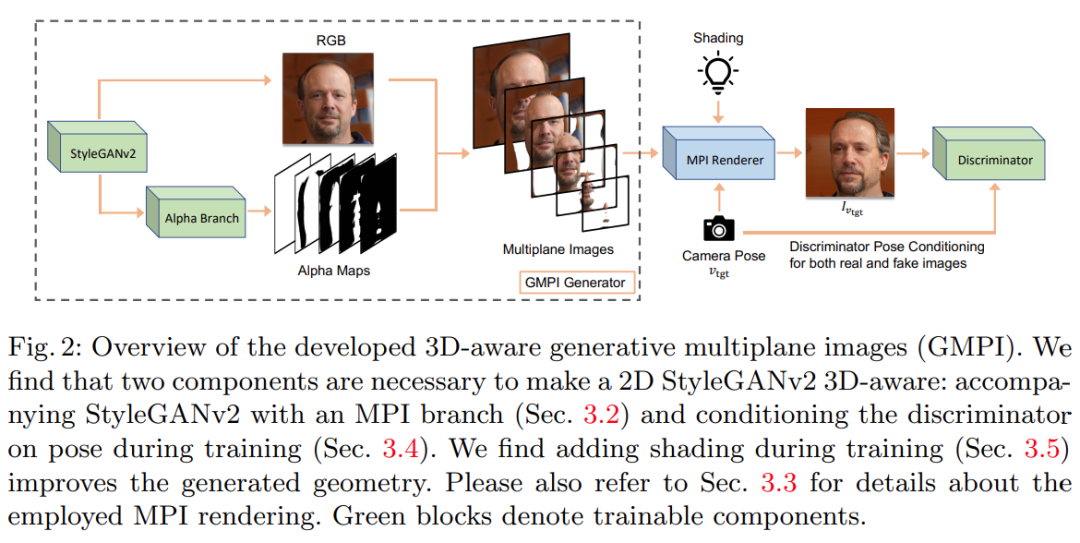

GMPI 生成方法的框架如下圖所示,其中生成器和 alpha 合成渲染器負責生成圖像 I_v_tgt,該圖像以用戶指定的位姿 v_tgt 生成目標對象。保證為不同位姿生成的圖像是視圖一致的。

「alpha 分支」使用中間表征來生成多平面圖像表征 M,其中除了單個圖像之外還包含不同深度的 alpha 映射。

更具體地說,該研究為 StyleGANv2 開發了一個新的生成器分支,它產生一組正面平行的 alpha 映射,在本質上類似于多平面圖像 (MPI)。該研究首次證明 MPI 可以用作無條件 3D 感知生成模型的場景表征。這個新的 alpha 分支是從頭開始訓練的,同時針對常規 StyleGANv2 生成器和鑒別器進行微調。將生成的 alpha 映射與 StyleGANv2 的單個標準圖像輸出相結合,進行端到端的可微多平面樣式渲染,該研究實現了不同視圖的 3D 感知生成,并保證了視圖的一致性。盡管 alpha 映射處理遮擋的能力有限,但渲染非常有效。此外,alpha 映射的數量可以動態調整,甚至可以在訓練和推理期間有所不同,從而減輕內存負擔。

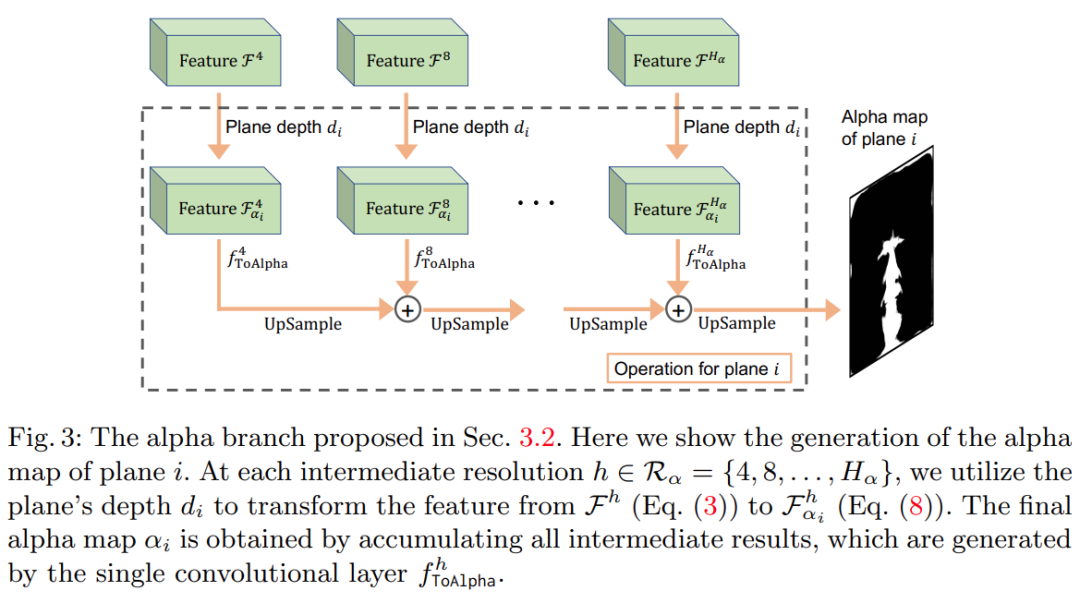

該研究發現:為了實現 3D 感知,根據具體位姿調整鑒別器(discriminator)是絕對必要的。另一方面,根據 alpha 映射的深度來調整模型也是非常必要的。該研究通過添加額外的 alpha 分支對原始 StyleGANv2 網絡進行了簡單的修改,如下圖 3 所示。

為了獲得表現出預期 3D 結構的 alpha 映射,該研究發現需要對 StyleGANv2 進行兩次調整:(a)MPI 中任何平面的 alpha 映射預測必須以平面的深度或可學習的 token 為條件;(b) 鑒別器必須以相機位姿為條件。雖然這兩個調整似乎很直觀,但令人驚訝的是,這兩項調整對于 3D 感知歸納偏置來說已經足夠了。

另一種改進 alpha 映射的歸納偏置是包含陰影的 3D 渲染。盡管有用,但該研究發現這種歸納偏置對于獲得 3D 感知不是必要的。此外,研究者還發現一些經典的 2D GAN 評估指標可能會造成有誤導性的結果。

實驗

該研究在三個數據集(FFHQ、AFHQv2 和 MetFaces)上分析了各種分辨率的 GMPI。

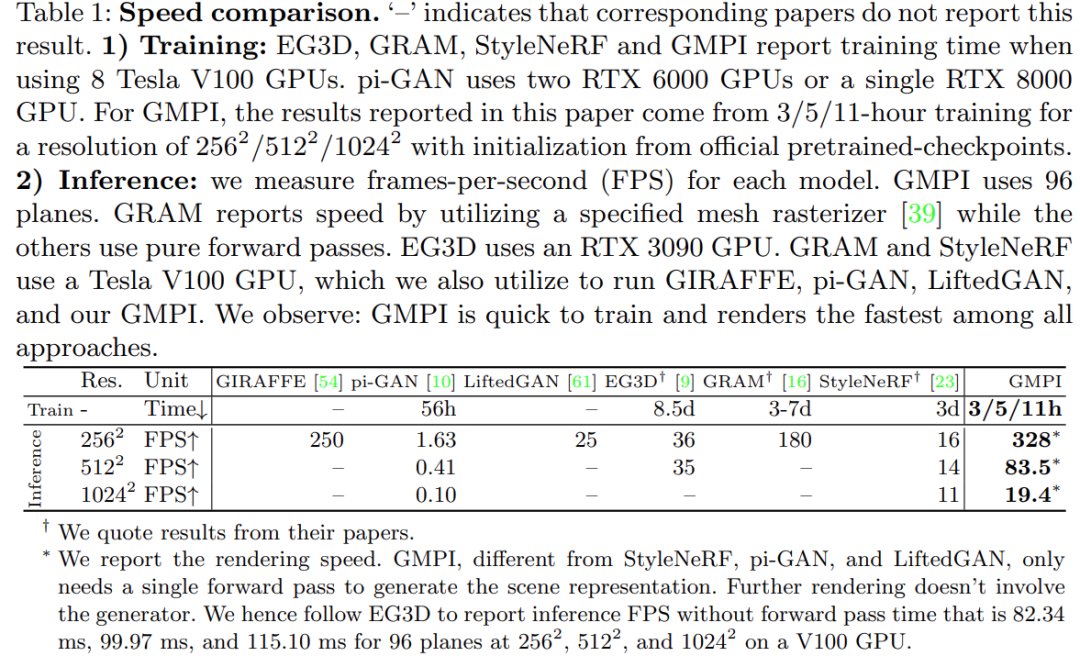

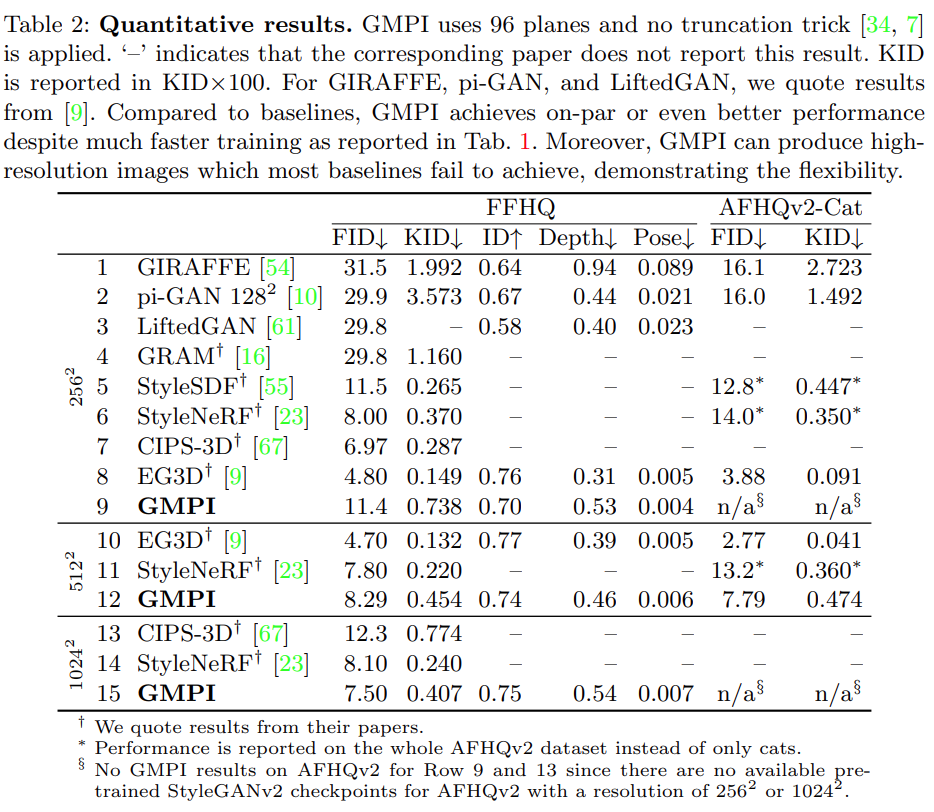

下表 1 和表 2 提供了速度比較和定量評估結果。在更快的訓練下,GMPI 在 256^2 圖像上實現了比 SOTA 模型更好的性能,并且可以生成高達 1024^2 的高分辨率結果,這是大多數基線模型無法生成的。

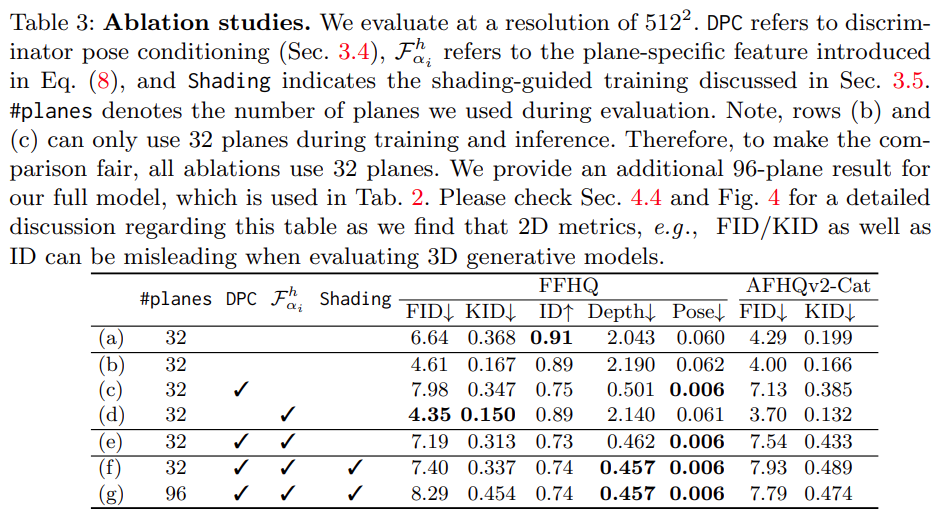

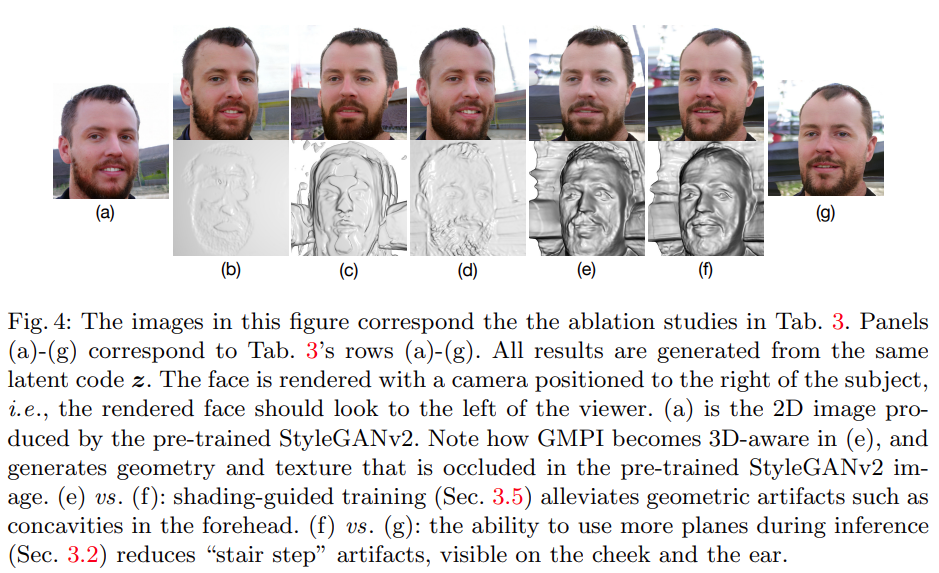

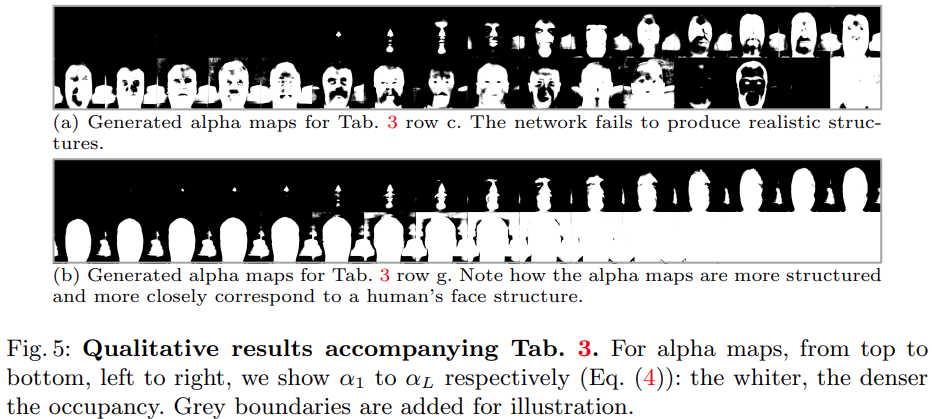

為了分析方法中關鍵設計的效果,該研究進行了消融實驗,結果如下表 3 和圖 4 圖 5 所示。

感興趣的讀者可以閱讀論文原文,了解更多研究細節。