官方論文代碼放出,OpenAI是如何實現圖像版GPT-3的?

OpenAI 放出 DALL-E 的部分論文與實現代碼。

今年年初,OpenAI 圖像版 GPT-3、120 億參數的 DALL-E 刷屏社區,這個大型模型可以將以自然語言形式表達的大量概念轉換為合適的圖像,效果十分驚艷。

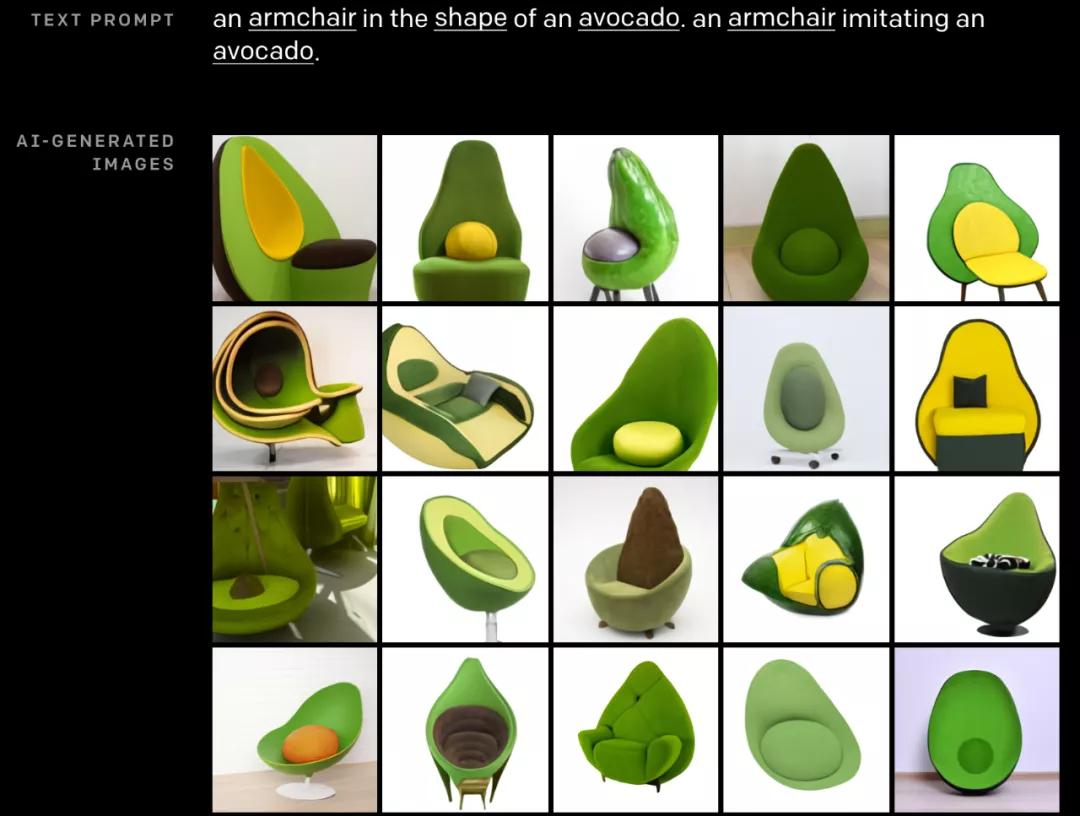

如輸入「牛油果形狀的椅子」,就可以獲得綠油油、形態各異的牛油果椅子圖像。

如果 GPT-3 一樣,大家都在期待 OpenAI 放出 DALL-E 的官方論文與實現代碼。

經過近兩個月的等待,DALL-E 的論文和代碼終于新鮮出爐!

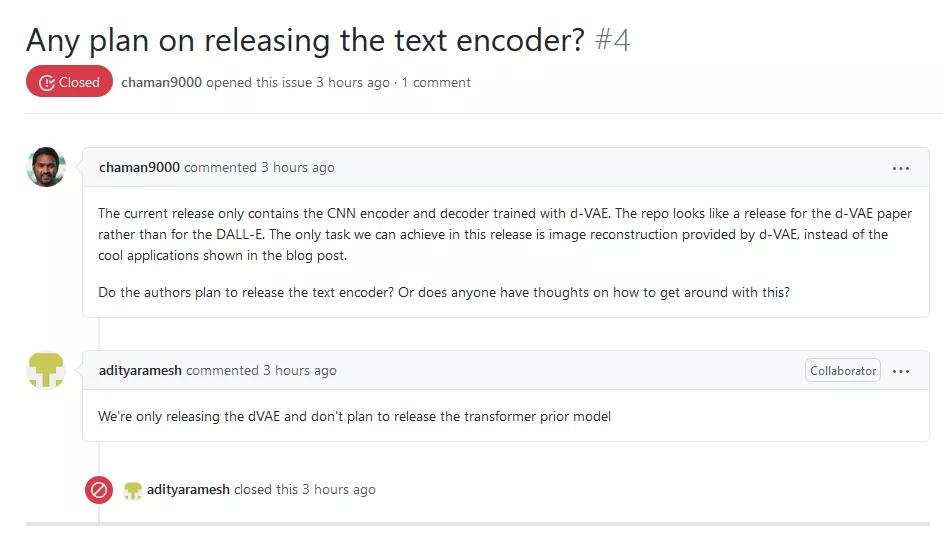

不過此項目正在更新,截止發稿時 DALL-E 只開放了使用圖像重建部分 d-VAE 訓練的 CNN 編碼器和解碼器部分,而 Transformer 代碼部分還沒有公開。除此以外數據集也不能使用。而論文也是公布了 d-VAE 的論文。

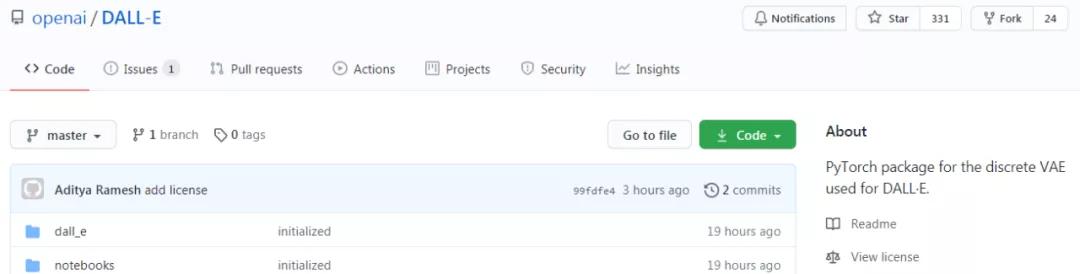

- 項目地址:https://github.com/openai/DALL-E

- 論文地址:https://arxiv.org/abs/2102.12092

只能期待后續 OpenAI 公開更多的技術細節。

DALL-E 部分代碼已開源

這是為 DALL·E 所使用的 d-VAE 的官方 PyTorch 包。在運行 DALL-E/notebooks/usage.ipynb 程序之前,需要先安裝軟件包,代碼如下:

pip install git+https://github.com/openai/DALL-E.git

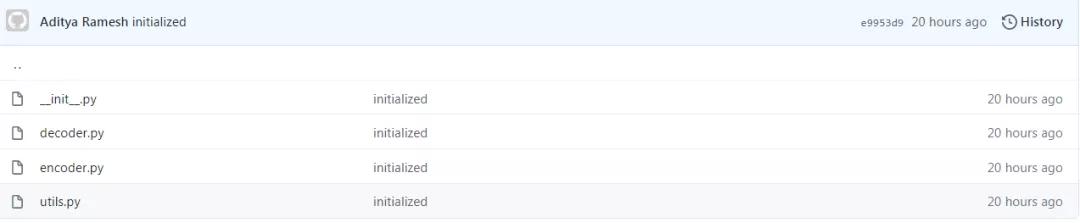

解碼器、編碼器代碼

d-VAE 論文

年初在論文還沒有公開的情況下,就有人開始復現,他們復現的依據來自某博主制作的油管視頻,在視頻中,對 DALL·E 的原理結構進行了猜測。那么,現在論文已公開,是否顛覆了他的預想。

傳統上,文本到圖像的生成主要集中在在固定的訓練數據集上找到更好的建模假設。這些假設可能涉及復雜的體系架構、輔助損失或輔助信息,例如在訓練期間提供的對象部件標簽或分割掩碼。該研究提出了一種基于 transformer 的簡單方法,將文本和圖像 token 作為單個數據流進行自回歸建模。在足夠的數據和擴展的情況下,當以 zero-shot 方式評估時, 該研究提出的方法與以前的領域特定模型具有相當的競爭力。