天才還是白癡:有史以來最具爭議的神經網絡_IT技術周刊第656期

極限學習機

有人認為,極限學習機是有史以來最聰明的神經網絡發明之一,以至于甚至召開了專門討論ELM神經網絡體系結構的會議。ELM的支持者認為,它可以以指數級的更快的訓練時間執行標準任務,而很少有訓練實例。另一方面,除了它在機器學習社區中并不大的事實之外,它還受到深度學習專家的廣泛批評,其中包括Yann LeCun,他們認為它的宣傳和信譽遠遠超出其應有的程度。

通常,人們似乎認為這是一個有趣的概念。

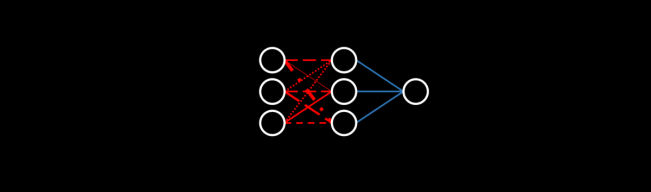

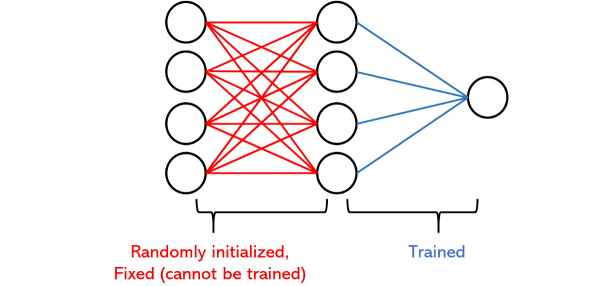

ELM體系結構由兩層組成:第一個是隨機初始化和固定的,而第二個是可訓練的。本質上,網絡將數據隨機投影到新空間中并執行多元回歸(當然,然后將其傳遞給輸出激活函數)。隨機投影需要一種降維(或放大)方法,該方法將隨機矩陣乘以輸入-盡管這個想法聽起來很奇怪,但從戰略分布中隨機抽取實際上可以很好地工作(我們將在以后的直觀類比中看到)。它會施加某種隨機失真,這種失真會以良好的方式(如果正確完成的話)會產生噪聲,并使網絡的其余部分能夠適應,從而為學習機會打開了新的大門。

實際上,正是由于這種隨機性,Extreme Learning Machines才被證明具有隱藏層中具有相對較小節點的通用近似定理冪。

實際上,在1980年代和1990年代,以神經網絡發展領域的名字就已經探索了隨機投影的想法,這就是對ELM并不是什么新鮮事物的一種批評。只是舊研究以新名稱打包。許多其他體系結構(例如回聲狀態機和液體狀態機)也利用隨機跳過連接和其他隨機性來源。

但是,ELM與其他神經網絡架構之間的最大區別可能是它不使用反向傳播。取而代之的是,由于網絡的可訓練部分只是簡單的多元回歸,因此以大致相同的方式在回歸中擬合系數來訓練參數。這代表了人們認為神經網絡訓練方式的根本轉變。

自從基本人工神經網絡出現以來,幾乎所有開發出的神經網絡都通過在整個網絡中前后反射信息信號,使用迭代更新(或根據需要將其稱為"調整")進行了優化。由于這種方法已經存在了很長時間,因此必須假定已經嘗試并測試了該方法為最佳方法,但是研究人員承認,標準反向傳播存在許多問題,例如訓練起來很慢或陷入極小的局部極小值現象。

另一方面,ELM使用數學上涉及更多的公式來設置權重,而無需太深入地研究數學,可以想到使用隨機層來補償更多計算上昂貴的細節,否則它將被替換。從技術上講,如果有幫助,那么非常成功的Dropout層就是一種隨機投影。

因為ELM同時使用隨機性和無反向傳播算法,所以它們的訓練速度比標準神經網絡快得多。

另一方面,他們是否表現更好是另一個問題。

有人可能會提出這樣一種觀點,即ELM比標準神經網絡(盡管兩者都相距甚遠)更能反映人類的學習方式,因為它僅需幾個示例就可以非常快速地解決更簡單的任務,但是迭代神經網絡需要貫穿其中至少,成千上萬的樣本可以泛化并表現良好。與機器相比,人類可能有其弱點,但是他們在示例學習比率(示例是他們所接受的培訓示例的數量)方面的巨大優勢才使我們真正變得聰明。

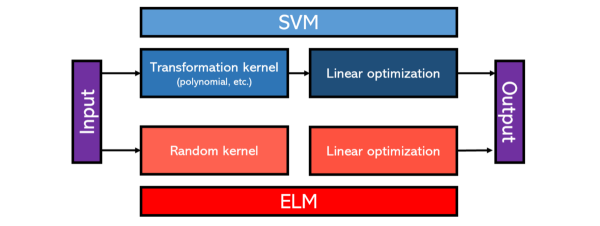

極限學習機的概念非常簡單-如此簡單,以至于有人會稱其為愚蠢的。偉大的計算機科學家和深度學習先驅Yann LeCun宣稱,"隨機連接第一層幾乎是您可以做的最愚蠢的事情",在此論點之后,他列舉了更多的開發方法來非線性地變換向量的維數,例如作為SVM中使用的內核方法,通過使用反向傳播進行定位進一步得到了加強。

LeCun說,從本質上講,ELM本質上是一個SVM,具有更差的轉換內核。使用SVM可以更好地建模ELM能夠解決的有限范圍的問題。唯一的反駁是使用"隨機內核"而不是專用內核的計算效率,因為SVM是眾所周知的高功率模型。ELM可能帶來的性能降低是否值得,這是另一個討論。

> One way to compare ELMs and SVMs.

然而,無論是否像ELM一樣,根據經驗,在簡單的神經網絡中使用隨機投影或過濾器以及其他模型都已證明在MNIST等各種(現在被認為是"簡單")標準訓練任務中表現出色。盡管這些性能不是一流的,但經過如此嚴格審查并且其概念幾乎被認為是荒唐可笑的體系結構,可以通過最新的神經網絡在排行榜上獨占edge頭–此外,它具有更輕量級的體系結構和較小的計算量–至少是令人感興趣的。

為什么使用固定的隨機連接有效?

這是一百萬美元的問題:很明顯,如果ELM的性能與普通的反向傳播神經網絡一樣好(甚至更好),那么ELM中具有隨機連接的某些功能就可以正常工作。雖然它的數學是不直觀的,但原始的《極限學習機器》論文的作者光斌煌,舉例說明了這個概念(針對語言,簡潔性和深度學習的相似性進行了編輯):

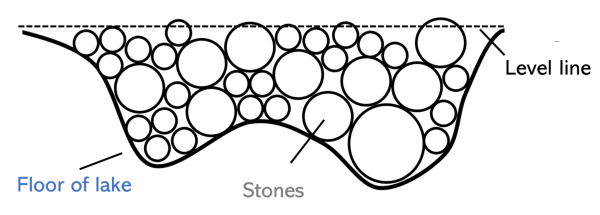

您要用石頭填滿一個湖,直到用石頭而不是水填滿一個水平表面,然后您才能看到空湖的底部,這是一條曲線(代表數據的函數)。工程師仔細計算了湖泊的大小,填滿湖泊的石頭的大小,以及在優化任務中起作用的眾多其他小因素。(優化適合該功能的許多參數。)

> A bad but acceptable job of filling stones into the lake.

另一方面,農村農民炸毀附近的山,開始扔掉或推下掉進湖里的巖石。當農村農民撿起一塊石頭(隱藏層節點)時,他不需要知道湖的大小或石頭的大小,他只是隨意地扔石頭并將石頭散布開來。如果某個區域的巖石開始堆積在地表上方,則農夫會用錘子將其砸碎(β參數-各種規則化處理),以平整地表。

盡管工程師仍在計算巖石的高度和體積以及湖泊的形狀,但農夫已經填滿了湖泊。對于農夫來說,扔多少塊石頭都沒關系:他可以更快地完成工作。

盡管這種類比在不同場景的直接應用中存在一些問題,但這是對ELM的本質以及隨機性在模型中扮演的角色的直觀解釋。ELM的本質在于,天真并不總是一件壞事:簡單的解決方案可能能夠更好地解決不太復雜的問題。

關鍵點

- 極限學習機使用固定的隨機第一層和可訓練的第二層。這本質上是隨機投影,然后是多元回歸。

- ·支持者說,ELM能夠在簡單的場景(如MNIST)中以非常少的示例很快地學習,其優點是易于編程,并且無需選擇諸如體系結構,優化器和損耗之類的參數。另一方面,反對者認為,SVM在這些情況下會更好,ELM不適合解決更復雜的問題,并且它只是對一個非常古老的想法進行了重新命名。

- ELM通常在復雜任務上表現不佳,但事實證明它可以在較簡單的任務上表現良好,這是探索更多輕量級體系結構,非反向傳播模型擬合和隨機投影世界的一個很好的理由。至少,極限學習機(或您想在其下打上這個名字的任何名稱)是每個深度學習愛好者都應該知道的有趣的想法。

您對ELM有何看法?