開源!Gartner力推的百頁機器學習書,可以免費下載了!

如今的大型企業都在經歷著自工業化以來***的變革。人工智能顛覆了工業,顛覆了我們的工作、思考和互動的方式,Gartner的一項報告預測,到2020年,人工智能將創造230萬個就業崗位,以此同時也會減少180萬個人力崗位。機器學習是驅動人工智能發展的主要動力,這個領域的專家數量不多,各大企業都在爭搶高技能人才。

說到這里,你可能已經猜到猿哥今天要和大家分享的是一本有關人工智能的書,這本書只有152頁,非常簡短。名叫——《The Hundred-Page Machine Learning Book》

但麻雀雖小五臟俱全,這本書涵蓋了監督和非監督式學習,支持向量機,神經網絡,集成方法,梯度下降法,聚類分析和數據降維,自編碼和遷移學習,特征工程和超參數優化,數學知識、插圖等內容都包含在這本152頁的書籍里

具體的章節目錄如下:

- 前言

- 第 1 章:介紹

- ***部分:監督式學習

- 第二章:標記和定義

- 第三章:基礎算法

- 第四章:學習算法的解剖

- 第五章:基礎實戰

- 第六章:神經網絡與深度學習

- 第七章:問題與解決

- 第八章:進階實戰

- 第二部分:非監督式學習和其它學習

- 第九章:非監督式學習

- 第十章:其它形式學習

- 第十一章:結論

作者本著先閱讀后購買的原則,因此你可以先在在線免費閱讀/下載書籍,直到你認為它值得你購買的時候再購買。

這本書在線閱讀還有一個好處就是,在頁面的右側有網友評論,你可以通過網友評論發現本書錯誤或者不足的地方,從而避免被誤導,還能查看作者***的更新時間等

除此之外,作者還在GitHub上開源了本書配套的所有代碼

GitHub地址:https://github.com/aburkov/theMLbook

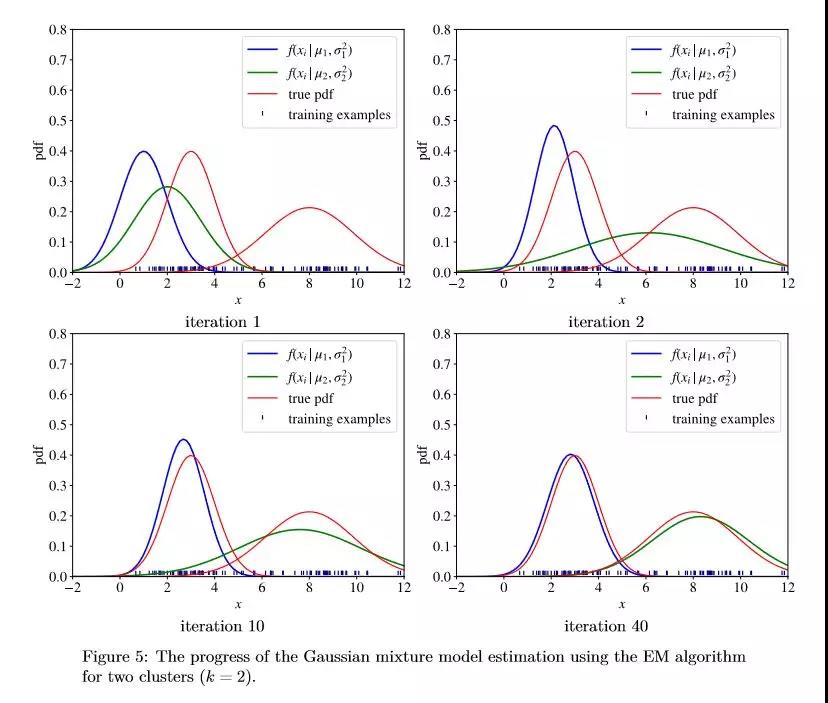

比如多元高斯分布(GaussianMixture Model GMM)這個內容,作者在書的9.2.4進行了詳細的講解:

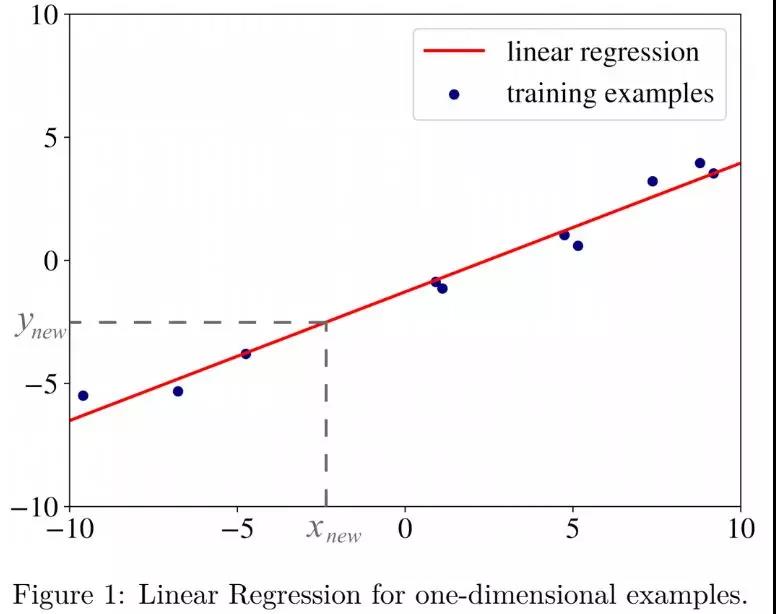

再如第三章中的關于線性回歸算法的介紹:線性回歸算法是一種流行的回歸學習算法,學習的模型是利用數理統計中的回歸分析

其對應的Python代碼如下:

- import numpy as np

- import matplotlib.pyplot as plt

- from sklearn.linear_model import Ridge

- from sklearn.preprocessing import PolynomialFeatures

- from sklearn.pipeline import make_pipeline

- import matplotlib

- matplotlib.rcParams['mathtext.fontset'] = 'stix'

- matplotlib.rcParams['font.family'] = 'STIXGeneral'

- matplotlib.rcParams.update({'font.size': 18})

- def f(x):

- """ function to approximate by polynomial interpolation"""

- return 0.5 * x

- # generate points used to plot

- x_plot = np.linspace(-10, 10, 100)

- # generate points and keep a subset of them

- x = np.linspace(-10, 10, 100)

- rng = np.random.RandomState(0)

- rng.shuffle(x)

- x = np.sort(x[:10])

- noize = [(-2 + np.random.random()*2) for i in range(len(x))]

- y = f(x) + noize

- # create matrix versions of these arrays

- X = x[:, np.newaxis]

- X_plot = x_plot[:, np.newaxis]

- colors = ['red', 'red']#, 'orange'

- lw = 2

- type_of_regression = ["linear regression", "regression of degree 10"]

- fit = ["fit", "overfit"]

- for count, degree in enumerate([1,10]):#, 2, 15

- plt.figure(count)

- axes = plt.gca()

- axes.set_xlim([-10,10])

- axes.set_ylim([-10,10])

- plt.scatter(x, y, color='navy', s=30, marker='o', label="training examples")

- plt.xticks([-10.0, -5.0, 0.0, 5.0, 10.0])

- plt.yticks([-10.0, -5.0, 0.0, 5.0, 10.0])

- model = make_pipeline(PolynomialFeatures(degree), Ridge())

- model.fit(X, y)

- y_plot = model.predict(X_plot)

- plt.plot(x_plot, y_plot, color=colors[count], linewidth=lw,

- label=type_of_regression[count])

- plt.legend(loc='best')

- fig1 = plt.gcf()

- fig1.subplots_adjust(top = 0.98, bottom = 0.1, right = 0.98, left = 0.08, hspace = 0, wspace = 0)

- fig1.savefig('../../Illustrations/linear-regression-' + fit[count] + '.eps', format='eps', dpi=1000, bbox_inches = 'tight', pad_inches = 0)

- fig1.savefig('../../Illustrations/linear-regression-' + fit[count] + '.pdf', format='pdf', dpi=1000, bbox_inches = 'tight', pad_inches = 0)

- fig1.savefig('../../Illustrations/linear-regression-' + fit[count] + '.png', dpi=1000, bbox_inches = 'tight', pad_inches = 0)

- plt.show()

也就是說這本書里的插圖都附有源代碼,這些源代碼你都可以在GitHub上找到。

關于作者

Andriy Burkov,是一名機器學習專家,早在九年前就已經取得了博士學位,他的專長是自然語言處理,在人工智能方面,過去的7年里,Andriy Burkov一直在Gartner帶領一個機器學習開發團隊。

***,附上本書的下載地址:http://themlbook.com/wiki/doku.php