艾倫圖靈研究所最新成果:多智能體博弈中的可糾正性和一致性 精華

多智能體系統研發正在快速發展,過去一年我們曾分析 41 篇研究多智能體的論文,說明自主代理系統的研究正逐漸成為一個炙手可熱的話題。為了使這些系統能夠與人類用戶和其他系統有效互動,確保其行為的可糾正性(corrigibility)和一致性(alignment)是至關重要的。1 月 11 日,arXiv 發表的艾倫圖靈研究所的最新成果《On Corrigibility and Alignment in Multi Agent Games》, 這篇論文聚焦于多代理環境中的自主代理的可糾正性問題,并提出了一種基于博弈論的框架,以分析在多代理設置中引入不確定性如何影響代理的可糾正性。

隨著人工智能技術的廣泛應用,特別是在自動駕駛、智能家居和醫療保健等領域,確保AI系統能夠在需要時接受人類的監督和糾正,變得越來越重要。這不僅能夠提高系統的安全性,還能夠增加其在復雜和動態環境中的魯棒性。該研究通過將自主代理的行為建模為多玩家博弈,探討了如何在這些系統中引入不確定性,從而使代理在面臨不確定人類偏好的情況下保持可糾正性。

在論文中,研究團隊詳細介紹了如何將可糾正性建模為兩玩家博弈,并分析了多代理環境中不同場景下的可糾正性表現。他們提出了一個通用框架,其中自主代理可以在不確定的環境中請求人類的監督,并進一步分析了代理在面對人類偏好和行為不確定性時的策略選擇。這一研究不僅為理論研究提供了新的視角,還為實際應用提供了指導方針,特別是在需要多人協作和對抗性系統設計的領域,如網絡安全和多機器人協作。

這篇論文的研究由艾倫圖靈研究所的三位科學家共同完成,他們分別是Edmund Dable-Heath、Boyko Vodenicharski和James Bishop。

艾倫圖靈研究所 是英國的國家數據科學和人工智能研究院,致力于推動數據科學和人工智能領域的前沿研究和應用。該研究所匯聚了來自世界各地的頂尖科學家和研究人員,他們在數據科學、機器學習、人工智能等領域進行開創性研究。

Edmund Dable-Heath是應用研究中心的數據科學家,專注于國防和安全領域的最新數據科學和深度學習研究。他在帝國理工學院完成了博士學位,研究內容涉及量子計算攻擊模型下評估量子安全協議。

Boyko Vodenicharski也是應用研究中心的數據科學家,研究領域包括神經網絡、圖論、無監督學習和深度學習。他在海德堡大學獲得了碩士學位,研究方向為開發用于視頻顯微鏡中細胞分割和跟蹤的新算法。

雖然關于 James Bishop 的詳細背景信息較少,但可以肯定的是,他也是艾倫圖靈研究所的重要成員,與團隊一道在這一前沿領域進行深入研究。

通過這項研究,團隊不僅探討了在多代理環境中保持代理可糾正性的方法,還提供了在不確定環境中設計安全且有效的AI系統的寶貴見解。這些發現不僅具有理論意義,也在實踐中為多代理系統的設計和實施提供了有力支持。

可糾正性與一致性概述

在探討多智能體博弈中的可糾正性和一致性之前,有必要明確什么是自主代理的可糾正性和一致性。可糾正性是指自主代理在運行過程中能夠接受人類監督和干預的能力。這意味著當自主代理的行為可能導致不良后果時,人類能夠對其進行糾正,確保其行為符合預期。這一特性對于保證AI系統在復雜動態環境中的安全性和可靠性至關重要。

一致性則是指自主代理的行為能夠與人類的目標和偏好保持一致。為了使AI系統在多代理環境中有效工作,確保每個代理的行為都能與整體系統的目標保持一致至關重要。這不僅能夠提高系統的效率,還能避免由于各代理之間的沖突而導致的不良后果。

本研究的目的是在多代理系統中引入不確定性,以增強自主代理的可糾正性和一致性。具體來說,研究團隊提出了一種博弈論框架,通過將多代理系統建模為兩玩家博弈,分析了不確定性在這些系統中的作用。通過這種方法,研究團隊希望能夠找到一種方法,使自主代理即使在面對人類偏好和行為不確定的情況下,依然能夠保持可糾正性和一致性。

該研究的主要問題包括:

- 如何在多代理環境中建模自主代理的可糾正性?研究團隊提出了一種通用框架,將可糾正性建模為兩玩家博弈,使代理能夠在不確定的環境中請求人類監督。

- 在多代理博弈中引入不確定性對可糾正性有何影響?通過分析不同游戲場景下代理的策略選擇,研究團隊探討了不確定性對代理可糾正性的影響。

- 如何在實際應用中設計具有可糾正性和一致性的多代理系統?研究結果為多代理系統的設計提供了指導方針,特別是在需要多人協作和對抗性系統設計的領域,如網絡安全和多機器人協作。

通過上述研究,團隊希望能夠為自主代理系統的設計和實現提供新的思路和方法,確保這些系統在實際應用中的安全性和可靠性。

研究框架

在這篇論文中,研究團隊提出了一種基于博弈論的框架,以分析多智能體系統中的可糾正性問題。他們通過將多智能體系統建模為兩個玩家的博弈,探討在多代理環境中引入不確定性如何影響代理的可糾正性。

多智能體系統的博弈結構以兩名自主代理和一名人類作為玩家。每個代理都有一組可供選擇的動作,其中一個動作允許人類進行監督。通過這種結構,研究團隊能夠模擬現實世界中自主代理在不確定人類偏好的情況下如何進行決策。游戲的結構設計為貝葉斯博弈,以引入對人類行為和偏好的不確定性,并分析代理在不同情景下的策略選擇和收益。

防御者/對手模型

在防御者/對手模型中,研究團隊設想了一種對抗性的情景,其中一個自主代理作為防御者,另一個作為對手。防御者的目標是保護某一系統不受對手的攻擊,而對手則試圖破壞這一系統。防御者可以選擇請求人類監督,以便在人類的指導下采取最佳行動。

在這一模型中,防御者對游戲的信念和對手的策略具有不確定性。研究團隊通過構建防御者的信念分布,分析在不同情況下防御者的可糾正性策略。結果表明,當防御者對人類理性的信念較高時,其更傾向于請求人類監督,從而提高系統的安全性和魯棒性。然而,當防御者對人類理性的信念較低時,其更可能獨立采取行動,以避免因不確定的人類指導而導致的潛在風險。

多代理協作模型

在多代理協作模型中,研究團隊分析了兩個自主代理在共同完成某一任務時的行為。這一模型假設兩名代理的目標是一致的,即共同最大化人類的獎勵函數。在這一框架下,代理可以選擇請求人類監督,以確保其行為符合人類的期望。

研究團隊通過構建兩名代理的信念分布和偏好關系,分析在不同不確定性情況下代理的策略選擇。結果表明,當兩名代理都相信人類的理性較高時,他們更傾向于請求人類監督,從而確保其行為的一致性和可糾正性。然而,當兩名代理之間存在策略依賴關系時(例如在諧波游戲中),隨著人類理性的提高,代理反而不愿意請求監督。這一現象突顯了多智能體系統設計中需要考慮的復雜行為動態。

通過這兩個主要案例研究,研究團隊展示了在不同情景下分析多智能體系統中代理可糾正性和一致性的方法,為多代理系統的設計和實際應用提供了理論依據和實踐指導。通過這種博弈論框架,研究團隊不僅能夠預測代理在不同不確定性下的行為,還能夠為系統設計者提供優化策略,從而提升多智能體系統的安全性和有效性。

多智能體可糾正性游戲

研究團隊提出了一種博弈論框架,用于分析自主代理與人類互動中的可糾正性問題。通過設置不同的游戲情景和假設條件,團隊探索了在多代理環境下,自主代理如何通過請求人類監督來實現可糾正性。

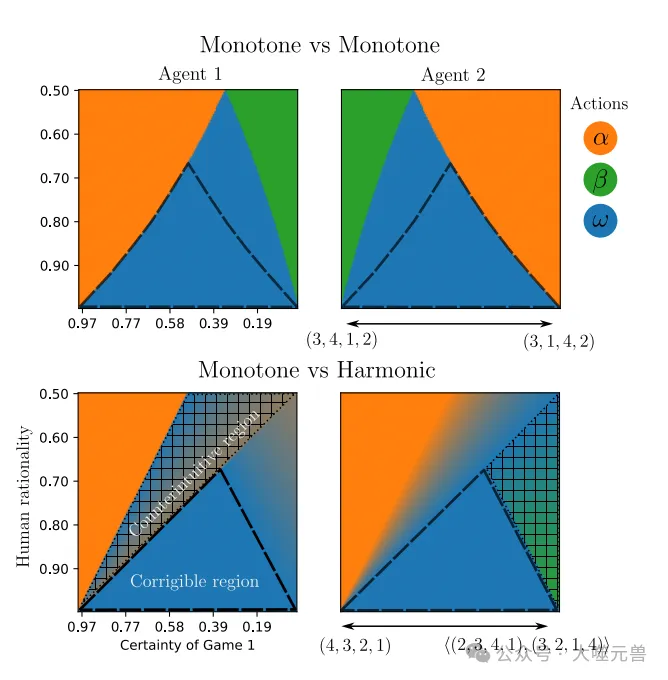

圖1:顯示編碼為顏色的每個試劑的納什均衡位置的相圖。第一行顯示了在單調博弈對(3,4,1,2)和(3,1,4,2)之間不確定的代理。在最后一行中,代理在單調和諧博弈之間是不確定的,這兩個博弈都在右x軸上。x和y軸分別顯示了代理對所玩游戲是游戲1的信念(游戲定義見右欄的x軸),以及人類做出理性決策的概率。

在兩行中,代理都有一個共同的信念p,即人類會做出理性的決定。強調了可糾正性區域和違反直覺的代理行為區域。后者我們稱之為“反直覺”,因為隨著人類理性的降低,行為主體越來越傾向于在人類監督下行事。

問題設置:自主代理與人類的互動

研究首先提出一個由兩個自主代理和一個人類組成的多智能體系統。每個代理都可以選擇執行一組動作,其中包含一個特殊動作,允許人類介入并指導代理的決策。通過這種設計,研究團隊模擬了現實世界中自主代理在不確定的人類偏好下進行決策的過程。

在這個框架下,兩個自主代理的目標是最大化人類的獎勵函數。人類的行動集取決于代理采取的行動,并且假設人類根據自身的偏好采取固定策略。這一假設使得代理的行為能夠被模型化和分析,從而得出關于可糾正性的結論。

游戲中的假設條件與偏好關系

在多智能體可糾正性游戲中,研究團隊定義了不同的偏好關系,表示人類和代理對不同行動組合的偏好。具體來說,假設代理的偏好關系為?1和?2,而人類的偏好關系為?H。

例如,當?H=?1且?H≠?2時,人類與代理1的目標一致,而與代理2的目標不一致。相反,當?H=?1=?2時,所有玩家的目標完全一致。通過這些假設,研究團隊能夠分析在不同的偏好關系下,代理的策略選擇和收益情況。

兩個玩家的可糾正性博弈

在研究中,兩個自主代理的可糾正性博弈被建模為一個2x2的基礎游戲矩陣,其中包含人類作為顯性第三玩家。通過這一模型,研究團隊探討了在多代理環境下,不確定性對可糾正性的影響。

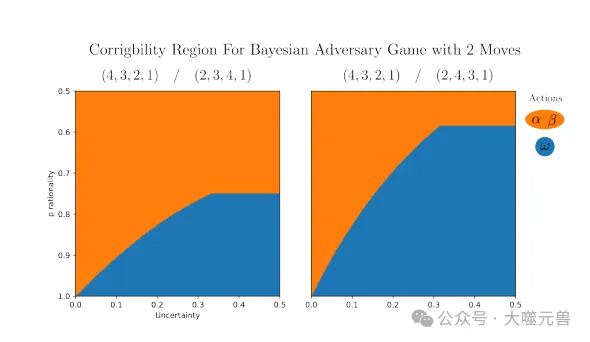

圖2:對人類理性的信念的相圖,以及正在玩的一對游戲中的哪一個,顏色表示當代理人被激勵要求人類獨立行動時,藍色表示可糾正區域。代理人不確定的游戲在每個子圖的標題中都有說明。

定義與類型

在這個模型中,游戲的定義和類型包括玩家的行動集合、類型和收益函數。自主玩家有對所玩游戲的信念πGi,并對人類理性程度有估計。人類玩家知道每個實例中玩的游戲,并根據自身偏好理性行為。代理的動作集合為{α, β, ω},而人類的動作集合為{α′, β′}。

動作與收益分析

每個代理都有三種可能的動作:{α, β, ω}。動作ω表示代理是可糾正的,因為它允許人類指導代理的行動。代理的收益函數取決于基礎游戲G和代理對游戲和人類理性的估計。例如,當代理相信人類會理性地選擇對自己有利的行動時,代理會更傾向于請求人類監督。

納什均衡的求解

通過構建不同的收益矩陣和信念分布,研究團隊分析了代理在不同情況下的納什均衡。對于完全理性且對齊的人類,防御者有動機采取詢問人類的行動;而對于完全不理性的人類,防御者不會被激勵請求監督。研究還發現,當代理對游戲的不確定性增加時,他們更可能請求人類意見,從而提高系統的可糾正性。

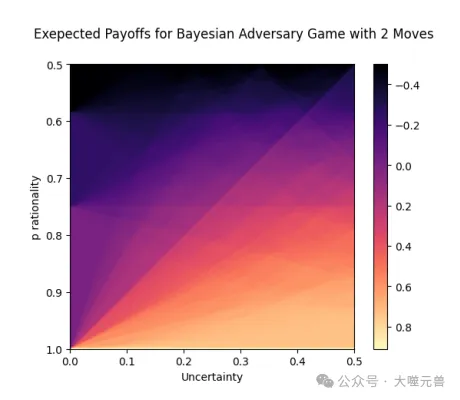

圖3:為具有兩個動作的游戲中防御代理的不同不確定性和人類理性信念繪制的預期收益相圖。這里的不確定性涵蓋了所有可能的雙人游戲對(按比例)。可糾正性等級由顏色條給出,正值表示更大的可糾正性。應注意不確定性與人類理性之間的線性關系。

這一分析表明,通過引入不確定性和構建合理的偏好關系,可以在多代理系統中實現自主代理的可糾正性。這一研究為多代理系統的設計提供了理論基礎,并為實際應用中的安全性和魯棒性提供了指導。

對抗性系統設計

對抗性系統設計是一個關鍵研究領域。隨著自主代理在網絡安全等領域的應用日益廣泛,防御者與對手的互動成為一個重要的研究主題。

對抗性情景的背景

對抗性情景廣泛應用于網絡安全領域,在這種情景中,一個自主代理(防御者)旨在保護系統免受另一個代理(對手)的攻擊。自主代理系統在網絡中往往具有關鍵的基礎設施訪問權,這意味著如果不加以控制,可能會對系統造成重大損害。因此,確保防御者能夠在需要時接受人類的監督和指導,變得尤為重要。

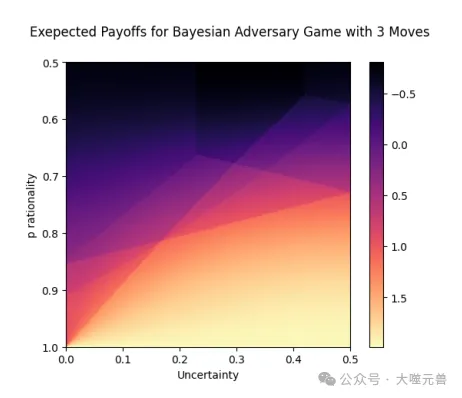

圖4:對于具有三個動作的游戲,為防御代理的不同不確定性和人類理性信念繪制的預期收益相圖。這里對一對游戲進行了平均。可糾正性量表由顏色條給出,正值表示更大的可糾正性,與代理人認為人類的非理性程度和不確定性程度相比,可糾正性存在顯著的亞線性關系。

建模防御者與對手的互動

在建模防御者與對手的互動時,研究團隊將其設計為一個2x2的博弈游戲。防御者的策略包括選擇自主行動或請求人類監督,而對手則試圖通過各種策略來攻破防御。這一模型考慮了不同程度的人類理性,即人類在面對對手的行動時,會根據其理性程度采取相應的策略。

通過構建防御者對游戲的信念分布和對手策略的不確定性,研究團隊分析了不同情況下防御者的可糾正性策略。他們提出了一系列不等式,用于描述防御者在不同信念和策略下請求人類監督的動機。這些不等式表明,當人類被認為是高度理性的,防御者更傾向于請求人類監督;反之,當人類被認為是不理性的,防御者則更傾向于自主行動。

分析防御者的可糾正性條件

在分析防御者的可糾正性條件時,研究團隊重點關注了防御者在不同人類理性程度下的行為。他們發現,當防御者相信人類的理性較高時,防御者會更頻繁地請求人類監督,從而確保其行為的安全性和一致性。然而,當防御者對人類的理性信念較低時,其更傾向于自主行動,以避免因不確定的監督而產生的不良后果。

研究還發現,不同游戲類型對防御者的可糾正性策略有顯著影響。例如,在單調游戲中,防御者的策略較為簡單,通常會選擇唯一的最佳策略;而在諧波游戲中,由于策略之間的復雜依賴關系,防御者的決策變得更加復雜,并且更容易受到對手策略變化的影響。

討論人類理性對系統設計的影響

人類理性在系統設計中起著至關重要的作用。研究表明,當防御者對人類理性的信念較高時,其更傾向于請求人類監督,從而確保系統的可糾正性。然而,過度依賴人類監督可能會降低系統的自主性。因此,在設計多代理系統時,工程師需要在自主性和可糾正性之間找到平衡點,以確保系統在關鍵時刻能夠有效響應并進行糾正。

通過對防御者與對手互動的建模和分析,研究團隊揭示了在不確定環境下實現防御者可糾正性的關鍵因素。這一研究不僅為網絡安全中的對抗性系統設計提供了理論依據,還為實際應用中的多代理系統設計提供了寶貴的指導。通過合理設計自主代理的信念和策略,可以在確保系統安全性的同時,提高其在復雜環境中的魯棒性和可靠性。

復雜情況下的機器人行為

在研究多智能體系統的可糾正性時,理解機器人在不同游戲環境中的行為至關重要。單調游戲和諧波游戲提供了兩個不同的場景,幫助我們分析代理在這些情況下的決策策略。

單調游戲與諧波游戲的對比

單調游戲是指每個代理獨立選擇其最佳策略,而不需要考慮其他代理的選擇。這類游戲的特點是每個代理都有一個明確的最優策略,且這些策略之間不存在復雜的依賴關系。例如,在某些工業機器人任務中,每個機器人可以獨立決定是否處理特定資源,而不需要考慮其他機器人的選擇。

相反,諧波游戲(如石頭剪刀布)則要求代理之間進行戰略互動。這種游戲中,每個代理的最佳策略取決于其他代理的選擇,且通常不存在純粹的納什均衡解。諧波游戲的特征在于策略選擇之間存在改進循環,即一個代理的最佳策略會不斷變化,取決于其他代理的策略。

不確定性對策略選擇的影響

在多代理系統中,引入不確定性可以顯著影響代理的策略選擇。研究團隊通過構建代理對游戲的信念分布,分析了不同不確定性情況下的策略選擇。當代理對人類理性的信念較高時,其更傾向于請求人類監督,以確保其行為符合預期。然而,當代理對游戲類型和人類行為的不確定性增加時,其策略選擇變得更加復雜。

例如,在單調游戲中,由于每個代理都有一個明確的最優策略,代理通常會選擇這一策略并且請求人類監督的動機較弱。相反,在諧波游戲中,由于策略選擇的依賴關系,代理更可能在不確定性增加時請求人類監督,以避免因錯誤決策而導致的不利后果。

相圖分析與反直覺特征

為了更好地理解多代理系統中的復雜行為,研究團隊使用相圖分析展示了不同條件下的納什均衡。在相圖中,x軸表示代理對游戲的信念,y軸表示人類的理性程度。通過相圖,研究團隊能夠直觀地展示在不同信念和理性條件下,代理的最佳策略選擇。

相圖中最引人注目的是一些反直覺特征。例如研究發現,在某些情況下,當人類理性降低時,代理反而更傾向于請求人類監督。這一現象在諧波游戲中尤為明顯,因為代理希望通過人類的干預來避免因策略依賴關系而產生的不利后果。

通過相圖分析,研究團隊揭示了多代理系統中的一些關鍵行為模式,并為系統設計提供了寶貴的見解。這些反直覺特征表明,在設計多代理系統時,需要充分考慮代理之間的互動和不確定性對策略選擇的影響。

通過對單調游戲和諧波游戲的對比研究,研究團隊深入分析了多代理系統中代理在復雜情況下的行為。通過引入不確定性和使用相圖分析,他們展示了多代理系統中可糾正性的實現條件,并揭示了一些在實際應用中可能遇到的反直覺特征。這一研究為多代理系統的設計提供了理論基礎,并為實際應用中的安全性和有效性提供了指導。

實際應用與挑戰

研究團隊不僅在理論上探討了多代理系統的可糾正性問題,還提出了在實際應用中的具體場景。這些應用場景涵蓋了多代理系統設計、網絡安全中的對抗性系統等,分析了面臨的主要挑戰和可能的解決方案。

多代理系統設計中的實際應用

多代理系統設計是當前人工智能和機器人研究中的一個重要領域。在實際應用中,多個自主代理需要協同工作,以完成復雜的任務。例如,在工業生產中,多個機器人可以協作進行裝配、加工和運輸;在智能交通系統中,多輛自主駕駛車輛需要協同確保交通順暢和安全。

研究團隊提出的博弈論框架為這些多代理系統的設計提供了理論基礎。通過引入不確定性,系統設計者可以確保代理在需要時能夠接受人類的監督和糾正,從而提高系統的安全性和魯棒性。具體來說,設計者可以根據不同的應用場景調整代理的信念分布和人類理性程度,以優化系統的整體表現。

網絡安全中的對抗性系統

在網絡安全領域,對抗性系統的設計是一個關鍵問題。網絡攻擊日益復雜和多樣化,自主防御代理在保護關鍵基礎設施時起著至關重要的作用。研究團隊的模型模擬了一個自主代理(防御者)和一個對手之間的博弈,通過分析防御者在不同情景下的策略選擇,為網絡安全系統的設計提供了指導。

具體而言,當防御者對人類理性的信念較高時,其更傾向于請求人類監督,以確保在面對復雜攻擊時做出最佳決策。然而,防御者也需要在自主性和可糾正性之間找到平衡點,以避免過度依賴人類監督而降低系統的反應速度和自主性。通過合理設計防御者的信念分布和對手策略的建模,系統設計者可以提高防御者在面對不確定環境時的表現。

面臨的挑戰與解決方案

盡管多代理系統在實際應用中具有廣闊的前景,但也面臨著一系列挑戰。,隨著代理數量和動作空間的增加,計算復雜度顯著提高,直接計算可糾正性區域變得更加困難。為解決這一問題,設計者需要簡化系統建模,并對代理的行為作出合理假設,以降低計算復雜度。

過度依賴人類監督可能會降低系統的自主性,在實際應用中,如何在自主性和可糾正性之間找到平衡點,是一個重要的研究方向。通過引入學習動態和自適應機制,系統可以根據實際情況動態調整代理的策略選擇,以確保在關鍵時刻能夠有效響應并進行糾正。

最后,不確定性對策略選擇的影響需要進一步研究。盡管引入不確定性可以提高系統的魯棒性,但也可能導致代理在某些情況下做出次優決策。研究團隊建議,通過使用先進的博弈論分析工具和算法,系統設計者可以更好地預測代理在不同不確定性條件下的行為,從而優化系統設計。

未來工作與研究方向

研究團隊探討了多智能體系統中的可糾正性問題,并提出了基于博弈論的分析框架。盡管取得了重要進展,但仍有許多問題需要進一步探索,并且學習動態對可糾正性的影響也值得深入研究。

未來需要進一步探索的問題

盡管本文提出了多代理博弈中的可糾正性框架,但在更大規模和更復雜的系統中,該框架的適用性尚未得到全面驗證。研究團隊建議在未來的工作中,通過實際應用測試和大規模模擬,進一步驗證和完善這一框架。這將有助于理解在不同應用場景下,自主代理系統的行為特征和可糾正性表現。

代理之間的策略依賴關系對系統的整體可糾正性影響重大。特別是在諧波游戲等復雜互動環境中,代理的策略選擇和相互依賴關系變得尤為復雜。未來的研究可以深入探討不同類型的策略依賴關系,及其對系統可糾正性和一致性的影響,以優化多代理系統設計。

學習動態對可糾正性的影響

學習動態是指代理通過與環境互動,不斷調整和優化其策略的過程。這一過程在實際應用中尤為重要,因為自主代理需要在不斷變化的環境中進行自我調整,以實現最佳表現。然而,學習動態也可能導致代理“學會”次優策略,甚至脫離原有設計的可糾正性區域。

未來研究需要重點關注以下幾個方面:

學習動態的建模與分析:通過構建更精確的學習動態模型,分析代理在不同學習策略和環境變化下的行為。這將有助于理解學習動態對可糾正性和一致性的具體影響。

學習動態與人類監督的結合:研究如何在學習動態過程中,合理引入人類監督,以確保代理在學習過程中保持可糾正性。特別是在關鍵決策時刻,通過人類干預可以有效避免系統陷入次優狀態。

學習算法的優化:開發和優化新的學習算法,使代理能夠更快適應環境變化,并在保持可糾正性的同時,實現更高效的決策。

潛在的研究方向和應用場景

基于當前研究成果,未來的研究可以拓展到以下幾個方向和應用場景,在智能交通系統中,多個自主駕駛車輛需要協同工作,確保交通安全和流暢。研究如何在這種多代理環境中引入不確定性和人類監督,以提高系統的可糾正性和一致性。在醫療領域,自主機器人可以輔助醫生完成復雜手術和治療。通過引入可糾正性框架,可以確保這些機器人在關鍵時刻接受醫生的監督和干預,保證手術的安全性和成功率。在工業自動化中,多個自主機器人協同工作以提高生產效率和產品質量。研究如何優化這些機器人的學習動態和策略選擇,使其在保持自主性的同時,實現更高效的協作。

未來的研究將繼續探索多代理系統中的可糾正性問題,特別是學習動態和復雜互動對系統行為的影響。通過結合先進的博弈論分析和學習算法優化,可以進一步提升多智能體系統的安全性、魯棒性和效率,為實際應用中的廣泛領域提供支持。(END)

參考資料:https://arxiv.org/abs/2501.05360

本文轉載自??大噬元獸?? ,作者: FlerkenS