LangChain 2024年人工智能發(fā)展報告 精華

2024年即將結束,回顧這一年與大語言模型(LLMs)的共同進步,我們見證了許多令人振奮的變化。每個月,約有30,000名新用戶加入了 LangSmith,這讓我們得以更清楚地觀察到人工智能領域的變革。

就像去年我們所做的那樣,我們在此分享一些有趣的統(tǒng)計數(shù)據(jù),揭示了產品使用模式的變化,以及人工智能生態(tài)系統(tǒng)的演變。特別是隨著開發(fā)者利用 LangSmith 來跟蹤、評估并迭代應用,觀察到一些顯著的趨勢,包括開源模型的使用增長,以及從以檢索為主的工作流轉向了多步驟的 AI 代理應用。

接下來,我們將通過一些關鍵統(tǒng)計數(shù)據(jù),深入了解開發(fā)者正在關注和構建的內容。

基礎設施使用趨勢

隨著大語言模型(LLMs)的快速發(fā)展,大家不禁要問:“哪些模型最受歡迎?”讓我們來一起看看這一年在這方面的變化。

主要 LLM 提供商

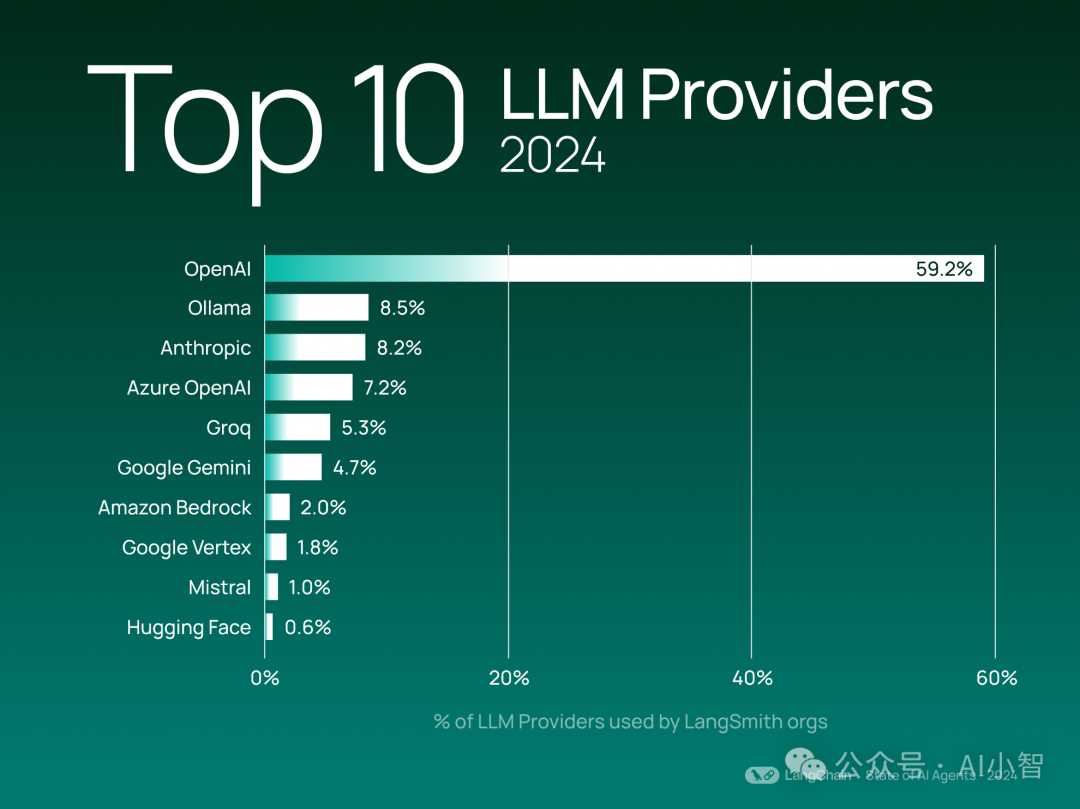

與去年相比,OpenAI 仍然是 LangSmith 用戶中最受歡迎的 LLM 提供商,使用量是排名第二的 Ollama 的六倍以上(按組織使用量計算)。

不過,Ollama 和 Groq 今年的增長勢頭非常強勁,成功躋身前五名。這也說明了開發(fā)者對靈活部署選項和可定制人工智能基礎設施的需求日益增加,尤其是這些平臺支持運行開源模型——Ollama 更側重于本地執(zhí)行,而 Groq 更側重云端部署。

至于開源模型的使用情況,與去年相比,主要開源模型提供商保持了一定的一致性——Ollama、Mistral 和 Hugging Face 仍是大部分開發(fā)者使用的主要平臺。這些開源模型的集體使用量占到了**20%**,這顯示了開源生態(tài)系統(tǒng)的強勁發(fā)展。

頂級檢索工具/向量存儲

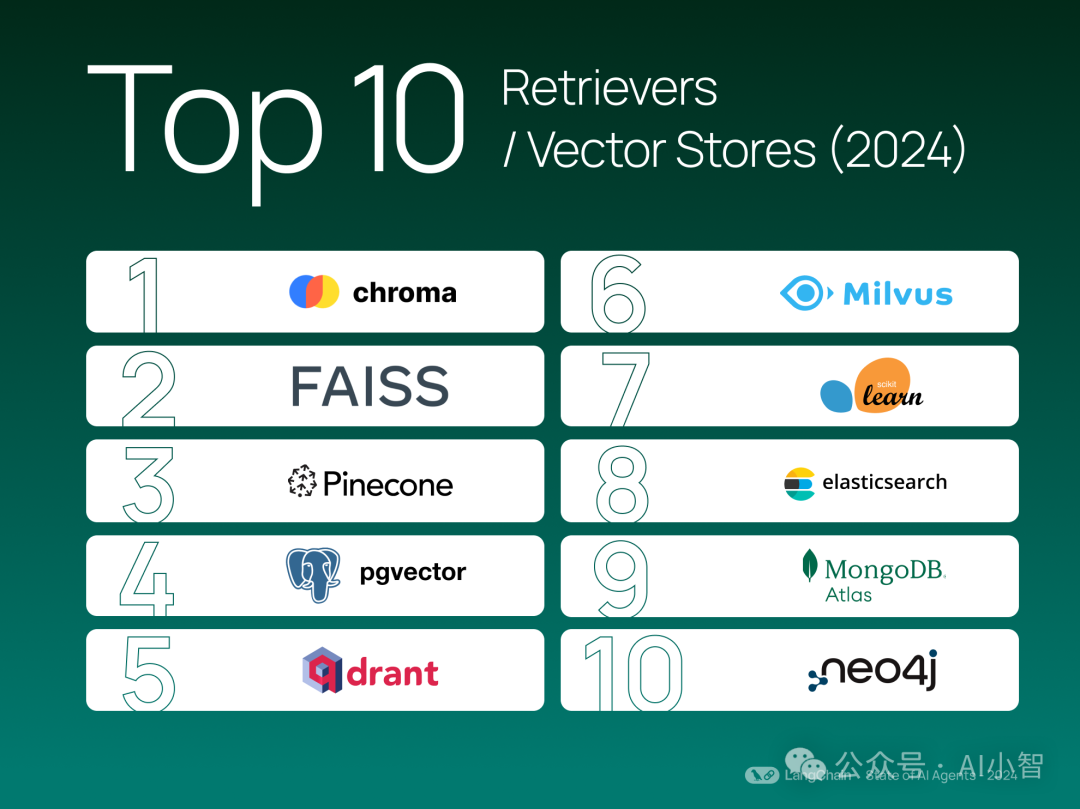

對于許多生成性人工智能(GenAI)工作流來說,檢索仍然是不可或缺的一部分。2024年,排名前列的向量存儲工具并未發(fā)生太大變化,Chroma 和 FAISS 仍然是最受歡迎的選擇。今年,Milvus、MongoDB 和 Elastic 也成功進入了前十名。

LangChain產品在應用構建中的使用

隨著開發(fā)者對生成性人工智能的使用經驗不斷積累,他們開始構建更加復雜和動態(tài)的應用。我們觀察到,從日益復雜的工作流到 AI 代理的崛起,創(chuàng)新生態(tài)系統(tǒng)正在不斷發(fā)展。

可觀察性不僅限于 LangChain 應用

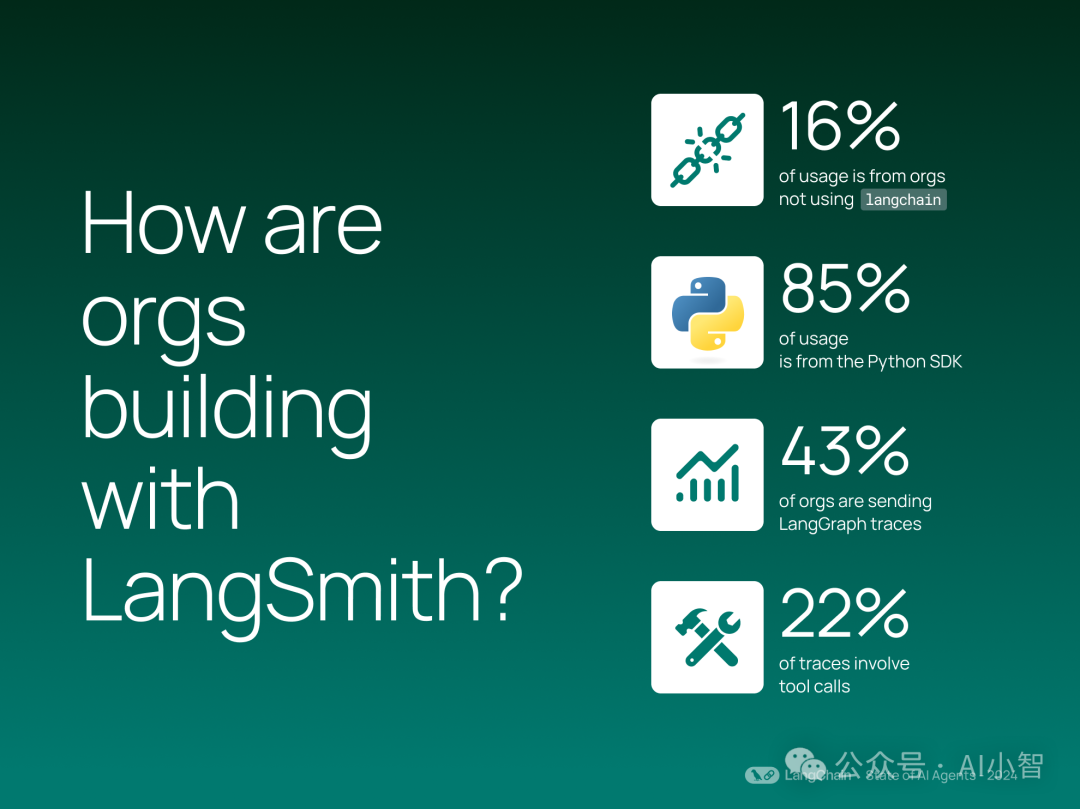

雖然 LangChain(我們的開源框架)是許多開發(fā)者構建 LLM 應用的核心,但 LangSmith 的數(shù)據(jù)表明,約 15.7% 的跟蹤數(shù)據(jù)來自 非LangChain框架。這反映了一個趨勢:無論開發(fā)者使用何種框架來構建 LLM 應用,系統(tǒng)的可觀察性和監(jiān)控都是至關重要的,而 LangSmith 完全支持不同框架之間的互操作性。

Python 依然主導,JavaScript 使用增長

對于許多開發(fā)者來說,調試、測試和監(jiān)控仍然是至關重要的環(huán)節(jié),因此Python SDK占據(jù)了LangSmith使用量的絕大部分,達到 84.7%。不過,隨著開發(fā)者轉向以 Web 為主的應用,JavaScript SDK 也呈現(xiàn)出顯著增長,使用量達到了 LangSmith 總使用量的 **15.3%**,是去年的三倍之多。

AI 代理的關注度持續(xù)提升

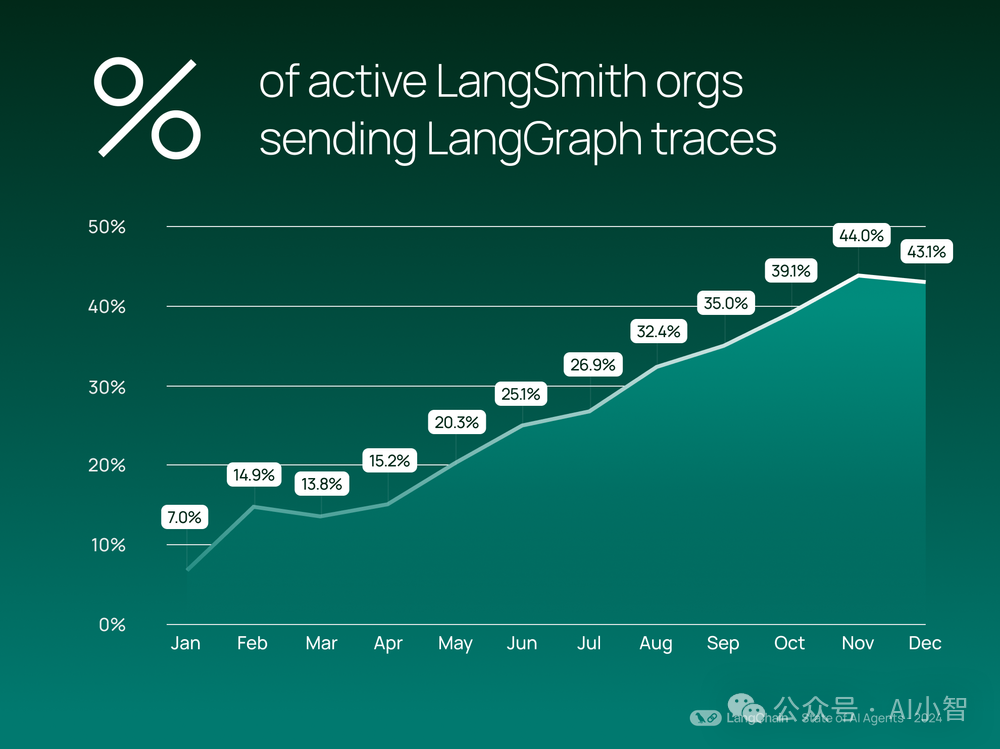

隨著企業(yè)在各個行業(yè)中越來越多地采用 AI 代理,我們的控制代理框架 LangGraph 的使用量也在不斷增加。自從2024年3月發(fā)布以來,43% 的 LangSmith 組織正在使用 LangGraph 進行跟蹤。相比于傳統(tǒng)的 LLM 交互,LangGraph 允許開發(fā)者實現(xiàn)更復雜的任務。

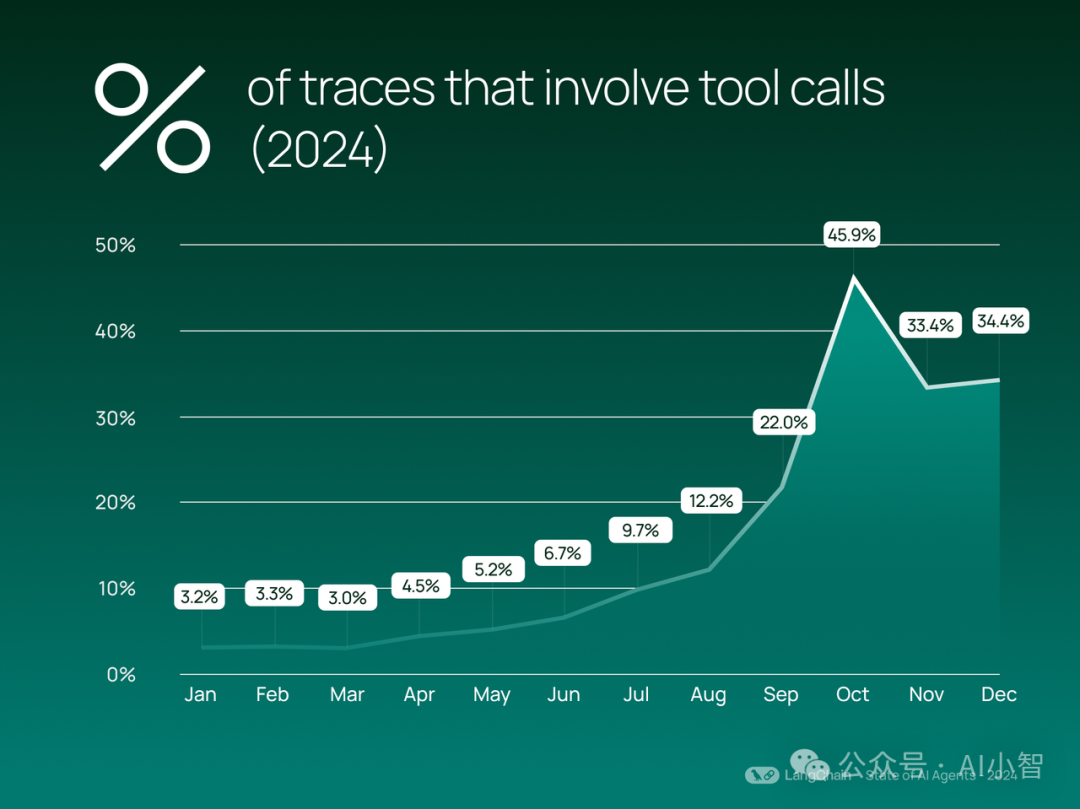

與此同時,工具調用的增加也是一個顯著趨勢,我們看到 21.9% 的跟蹤數(shù)據(jù)涉及工具調用,相比2023年的 0.5% 增長了很多。這表明模型開始更加自主地決定何時采取行動,增強了與外部系統(tǒng)的互動能力,比如執(zhí)行數(shù)據(jù)庫寫入等任務。

性能與優(yōu)化

在應用開發(fā)中,平衡速度與復雜性是一個重要挑戰(zhàn)——尤其是在涉及 LLM 資源時。我們將進一步探討開發(fā)者如何優(yōu)化應用,確保高效性能和復雜性之間的平衡。

復雜性不斷增長,任務處理更高效

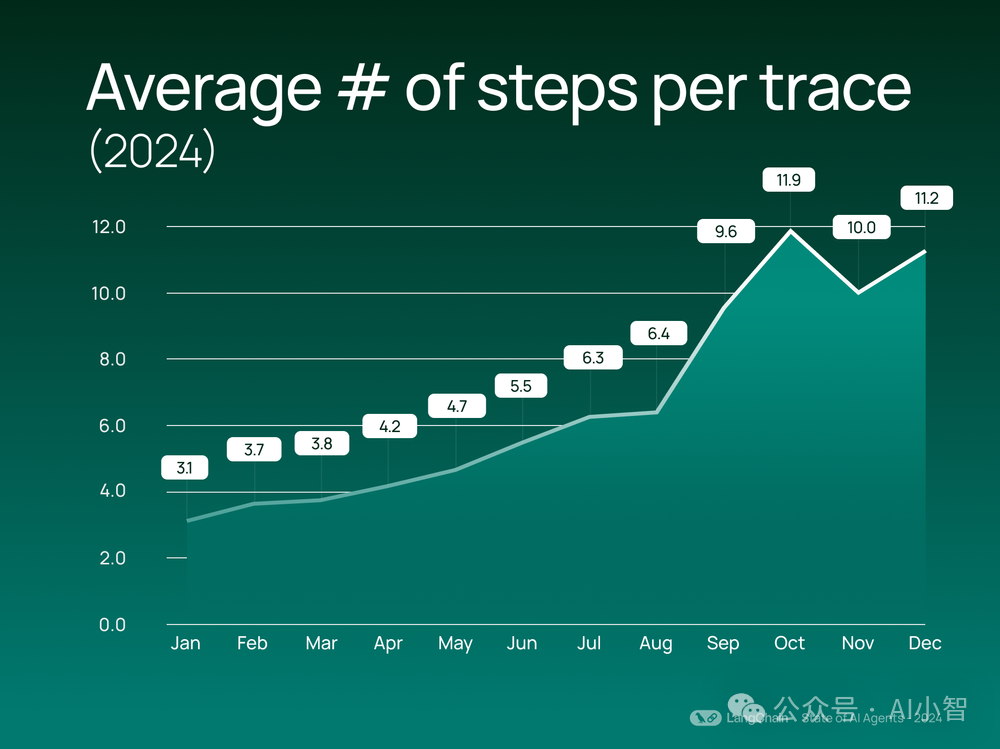

過去一年中,平均步驟數(shù)翻倍,從 2023年 的 2.8步 增長到 2024年的7.7步。這表明開發(fā)者越來越多地采用多步驟的工作流——例如,信息檢索、數(shù)據(jù)處理和生成結果等操作。這些系統(tǒng)能夠串聯(lián)多個任務,提高了工作的綜合效率。

相比之下,LLM調用次數(shù)的增長較為溫和——從 1.1次 增長到 1.4次。這表明開發(fā)者正在設計更加高效的系統(tǒng),通過較少的 LLM 調用完成更多任務,從而有效控制高成本的 LLM 請求。

LLM 測試與評估

為了確保生成的LLM響應質量和準確性,開發(fā)者通常采取哪些措施進行測試?雖然保持高質量的LLM應用始終是個挑戰(zhàn),越來越多的組織開始借助 LangSmith 的評估能力來實現(xiàn)自動化測試和用戶反饋循環(huán),從而提升應用的可靠性和穩(wěn)定性。

LLM 作為評估工具

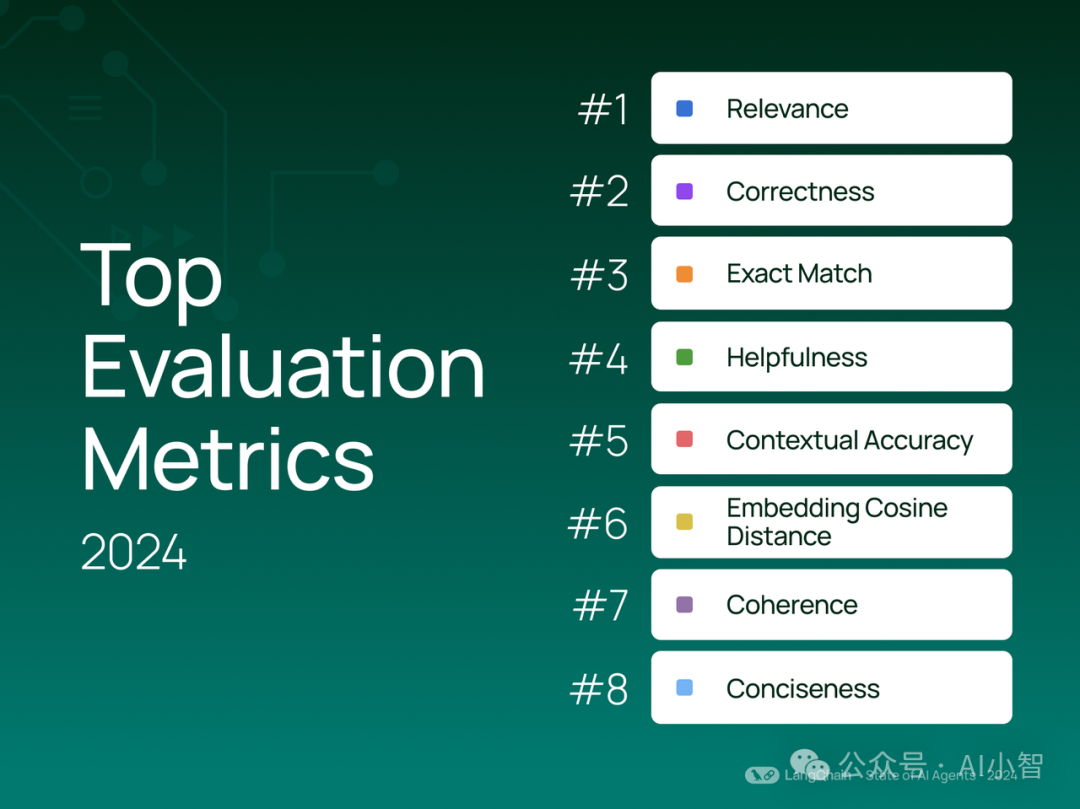

開發(fā)者正在使用 LLM 來評估輸出結果,判斷其是否符合預設標準。最常見的測試特征包括:相關性、準確性、完全匹配 和 有用性。

這些測試結果表明,開發(fā)者通常進行基礎檢查,以確保生成的 AI 輸出不會完全偏離目標。

通過人工反饋不斷迭代

人工反饋對于迭代開發(fā)至關重要。借助 LangSmith,開發(fā)者可以更加高效地收集和整合人工反饋,進而改進和優(yōu)化應用。在過去的一年里,標注的運行記錄數(shù)量增加了 18倍,這與 LangSmith 使用量的增長保持一致。

每次運行的反饋量也略有增加,從 2.28條 增長到 2.59條。然而,盡管每次運行的反饋數(shù)量有所增加,整體反饋仍然偏少,開發(fā)者可能更注重快速審查,或只對最關鍵的部分進行反饋。

結論

2024年,開發(fā)者通過構建多步驟的代理模型應對更高的復雜性,采用更高效的工作流,并通過反饋和評估提高了應用的質量。隨著更多 LLM 應用的出現(xiàn),開發(fā)者對更智能的工作流、更高效的性能和更強的可靠性提出了更高的要求。

本文轉載自 ??AI小智??,作者: AI小智