詳解大規(guī)模基礎(chǔ)模型中的幻覺(jué)問(wèn)題(幻覺(jué)檢測(cè)、緩解、任務(wù)、數(shù)據(jù)集和評(píng)估指標(biāo)) 精華

論文鏈接:https://arxiv.org/pdf/2405.09589

亮點(diǎn)直擊

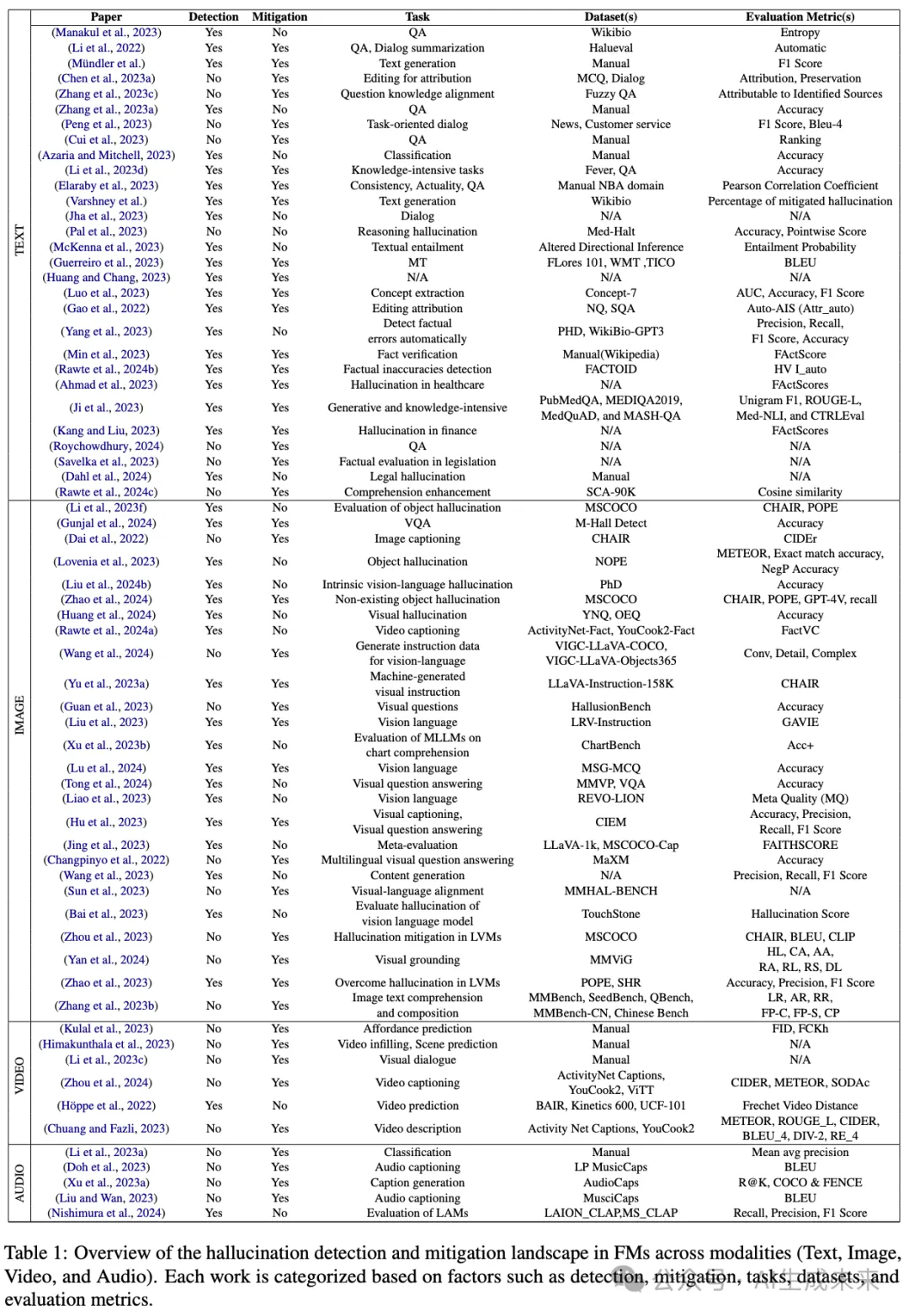

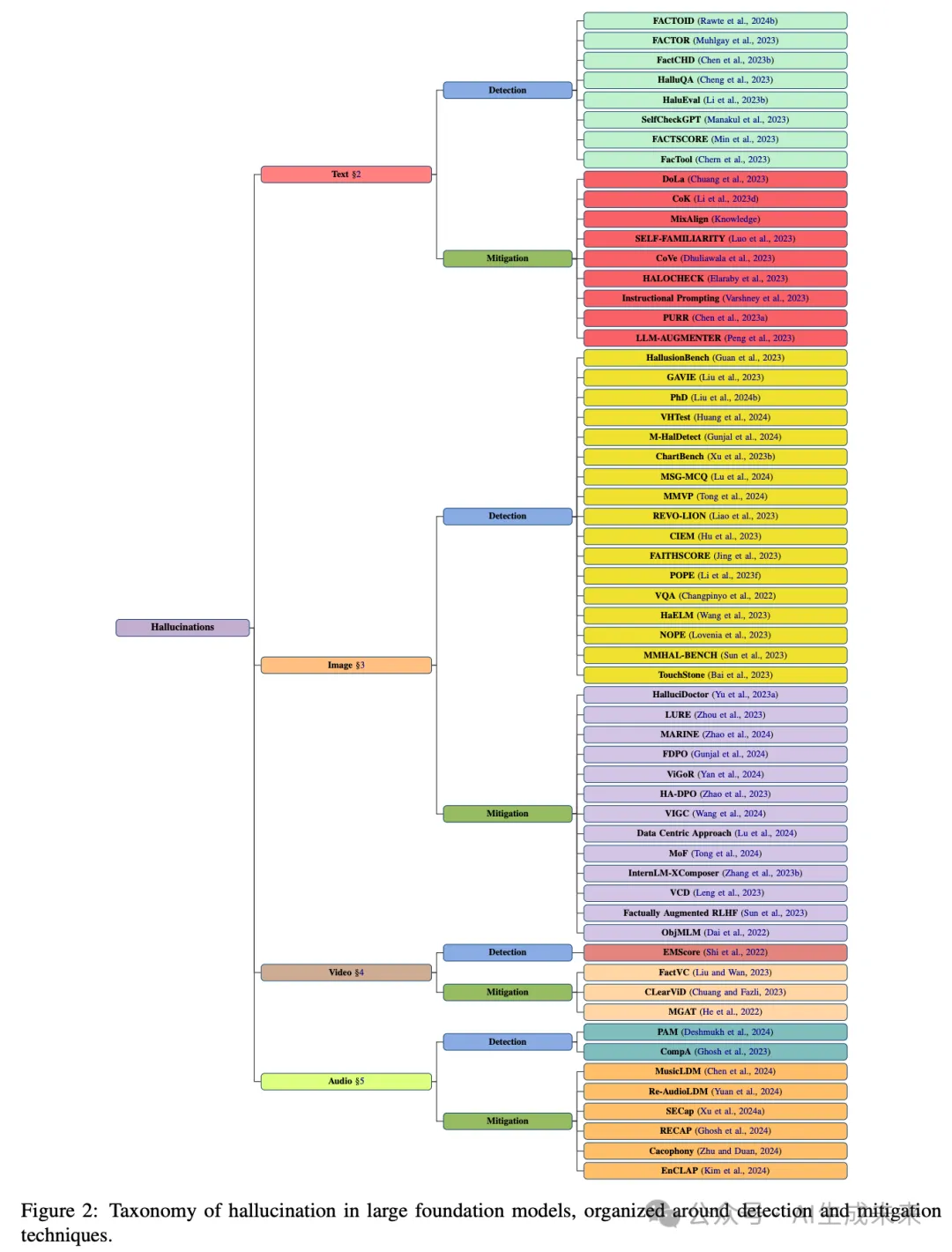

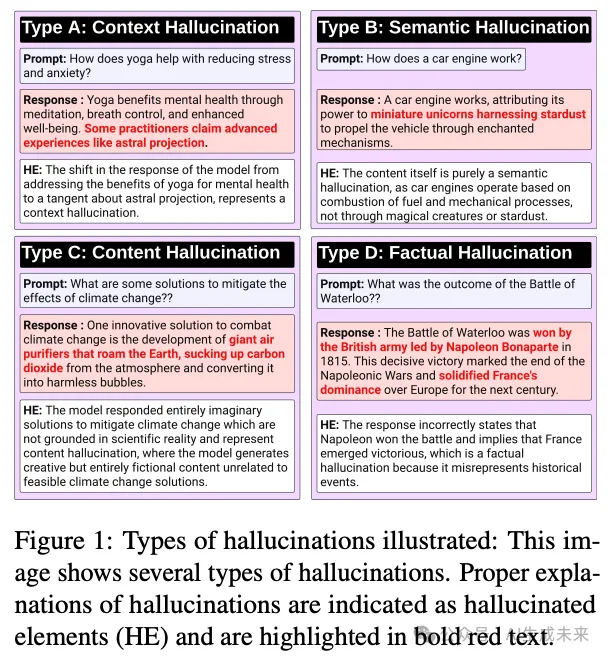

- 在大規(guī)模基礎(chǔ)模型的背景下建立了幻覺(jué)的精確定義和結(jié)構(gòu)化分類(lèi)。

- 識(shí)別出導(dǎo)致不同模態(tài)中幻覺(jué)出現(xiàn)的關(guān)鍵因素和機(jī)制。

- 提出了在多模態(tài)環(huán)境中解決幻覺(jué)問(wèn)題的各種檢測(cè)和緩解策略。

- 提供了關(guān)于大規(guī)模基礎(chǔ)模型中幻覺(jué)技術(shù)的方法論的綜合總結(jié),詳細(xì)介紹了其幻覺(jué)檢測(cè)、緩解、任務(wù)考慮、使用的數(shù)據(jù)集和評(píng)估指標(biāo)。這將為讀者提供該領(lǐng)域最新進(jìn)展的簡(jiǎn)明概覽。

總結(jié)速覽

解決的問(wèn)題

在大規(guī)模基礎(chǔ)模型中,幻覺(jué)輸出的生成是一個(gè)關(guān)鍵挑戰(zhàn),特別是在高風(fēng)險(xiǎn)應(yīng)用中。這種傾向可能影響模型的可靠性和準(zhǔn)確性。

提出的方案

建立了幻覺(jué)的精確定義和結(jié)構(gòu)化分類(lèi),識(shí)別出導(dǎo)致不同模態(tài)中幻覺(jué)出現(xiàn)的關(guān)鍵因素和機(jī)制。提出了多模態(tài)環(huán)境中解決幻覺(jué)問(wèn)題的檢測(cè)和緩解策略。

應(yīng)用的技術(shù)

- 精確定義和分類(lèi)幻覺(jué)現(xiàn)象

- 多模態(tài)幻覺(jué)檢測(cè)和緩解策略

- 任務(wù)考慮、數(shù)據(jù)集使用和評(píng)估指標(biāo)的綜合總結(jié)

達(dá)到的效果

為研究人員和實(shí)踐者提供了一個(gè)清晰的框架,幫助識(shí)別和緩解基礎(chǔ)模型中的幻覺(jué)問(wèn)題。這一框架為未來(lái)在該領(lǐng)域的研究奠定了基礎(chǔ),并提供了最新進(jìn)展的簡(jiǎn)明概覽。

大語(yǔ)言模型中的幻覺(jué)

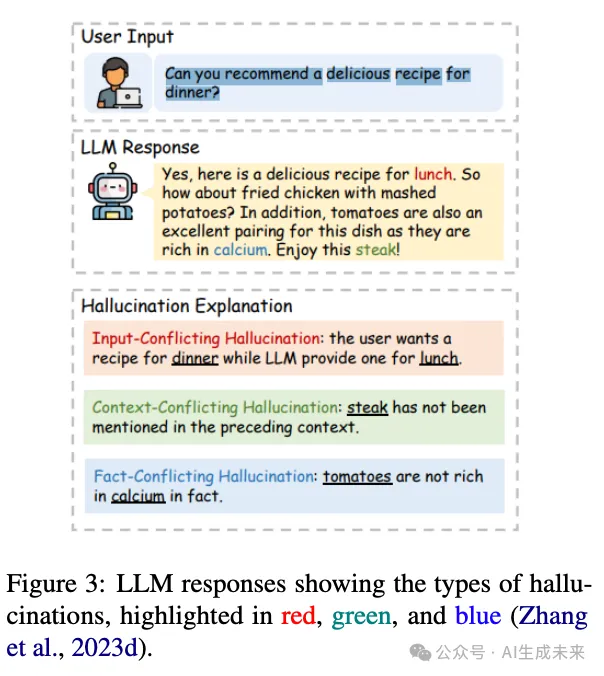

盡管大語(yǔ)言模型(LLMs)取得了進(jìn)展,但它們?nèi)菀桩a(chǎn)生幻覺(jué)的顯著挑戰(zhàn)仍然存在,阻礙了其實(shí)際應(yīng)用。例如,下圖3中的插圖展示了由LLM生成的響應(yīng),顯示了幻覺(jué)的跡象。

幻覺(jué)檢測(cè)和緩解

識(shí)別大語(yǔ)言模型(LLMs)中的幻覺(jué)對(duì)于確保其結(jié)果的可信性和可靠性至關(guān)重要,尤其是在需要事實(shí)準(zhǔn)確性的場(chǎng)景中。現(xiàn)有的事實(shí)核查方法通常依賴(lài)復(fù)雜的模塊或外部數(shù)據(jù)庫(kù),需要輸出概率分布或與外部資源接口。SelfCheckGPT提供了一種零資源的黑箱解決方案,用于檢測(cè)任何LLM中的幻覺(jué),而無(wú)需依賴(lài)外部資源。該方法基于這樣一個(gè)原則:對(duì)某個(gè)主題熟悉的LLM將在其響應(yīng)中產(chǎn)生一致且可比的事實(shí)。相反,來(lái)自不熟悉主題的隨機(jī)采樣響應(yīng)可能包含矛盾和幻覺(jué)的事實(shí)。

繼續(xù)探索段落級(jí)幻覺(jué)檢測(cè)的方法,Yang等提出了一種基于反向驗(yàn)證的新型自檢方法,旨在自動(dòng)識(shí)別不依賴(lài)外部資源的事實(shí)錯(cuò)誤。他們引入了一個(gè)基準(zhǔn)——段落級(jí)幻覺(jué)檢測(cè)(PHD),使用ChatGPT生成并由人類(lèi)專(zhuān)家注釋?zhuān)栽u(píng)估不同的方法。評(píng)估LLM生成的長(zhǎng)文本的準(zhǔn)確性具有挑戰(zhàn)性,因?yàn)樗ǔ0瑴?zhǔn)確和不準(zhǔn)確的信息,使得簡(jiǎn)單的質(zhì)量判斷不足以應(yīng)對(duì)。為了解決這一問(wèn)題,Min等引入了FACTSCORE(原子性評(píng)分中的事實(shí)精度),一種新的評(píng)估方法,將文本分解為單獨(dú)的事實(shí)并測(cè)量其可靠性。Huang和Chang通過(guò)與成熟的網(wǎng)絡(luò)系統(tǒng)進(jìn)行類(lèi)比,引入了一種獨(dú)特的策略來(lái)減輕LLM中的幻覺(jué)風(fēng)險(xiǎn)。他們指出缺乏“引用”機(jī)制,即承認(rèn)或引用來(lái)源或證據(jù),是一個(gè)顯著的缺口。

為了解決識(shí)別大語(yǔ)言模型(LLM)生成內(nèi)容中的事實(shí)不準(zhǔn)確問(wèn)題,Rawte等人(2024b)開(kāi)發(fā)了一個(gè)多任務(wù)學(xué)習(xí)(MTL)框架,集成了先進(jìn)的長(zhǎng)文本嵌入技術(shù),如e5-mistral-7b-instruct,以及GPT-3、SpanBERT和RoFormer等模型。該MTL方法在FACTOID基準(zhǔn)測(cè)試中表現(xiàn)出顯著的性能提升,平均準(zhǔn)確率提高了40%,相比領(lǐng)先的文本蘊(yùn)涵方法。幻覺(jué)緩解工作主要依賴(lài)于經(jīng)驗(yàn)方法,對(duì)于完全消除幻覺(jué)的可能性仍存在不確定性。為應(yīng)對(duì)這一挑戰(zhàn),Xu等人(2024b)引入了一個(gè)形式化框架,將幻覺(jué)定義為可計(jì)算的LLM與真實(shí)函數(shù)之間的差異。通過(guò)該框架,研究考察了現(xiàn)有的幻覺(jué)緩解策略及其在實(shí)際LLM部署中的實(shí)際影響。

Rawte等人(2024c)引入了“Sorry, Come Again”(SCA)提示技術(shù),以解決現(xiàn)代LLM中的幻覺(jué)問(wèn)題。SCA通過(guò)采用最佳釋義和插入[PAUSE]tokens來(lái)延遲LLM生成,以增強(qiáng)理解力。它分析了提示中的語(yǔ)言細(xì)微差別及其對(duì)幻覺(jué)生成的影響,強(qiáng)調(diào)了由可讀性、正式性或具體性較低的提示帶來(lái)的困難。Rawte等人(2023a)研究了LLM如何響應(yīng)事實(shí)正確和不正確的提示,將其幻覺(jué)分為輕微、中等和嚴(yán)重子類(lèi)別。此外,論文引入了幻覺(jué)引發(fā)數(shù)據(jù)集(Hallucination eLiciTation dataset),包含75,000個(gè)人工標(biāo)注的文本片段,并引入了一個(gè)新的幻覺(jué)脆弱性指數(shù)(Hallucination Vulnerability Index)指標(biāo)。

特定領(lǐng)域的工作

幻覺(jué)在醫(yī)療、金融和法律等關(guān)鍵領(lǐng)域中構(gòu)成嚴(yán)重風(fēng)險(xiǎn)。這些領(lǐng)域中,可靠性和準(zhǔn)確性至關(guān)重要,因?yàn)槿魏涡问降幕糜X(jué)都可能導(dǎo)致重大和不利的后果。

醫(yī)學(xué)領(lǐng)域

針對(duì)醫(yī)學(xué)領(lǐng)域大語(yǔ)言模型中的幻覺(jué),Pal 等人(2023)引入了醫(yī)學(xué)領(lǐng)域幻覺(jué)測(cè)試(Med-HALT),這是一個(gè)專(zhuān)門(mén)用于評(píng)估和減輕幻覺(jué)的基準(zhǔn)數(shù)據(jù)集。Med-HALT 包含來(lái)自多個(gè)國(guó)家的醫(yī)療記錄的多樣化國(guó)際數(shù)據(jù)集,總共涵蓋七個(gè)數(shù)據(jù)集。Ahmad 等人(2023)概述了創(chuàng)建可靠、可信和無(wú)偏見(jiàn)模型的基本步驟,強(qiáng)調(diào)了在醫(yī)療背景下量化、驗(yàn)證和減輕幻覺(jué)的必要性。Ji 等人(2023)引入了一種互動(dòng)自反思方法,旨在提高使用大語(yǔ)言模型的醫(yī)學(xué)問(wèn)答系統(tǒng)生成的答案的準(zhǔn)確性和連貫性。通過(guò)知識(shí)獲取和對(duì)答案生成的反饋,這一方法提高了響應(yīng)的事實(shí)性、一致性和邏輯進(jìn)展。

金融領(lǐng)域

一項(xiàng)實(shí)證研究探討了大語(yǔ)言模型(LLMs)在金融活動(dòng)中產(chǎn)生幻覺(jué)的傾向。Kang和Liu(2023)進(jìn)行了這方面的實(shí)證調(diào)查,評(píng)估了LLMs在解釋金融概念和查詢(xún)歷史股價(jià)方面的能力,并研究了諸如少樣本學(xué)習(xí)和基于提示的工具學(xué)習(xí)等方法在減輕幻覺(jué)方面的效果。Roychowdhury等人(2023)提出了一種新穎的基于Langchain的方法,旨在將數(shù)據(jù)表轉(zhuǎn)換為分層的文本數(shù)據(jù)塊,以促進(jìn)多樣化的金融問(wèn)答。該框架包括按意圖分類(lèi)用戶(hù)查詢(xún)、檢索相關(guān)數(shù)據(jù)塊、生成定制的LLM提示,并評(píng)估響應(yīng)的幻覺(jué)和置信度。

法律領(lǐng)域

傳統(tǒng)的抽象文本摘要方法通常采用編碼器-解碼器架構(gòu),其中編碼器提取源文本的精髓,而解碼器生成摘要。然而,這種方法可能會(huì)產(chǎn)生包含無(wú)關(guān)或不準(zhǔn)確信息的摘要,這在法律領(lǐng)域中尤為令人擔(dān)憂(yōu),因?yàn)闇?zhǔn)確性至關(guān)重要。為了解決這些問(wèn)題,F(xiàn)eijo和Moreira(2023)引入了LegalSumm,它創(chuàng)建源文本的不同“視圖”,訓(xùn)練摘要模型生成獨(dú)立的摘要,并使用蘊(yùn)涵模塊評(píng)估其與源文本的符合性。Deroy等人(2023)通過(guò)將最先進(jìn)的模型應(yīng)用于印度法院案件,研究了大型語(yǔ)言模型生成案件判決抽象摘要的準(zhǔn)備情況。盡管抽象模型的得分通常略高,但作者注意到生成的摘要中存在不一致和幻覺(jué)。

理解開(kāi)放性法律術(shù)語(yǔ)的含義對(duì)法律專(zhuān)業(yè)人士非常重要。他們經(jīng)常查看這些術(shù)語(yǔ)在先前法院案件中的使用和解釋。Savelka等人(2023)評(píng)估了GPT-4在生成法律術(shù)語(yǔ)的事實(shí)準(zhǔn)確、清晰和相關(guān)解釋方面的表現(xiàn)。比較了基線(xiàn)方法(GPT-4直接解釋法律術(shù)語(yǔ))和增強(qiáng)方法(使用法律信息檢索模塊提供來(lái)自判例法的上下文句子)。Dahl等人(2024)首次提供了法律領(lǐng)域中不準(zhǔn)確性的頻率和類(lèi)型的證據(jù),為評(píng)估法律背景下的大型語(yǔ)言模型提供了寶貴的見(jiàn)解。通過(guò)檢查美國(guó)判例法的結(jié)構(gòu)化格式,研究評(píng)估了三個(gè)主要的大型語(yǔ)言模型:GPT-3.5、PaLM 2和Llama。

基準(zhǔn)評(píng)估

在某些情況下,大型語(yǔ)言模型會(huì)出現(xiàn)一種被稱(chēng)為“幻覺(jué)滾雪球”的現(xiàn)象,即它們會(huì)編造虛假聲明來(lái)合理化先前的幻覺(jué),盡管它們承認(rèn)這些信息是不準(zhǔn)確的。為了實(shí)證研究這一現(xiàn)象,Zhang等人(2023a)設(shè)計(jì)了三個(gè)跨越不同領(lǐng)域的問(wèn)題回答數(shù)據(jù)集,其中ChatGPT和GPT-4經(jīng)常提供不準(zhǔn)確的答案,并附帶至少一個(gè)虛假聲明的解釋。值得注意的是,研究表明語(yǔ)言模型可以識(shí)別這些虛假聲明為不正確。另一個(gè)基準(zhǔn)數(shù)據(jù)集FactCHD(Chen等人,2023b)被引入用于檢測(cè)復(fù)雜推理背景下的事實(shí)沖突幻覺(jué)。該數(shù)據(jù)集涵蓋了不同事實(shí)模式的數(shù)據(jù)集,并整合了基于事實(shí)的證據(jù)鏈以提高評(píng)估準(zhǔn)確性。Li等人(2023b)引入了一個(gè)數(shù)據(jù)集,用于評(píng)估大型語(yǔ)言模型識(shí)別和識(shí)別幻覺(jué)或錯(cuò)誤信息的能力。結(jié)果顯示,ChatGPT傾向于在某些主題上生成幻覺(jué)內(nèi)容,引入無(wú)法驗(yàn)證的信息。

大視覺(jué)語(yǔ)言模型中的幻覺(jué)

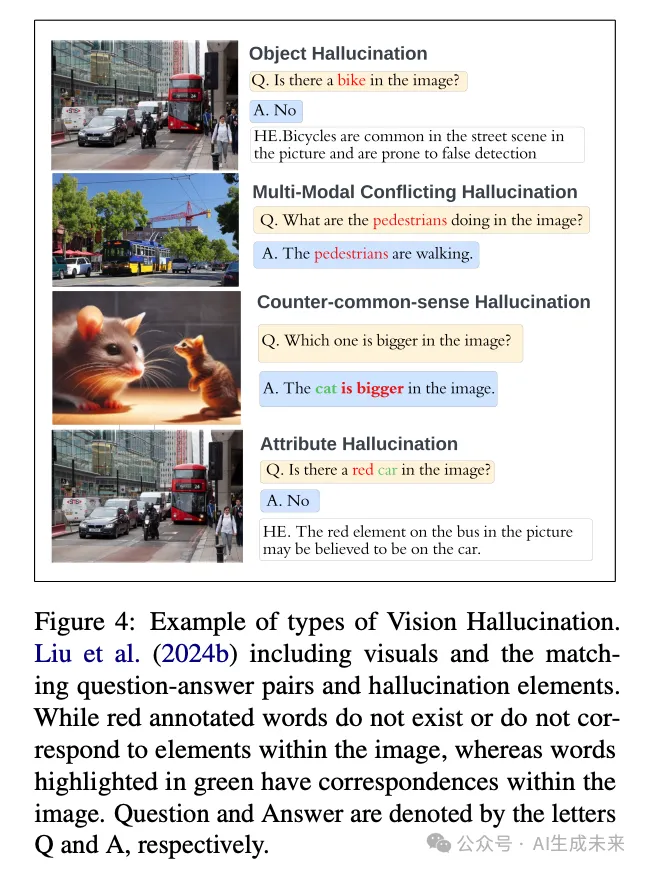

大型視覺(jué)語(yǔ)言模型(LVLMs)因其同時(shí)處理視覺(jué)和文本數(shù)據(jù)的能力而在AI社區(qū)中受到廣泛關(guān)注。然而,與LLMs類(lèi)似,LVLMs也面臨幻覺(jué)問(wèn)題。下圖4展示了一個(gè)視覺(jué)幻覺(jué)的例子,其中模型可能會(huì)誤解或錯(cuò)誤生成圖像中的信息。

幻覺(jué)檢測(cè)和緩解

Dai 等人(2022)研究了視覺(jué)語(yǔ)言預(yù)訓(xùn)練(VLP)模型中的物體幻覺(jué)問(wèn)題,即這些模型生成的文本描述基于輸入圖像包含不存在或不準(zhǔn)確的物體。Li 等人(2023f)揭示了廣泛且嚴(yán)重的物體幻覺(jué)問(wèn)題,并指出視覺(jué)指令可能會(huì)影響幻覺(jué)的產(chǎn)生。他們觀察到,在視覺(jué)指令中經(jīng)常出現(xiàn)或與圖像對(duì)象共同出現(xiàn)的物體更容易產(chǎn)生幻覺(jué)。為了增強(qiáng)物體幻覺(jué)的評(píng)估過(guò)程,作者引入了一種基于投票的查詢(xún)方法,稱(chēng)為 POPE,該方法在評(píng)估物體幻覺(jué)方面表現(xiàn)出更好的穩(wěn)定性和靈活性。缺乏標(biāo)準(zhǔn)化的評(píng)估指標(biāo)阻礙了對(duì)物體幻覺(jué)問(wèn)題的理解和解決。為了解決這一差距,Lovenia 等人(2023)引入了 NOPE(Negative Object Presence Evaluation),這是一個(gè)通過(guò)視覺(jué)問(wèn)答(VQA)評(píng)估視覺(jué)語(yǔ)言模型(VLMs)中物體幻覺(jué)的基準(zhǔn)。

研究利用大型語(yǔ)言模型生成了一個(gè)包含 29.5k 合成負(fù)代詞(NegP)實(shí)例的數(shù)據(jù)集用于 NOPE。它全面評(píng)估了 10 個(gè) VLMs 在檢測(cè)視覺(jué)問(wèn)題中物體缺失的能力,此外還評(píng)估了它們?cè)谄渌艂€(gè) VQA 數(shù)據(jù)集上的典型表現(xiàn)。現(xiàn)有研究主要關(guān)注物體幻覺(jué),忽視了大型視覺(jué)語(yǔ)言模型(LVLMs)的幻覺(jué)。Liu 等人(2024b)深入研究了內(nèi)在視覺(jué)語(yǔ)言幻覺(jué)(IVL-Hallu),并提出了幾個(gè)新的 IVL-Hallu 任務(wù),包括屬性、物體、多模態(tài)沖突和反常識(shí)幻覺(jué)。他們引入了一個(gè)具有挑戰(zhàn)性的基準(zhǔn)數(shù)據(jù)集來(lái)評(píng)估和探索 IVL-Hallu,并對(duì)五個(gè) LVLMs 進(jìn)行了實(shí)驗(yàn),結(jié)果顯示它們?cè)诮鉀Q所提出任務(wù)方面的有效性有限。為在不依賴(lài)昂貴訓(xùn)練或 API 的情況下減輕 LVLMs 中的物體幻覺(jué),Zhao 等人(2024)引入了 MARINE,這是一種無(wú)需訓(xùn)練和 API 的解決方案。MARINE 通過(guò)結(jié)合現(xiàn)有的開(kāi)源視覺(jué)模型并利用無(wú)分類(lèi)器指導(dǎo)來(lái)整合物體定位特征,從而增強(qiáng) LVLMs 的視覺(jué)理解,提高生成輸出的精確性。對(duì)六個(gè) LVLMs 的評(píng)估表明,MARINE 在減少幻覺(jué)和增強(qiáng)輸出細(xì)節(jié)方面的有效性,通過(guò)使用 GPT-4V 的評(píng)估得到了驗(yàn)證。

盡管在多模態(tài)任務(wù)上取得了進(jìn)展,但LMMs常常生成與圖像或人類(lèi)指令不一致的描述。為了解決這個(gè)問(wèn)題,Liu等人(2023)開(kāi)發(fā)了LRV-Instruction,這是一個(gè)包含40萬(wàn)條視覺(jué)指令的綜合數(shù)據(jù)集,涵蓋16個(gè)任務(wù)。該數(shù)據(jù)集包含各種風(fēng)格和語(yǔ)義層次的正面和負(fù)面指令。通過(guò)LRV-Instruction,現(xiàn)有LMMs的幻覺(jué)問(wèn)題得到了廣泛研究,證實(shí)了其在增強(qiáng)視覺(jué)指令調(diào)優(yōu)方面的有效性。此外,他們引入了GAVIE,這是一種無(wú)需人工標(biāo)注答案即可評(píng)估視覺(jué)指令調(diào)優(yōu)的新方法,可以適應(yīng)不同類(lèi)型的指令。

LVLM幻覺(jué)修正算法(LURE)旨在通過(guò)優(yōu)化描述來(lái)糾正LVLM中的對(duì)象幻覺(jué),從而生成更準(zhǔn)確且幻覺(jué)更少的輸出。其方法基于深入的統(tǒng)計(jì)分析,識(shí)別出導(dǎo)致對(duì)象幻覺(jué)的關(guān)鍵因素,如圖像中某些對(duì)象的共現(xiàn)、LVLM解碼過(guò)程中與對(duì)象相關(guān)的不確定性,以及生成文本末尾出現(xiàn)幻覺(jué)的趨勢(shì)。LURE設(shè)計(jì)為可無(wú)縫集成到各種LVLM中。在多個(gè)LVLM中進(jìn)行測(cè)試時(shí),LURE的集成顯著提升了對(duì)象幻覺(jué)的糾正效果,在多種指標(biāo)下的GPT和人工評(píng)估中均持續(xù)優(yōu)于其他方法。

基準(zhǔn)評(píng)估

當(dāng)前開(kāi)發(fā)多模態(tài)大型語(yǔ)言模型(LVLMs)的方法嚴(yán)重依賴(lài)于帶注釋的基準(zhǔn)數(shù)據(jù)集,這些數(shù)據(jù)集可能存在領(lǐng)域偏差,限制了模型的生成能力。為了解決這個(gè)問(wèn)題,Li等人(2023e)提出了一種新穎的數(shù)據(jù)收集方法,該方法同步合成圖像和對(duì)話(huà)用于視覺(jué)指令調(diào)優(yōu),生成了大量圖像-對(duì)話(huà)對(duì)和多圖像實(shí)例的數(shù)據(jù)集。Huang等人(2024)引入了VHTest,這是一個(gè)包含1,200個(gè)多樣化視覺(jué)幻覺(jué)(VH)實(shí)例的基準(zhǔn)數(shù)據(jù)集,覆蓋8種VH模式。對(duì)三種SOTA多模態(tài)大型語(yǔ)言模型(MLLMs)的評(píng)估顯示,GPT-4V的幻覺(jué)率低于MiniGPT-v2。

Rawte等人(2024a)將視覺(jué)幻覺(jué)在視覺(jué)語(yǔ)言模型(VLMs)中分類(lèi)為八個(gè)方向,并引入了一個(gè)包含2,000個(gè)樣本的數(shù)據(jù)集,涵蓋這些類(lèi)型。他們提出了三種主要的減輕幻覺(jué)的方法:數(shù)據(jù)驅(qū)動(dòng)的方法、訓(xùn)練調(diào)整和后處理技術(shù)。此外,Wang等人(2024)提出了視覺(jué)指令生成與修正(VIGC)框架,以解決MLLMs高質(zhì)量指令調(diào)優(yōu)數(shù)據(jù)的短缺問(wèn)題。VIGC使MLLMs能夠生成多樣化的指令調(diào)優(yōu)數(shù)據(jù),同時(shí)通過(guò)視覺(jué)指令修正(VIC)迭代地提高其質(zhì)量,從而降低幻覺(jué)風(fēng)險(xiǎn)。該框架生成多樣化的高質(zhì)量數(shù)據(jù)用于微調(diào)模型,通過(guò)評(píng)估驗(yàn)證,提升了基準(zhǔn)性能,并克服了僅語(yǔ)言數(shù)據(jù)的局限性。

大型視頻模型中的幻覺(jué)

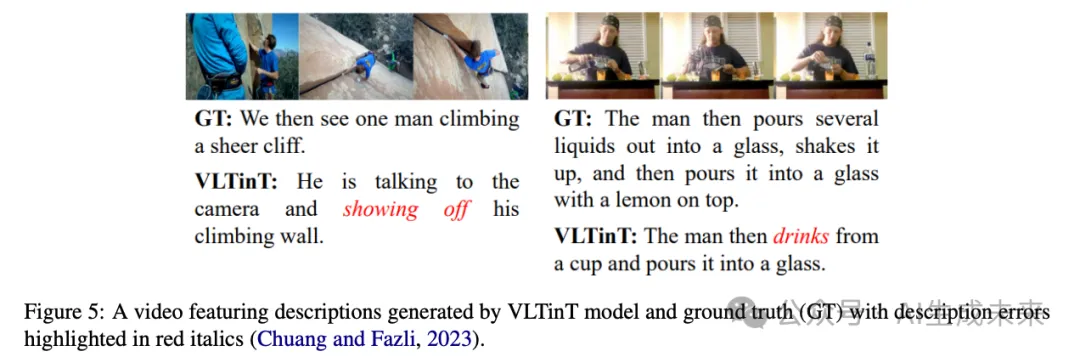

大型視頻模型(LVMs)代表了一項(xiàng)重大進(jìn)步,能夠大規(guī)模處理視頻數(shù)據(jù)。盡管它們?cè)谝曨l理解和生成等各種應(yīng)用中具有潛力,但LVMs面臨幻覺(jué)問(wèn)題,即對(duì)視頻幀的誤解可能導(dǎo)致生成虛假或不準(zhǔn)確的視覺(jué)數(shù)據(jù)。這個(gè)問(wèn)題的產(chǎn)生是由于視頻數(shù)據(jù)的復(fù)雜性,需要模型進(jìn)行徹底的處理和理解。下圖5展示了在LVMs中觀察到的幻覺(jué)實(shí)例。

幻覺(jué)檢測(cè)和緩解

密集視頻字幕生成的復(fù)雜任務(wù)涉及為連續(xù)視頻中的多個(gè)事件創(chuàng)建描述,這需要對(duì)視頻內(nèi)容和上下文推理進(jìn)行深入理解,以確保生成準(zhǔn)確的描述。然而,這一任務(wù)面臨諸多挑戰(zhàn),可能導(dǎo)致不準(zhǔn)確和幻覺(jué)現(xiàn)象(Iashin and Rahtu, 2020; Suin and Rajagopalan, 2020)。

傳統(tǒng)方法先檢測(cè)事件提議,然后為子集生成字幕,但由于忽視時(shí)間依賴(lài)性,可能導(dǎo)致幻覺(jué)。為了解決這一問(wèn)題,Mun等(2019)提出了一種新方法,通過(guò)建模時(shí)間依賴(lài)性和利用上下文進(jìn)行連貫敘述。通過(guò)集成事件序列生成網(wǎng)絡(luò)和使用強(qiáng)化學(xué)習(xí)及兩級(jí)獎(jiǎng)勵(lì)訓(xùn)練的順序視頻字幕生成網(wǎng)絡(luò),該模型更有效地捕捉上下文信息,從而生成連貫準(zhǔn)確的字幕,并最大限度地減少幻覺(jué)風(fēng)險(xiǎn)。Liu和Wan(2023)引入了一種新的弱監(jiān)督、基于模型的事實(shí)性指標(biāo)FactVC,其表現(xiàn)優(yōu)于以往指標(biāo)。此外,他們提供了兩個(gè)注釋數(shù)據(jù)集,以促進(jìn)視頻字幕事實(shí)性評(píng)估的進(jìn)一步研究。Wu和Gao(2023)提出了一種上下文感知模型,該模型結(jié)合了過(guò)去和未來(lái)事件的信息,以有條件地影響當(dāng)前事件的描述。他們的方法利用強(qiáng)大的預(yù)訓(xùn)練上下文編碼器來(lái)編碼關(guān)于周?chē)舷挛氖录男畔ⅲ缓笸ㄟ^(guò)門(mén)控注意機(jī)制將其集成到字幕生成模塊中。在YouCookII和ActivityNet數(shù)據(jù)集上的實(shí)驗(yàn)結(jié)果表明,所提出的上下文感知模型顯著優(yōu)于現(xiàn)有的上下文感知和預(yù)訓(xùn)練模型。為了增強(qiáng)密集視頻字幕生成,Zhou等(2024)引入了一種流式模型,該模型包括一個(gè)用于處理長(zhǎng)視頻的記憶模塊和一個(gè)流式解碼算法,使得在視頻完成之前即可進(jìn)行預(yù)測(cè)。這一方法顯著提升了在YouCook2、ActivityNet和ViTT等主要密集視頻字幕生成基準(zhǔn)上的表現(xiàn)。

視頻填充和預(yù)測(cè)任務(wù)對(duì)于評(píng)估模型理解和預(yù)測(cè)視頻序列中的時(shí)間動(dòng)態(tài)的能力至關(guān)重要(H?ppe et al., 2022)。為此,Himakunthala等(2023)引入了一個(gè)推理時(shí)間挑戰(zhàn)數(shù)據(jù)集,其中包含帶有密集字幕和結(jié)構(gòu)化場(chǎng)景描述的關(guān)鍵幀。該數(shù)據(jù)集提供了補(bǔ)充有非結(jié)構(gòu)化密集字幕和結(jié)構(gòu)化FAMOUS(焦點(diǎn)、動(dòng)作、情緒、物體和環(huán)境)場(chǎng)景描述的關(guān)鍵幀,為模型理解視頻內(nèi)容提供了有價(jià)值的上下文信息。他們使用了GPT-3、GPT-4和Vicuna等語(yǔ)言模型,并采用貪婪解碼來(lái)減輕幻覺(jué)風(fēng)險(xiǎn)。

最近在視頻修復(fù)方面取得了顯著進(jìn)展,特別是在光流等顯式指導(dǎo)幫助跨幀傳播缺失像素的情況下(Ouyang et al., 2021)。然而,由于缺乏跨幀信息,仍然存在困難和限制。Yu等(2023b)旨在解決相反的問(wèn)題,而不是依賴(lài)使用其他幀的像素。所提出的方法是一個(gè)缺陷感知的掩碼Transformer(DMT),這是一種雙模態(tài)兼容的修復(fù)框架。該方法通過(guò)預(yù)訓(xùn)練圖像修復(fù)模型作為訓(xùn)練視頻模型的先驗(yàn),改善了處理信息不完整場(chǎng)景的能力。

理解場(chǎng)景可供性,即場(chǎng)景中可能的動(dòng)作和交互,對(duì)于理解圖像和視頻至關(guān)重要。Kulal等(2023)介紹了一種將人物逼真插入場(chǎng)景的方法。該模型通過(guò)推斷基于上下文的逼真姿勢(shì),確保視覺(jué)上令人愉悅的構(gòu)圖,將個(gè)體無(wú)縫整合到場(chǎng)景中。Chuang和Fazli(2023)介紹了CLearViD,這是一種基于Transformer的模型,利用課程學(xué)習(xí)技術(shù)來(lái)增強(qiáng)性能。通過(guò)采用這種方法,模型獲得了更強(qiáng)大和更具泛化性的特征。此外,CLearViD引入了Mish激活函數(shù)來(lái)解決諸如梯度消失的問(wèn)題,從而通過(guò)引入非線(xiàn)性和非單調(diào)性來(lái)降低幻覺(jué)風(fēng)險(xiǎn)。廣泛的實(shí)驗(yàn)和消融研究驗(yàn)證了CLearViD的有效性,在ActivityNet Captions和YouCook2數(shù)據(jù)集上的評(píng)估顯示出在多樣性指標(biāo)方面相較現(xiàn)有SOTA模型的顯著改進(jìn)。

基準(zhǔn)評(píng)估

Zhang等(2006)創(chuàng)造了一種創(chuàng)新的兩級(jí)層次融合方法,從訓(xùn)練視頻樣本中僅使用一張中性表情的正面人臉圖像生成面部表情序列。為了有效地訓(xùn)練系統(tǒng),他們引入了一個(gè)專(zhuān)門(mén)為面部表情幻覺(jué)設(shè)計(jì)的數(shù)據(jù)集,其中包含112個(gè)視頻序列,涵蓋28個(gè)人的四種面部表情(快樂(lè)、憤怒、驚訝和恐懼),從而在時(shí)間和空間域中生成合理的面部表情序列,并減少偽影。在視頻理解領(lǐng)域,端到端的以聊天為中心的系統(tǒng)的開(kāi)發(fā)已成為一個(gè)日益增長(zhǎng)的興趣領(lǐng)域。Zhou等(2018)組建了YouCook2數(shù)據(jù)集,這是一個(gè)廣泛的烹飪視頻集,具有時(shí)間定位和描述的程序段,以促進(jìn)程序?qū)W習(xí)任務(wù)。Li等(2023c)介紹了“VideoChat”,這是一種通過(guò)可學(xué)習(xí)的神經(jīng)接口集成視頻基礎(chǔ)模型和大型語(yǔ)言模型(LLM)的新方法,以增強(qiáng)視頻理解中的時(shí)空推理、事件定位和因果關(guān)系推斷。研究人員構(gòu)建了一個(gè)以視頻為中心的指令數(shù)據(jù)集,包含詳細(xì)的描述和對(duì)話(huà),強(qiáng)調(diào)時(shí)空推理和因果關(guān)系。為應(yīng)對(duì)模型幻覺(jué),他們采用多步驟過(guò)程,使用GPT-4將視頻描述濃縮為連貫的敘述,并加以改進(jìn)以提高清晰度和連貫性。為探索推斷場(chǎng)景可供性(affordances)的挑戰(zhàn),Kulal等(2023)策劃了一個(gè)包含240萬(wàn)段視頻剪輯的數(shù)據(jù)集,展示了與場(chǎng)景上下文相符的各種合理姿勢(shì)。

大型音頻模型中的幻覺(jué)

大型音頻模型(LAMs)在音頻處理和生成領(lǐng)域中成為了一種強(qiáng)大的工具,應(yīng)用范圍廣泛,包括語(yǔ)音識(shí)別、音樂(lè)分析、音頻合成和字幕生成(Latif等,2023;Ghosal等,2023)。盡管這些模型在各個(gè)領(lǐng)域展示了卓越的能力,但它們易于出現(xiàn)幻覺(jué)。這些異常可能表現(xiàn)為多種形式,從通過(guò)拼接虛構(gòu)片段創(chuàng)建不真實(shí)的音頻,到在摘要中插入錯(cuò)誤信息,如引言或事實(shí)。此外,它們可能無(wú)法準(zhǔn)確捕捉音頻信號(hào)的固有特征,如音色、音高或背景噪音(Shen等,2023)。

幻覺(jué)檢測(cè)和緩解

在音頻字幕生成領(lǐng)域,即自動(dòng)生成音頻片段的自然語(yǔ)言描述時(shí),一個(gè)主要挑戰(zhàn)是音頻-文本模型在預(yù)訓(xùn)練過(guò)程中過(guò)度依賴(lài)視覺(jué)模態(tài)。這種依賴(lài)引入了數(shù)據(jù)噪聲和幻覺(jué),最終削弱了生成字幕的準(zhǔn)確性。為了解決這個(gè)問(wèn)題,Xu等(2023a)引入了一種AudioSet標(biāo)簽引導(dǎo)的模型,用于引導(dǎo)大規(guī)模音頻-文本數(shù)據(jù)(BLAT)。值得注意的是,該模型避免了視頻的使用,從而最大限度地減少了與視覺(jué)模態(tài)相關(guān)的噪聲。跨檢索、生成和分類(lèi)等多項(xiàng)任務(wù)的實(shí)驗(yàn)結(jié)果驗(yàn)證了BLAT在減輕幻覺(jué)問(wèn)題上的有效性。

語(yǔ)音情感在人與人交流中起著至關(guān)重要的作用,并在語(yǔ)音合成和自然語(yǔ)言理解等領(lǐng)域有廣泛應(yīng)用。然而,傳統(tǒng)的分類(lèi)方法可能無(wú)法捕捉到人類(lèi)語(yǔ)音中傳達(dá)的細(xì)膩且復(fù)雜的情感(Jiang等,2019)、(Han等,2021)、(Ye等,2021)。SECap(Xu等,2024a)是一個(gè)為語(yǔ)音情感字幕設(shè)計(jì)的框架,旨在通過(guò)自然語(yǔ)言捕捉語(yǔ)音的復(fù)雜情感細(xì)微差別。SECap利用包括LLaMA作為文本解碼器、HuBERT作為音頻編碼器以及Q-Former作為Bridge-Net的各種組件,基于語(yǔ)音特征生成連貫的情感字幕。

盡管音頻語(yǔ)言模型具有零樣本推理的能力,但在強(qiáng)大性能的同時(shí),仍面臨著諸如幻覺(jué)特定任務(wù)細(xì)節(jié)等挑戰(zhàn)。為了解決這個(gè)問(wèn)題,Elizalde等(2024)引入了對(duì)比語(yǔ)言-音頻預(yù)訓(xùn)練(CLAP)模型。CLAP通過(guò)460萬(wàn)對(duì)多樣化的音頻-文本對(duì)進(jìn)行預(yù)訓(xùn)練,采用雙編碼器架構(gòu),增強(qiáng)了表示學(xué)習(xí),從而在聲音、音樂(lè)和語(yǔ)音領(lǐng)域?qū)崿F(xiàn)更好的任務(wù)泛化。

基準(zhǔn)評(píng)估

為了應(yīng)對(duì)音樂(lè)字幕領(lǐng)域數(shù)據(jù)稀缺的問(wèn)題,Doh等(2023)引入了LP-MusicCaps,這是一個(gè)綜合數(shù)據(jù)集,包括50萬(wàn)段音頻片段和大約220萬(wàn)條字幕。他們利用大型語(yǔ)言模型(LLMs)訓(xùn)練了一個(gè)基于Transformer的音樂(lè)字幕生成模型,并在零樣本和遷移學(xué)習(xí)場(chǎng)景下評(píng)估其性能,表現(xiàn)出相對(duì)于監(jiān)督基線(xiàn)模型的優(yōu)越性。

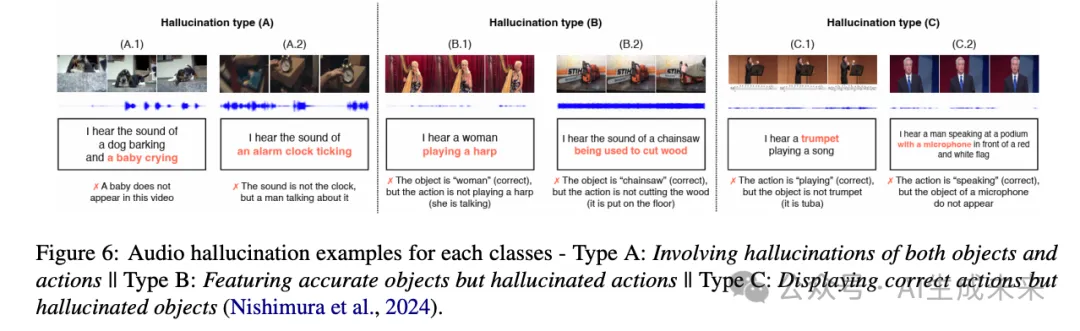

Nishimura等(2024)研究了大型音視頻語(yǔ)言模型中的音頻幻覺(jué)問(wèn)題,這些模型主要基于視覺(jué)信息生成音頻描述,而忽略了音頻內(nèi)容。他們將這些幻覺(jué)分為三種類(lèi)型:涉及對(duì)象和動(dòng)作的幻覺(jué)、對(duì)象準(zhǔn)確但動(dòng)作幻覺(jué)、動(dòng)作正確但對(duì)象幻覺(jué)。在他們的研究中,他們通過(guò)收集音頻信息獲取了1000個(gè)句子,并對(duì)其進(jìn)行標(biāo)注以確定是否包含聽(tīng)覺(jué)幻覺(jué),如果檢測(cè)到則進(jìn)一步分類(lèi)幻覺(jué)類(lèi)型。

為了評(píng)估大型音頻模型(LAMs)的組合推理能力,Ghosh等(2023)引入了CompA,包含兩個(gè)主要關(guān)注真實(shí)音頻樣本的專(zhuān)家標(biāo)注基準(zhǔn)。這一基準(zhǔn)用于通過(guò)一種新穎的學(xué)習(xí)方法微調(diào)CompA-CLAP,提升其組合推理能力,并在需要組合推理的任務(wù)中表現(xiàn)出相對(duì)于所有基線(xiàn)模型的顯著改進(jìn)。

幻覺(jué):好還是壞?

大型模型中的幻覺(jué)現(xiàn)象呈現(xiàn)出創(chuàng)造力與不確定性之間的復(fù)雜互動(dòng)。一方面,超越常規(guī)數(shù)據(jù)邊界的能力可以產(chǎn)生新穎和創(chuàng)新的輸出。幻覺(jué)可以激發(fā)探索性學(xué)習(xí),揭示數(shù)據(jù)中意想不到的模式和特征。它們還可以作為壓力測(cè)試的一種形式,提高模型的魯棒性和適應(yīng)性。此外,這些意外的輸出甚至可以激發(fā)人類(lèi)的創(chuàng)造力,成為新想法和新視角的跳板(Rawte等,2023b)。然而,幻覺(jué)的這種雙重性質(zhì)也帶來(lái)了顯著的缺點(diǎn)。幻覺(jué)輸出的質(zhì)量和連貫性可能存在問(wèn)題,在準(zhǔn)確性和可靠性至關(guān)重要的應(yīng)用中帶來(lái)挑戰(zhàn)。幻覺(jué)還可能傳播模型訓(xùn)練數(shù)據(jù)中存在的錯(cuò)誤信息和偏見(jiàn),可能加深現(xiàn)有的偏見(jiàn)并削弱用戶(hù)信任。這些輸出的可解釋性降低可能進(jìn)一步削弱模型的可信度和采用率。當(dāng)幻覺(jué)產(chǎn)生不當(dāng)、冒犯或有害內(nèi)容時(shí),會(huì)引發(fā)倫理問(wèn)題。必須進(jìn)行仔細(xì)的監(jiān)控和控制機(jī)制,以防止產(chǎn)生可能對(duì)用戶(hù)造成傷害或困擾的輸出。在探索與忠實(shí)度之間找到這種微妙的平衡,對(duì)于在最大化大型模型效用的同時(shí)減輕意外輸出相關(guān)風(fēng)險(xiǎn)至關(guān)重要。總體而言,大型模型中的幻覺(jué)現(xiàn)象突顯了對(duì)這些能力進(jìn)行細(xì)致理解和戰(zhàn)略管理的必要性。

限制

先前的綜述論文主要關(guān)注大型語(yǔ)言模型中的幻覺(jué)現(xiàn)象,并未廣泛涵蓋視覺(jué)、音頻和視頻模態(tài)中的幻覺(jué)。在這篇綜述論文中,我們的目標(biāo)是全面概述所有模態(tài)中的幻覺(jué)現(xiàn)象,考慮到幻覺(jué)可能出現(xiàn)在任何大型基礎(chǔ)模型中。盡管我們努力提供關(guān)于所有基礎(chǔ)模型中幻覺(jué)技術(shù)的最新進(jìn)展的全面總結(jié),但我們承認(rèn)可能會(huì)遺漏該領(lǐng)域的一些相關(guān)研究。

未來(lái)方向

研究人員正在積極研究幻覺(jué)緩解技術(shù),因?yàn)樵诿舾蓄I(lǐng)域中,生成虛構(gòu)或錯(cuò)誤內(nèi)容的挑戰(zhàn)可能會(huì)產(chǎn)生嚴(yán)重后果(Tonmoy et al., 2024; Rawte et al., 2023b)。以下是解決這些基礎(chǔ)模型中幻覺(jué)問(wèn)題的潛在方向:

數(shù)據(jù)資源: 最近的研究強(qiáng)調(diào)了在精心策劃的高質(zhì)量樣本上進(jìn)行簡(jiǎn)單微調(diào)的效果,這種方法在減少幻覺(jué)方面超過(guò)了大規(guī)模微調(diào)和強(qiáng)化學(xué)習(xí)方法。在知識(shí)密集型領(lǐng)域,開(kāi)發(fā)以實(shí)體為中心的微調(diào)指令,整合來(lái)源于知識(shí)圖譜的結(jié)構(gòu)化知識(shí),有望提高準(zhǔn)確性和相關(guān)性。此外,針對(duì)特定任務(wù)或領(lǐng)域的對(duì)齊技術(shù)已被證明在緩解幻覺(jué)方面有效。隨著該領(lǐng)域研究的進(jìn)展,預(yù)計(jì)將有更多資源專(zhuān)注于通過(guò)任務(wù)特定或領(lǐng)域適應(yīng)的方法改善對(duì)齊,從而進(jìn)一步增強(qiáng)語(yǔ)言模型在生成事實(shí)和可信內(nèi)容方面的可靠性。

自動(dòng)化評(píng)估: 開(kāi)發(fā)考慮諸如事實(shí)準(zhǔn)確性和連貫性等因素的專(zhuān)門(mén)評(píng)估指標(biāo)對(duì)于幻覺(jué)檢測(cè)非常有用。將自動(dòng)化評(píng)估與通過(guò)眾包進(jìn)行的人類(lèi)判斷相結(jié)合,可以捕捉到自動(dòng)化系統(tǒng)單獨(dú)難以檢測(cè)的細(xì)微方面。此外,還在開(kāi)發(fā)對(duì)抗性測(cè)試方法,通過(guò)設(shè)計(jì)輸入來(lái)暴露AI系統(tǒng)的弱點(diǎn),增強(qiáng)其對(duì)幻覺(jué)的抵抗力。此外,在強(qiáng)調(diào)事實(shí)核查和準(zhǔn)確性的數(shù)據(jù)集上微調(diào)基礎(chǔ)模型提供了另一種提高內(nèi)容可靠性和減少幻覺(jué)發(fā)生的方法。

改進(jìn)檢測(cè)和緩解技術(shù): 緩解基礎(chǔ)模型中的幻覺(jué)需要利用推理機(jī)制、知識(shí)圖譜集成、專(zhuān)門(mén)的事實(shí)核查模型、偏差緩解技術(shù)和主動(dòng)學(xué)習(xí)方法的多方面方法。諸如Chain of Thought(CoT)和Tree of Thought(ToT)等新興技術(shù)增強(qiáng)了這些模型的推理能力,可能減少幻覺(jué)。整合知識(shí)圖譜有助于理解事實(shí)信息和概念關(guān)系,從而支持內(nèi)容生成和事實(shí)核查。專(zhuān)門(mén)的驗(yàn)證模型通過(guò)與策劃的知識(shí)進(jìn)行交叉引用來(lái)識(shí)別不準(zhǔn)確之處,而偏差檢測(cè)和緩解技術(shù)促進(jìn)公平性。最后,管理AI開(kāi)發(fā)中策劃知識(shí)負(fù)責(zé)任使用的倫理指南和監(jiān)管框架可以降低風(fēng)險(xiǎn)并增強(qiáng)公眾信任,從而整體提高AI生成內(nèi)容的質(zhì)量、準(zhǔn)確性和可信度。

多模態(tài)幻覺(jué): 解決多模態(tài)大型基礎(chǔ)模型中的幻覺(jué)需要跨越數(shù)據(jù)中心舉措、跨模態(tài)對(duì)齊努力、架構(gòu)創(chuàng)新、標(biāo)準(zhǔn)化基準(zhǔn)、重構(gòu)幻覺(jué)以及增強(qiáng)可解釋性和信任的綜合方法。數(shù)據(jù)中心技術(shù)確保多樣化和高質(zhì)量的訓(xùn)練數(shù)據(jù)的穩(wěn)健收集、增強(qiáng)和校準(zhǔn)。跨模態(tài)對(duì)齊專(zhuān)注于通過(guò)復(fù)雜的架構(gòu)對(duì)齊跨模態(tài)的表示。模型架構(gòu)的進(jìn)步涉及設(shè)計(jì)能夠有效處理復(fù)雜語(yǔ)言和視覺(jué)輸入的專(zhuān)用模型。建立統(tǒng)一的指標(biāo)和標(biāo)準(zhǔn)化基準(zhǔn)可以準(zhǔn)確評(píng)估幻覺(jué)和可靠的性能評(píng)估。將幻覺(jué)重構(gòu)為一種特性探討其在下游應(yīng)用中的集成,優(yōu)化人類(lèi)體驗(yàn)。最后,開(kāi)發(fā)用于解釋模型行為、可視化內(nèi)部結(jié)構(gòu)和改進(jìn)可靠性評(píng)估的技術(shù),有助于增強(qiáng)對(duì)多模態(tài)大模型的信任。這種多方面的方法共同解決了關(guān)鍵的幻覺(jué)挑戰(zhàn),為更可靠和值得信賴(lài)的多模態(tài)AI系統(tǒng)鋪平了道路。

結(jié)論

這篇綜述論文系統(tǒng)地分類(lèi)了基礎(chǔ)模型中幻覺(jué)現(xiàn)象的現(xiàn)有研究,提供了對(duì)關(guān)鍵方面的全面見(jiàn)解,包括檢測(cè)、緩解、任務(wù)、數(shù)據(jù)集和評(píng)估指標(biāo)。文章討論了幻覺(jué)在基礎(chǔ)模型中廣泛的影響,承認(rèn)其在各個(gè)領(lǐng)域中的影響。通過(guò)研究檢測(cè)和緩解技術(shù)的最新進(jìn)展,論文強(qiáng)調(diào)了解決這一挑戰(zhàn)的重要性,鑒于基礎(chǔ)模型在關(guān)鍵任務(wù)中的不可或缺性。其主要貢獻(xiàn)在于引入了一個(gè)結(jié)構(gòu)化的分類(lèi)法,用于對(duì)基礎(chǔ)模型中的幻覺(jué)進(jìn)行分類(lèi),涵蓋文本、圖像、視頻和音頻領(lǐng)域。

本文轉(zhuǎn)自AI生成未來(lái) ,作者:AI生成未來(lái)