少或零樣本異常檢測最新研究跟蹤

少或零樣本異常檢測旨在給定少量幾張正常樣本或不給定任何樣本實現(xiàn)對未見類別的異常檢測。該方向的很多研究成果發(fā)表在最近一年內(nèi),主要得益于視覺語言模型(CLIP)的強大泛化能力。

基于視覺語言模型的方法

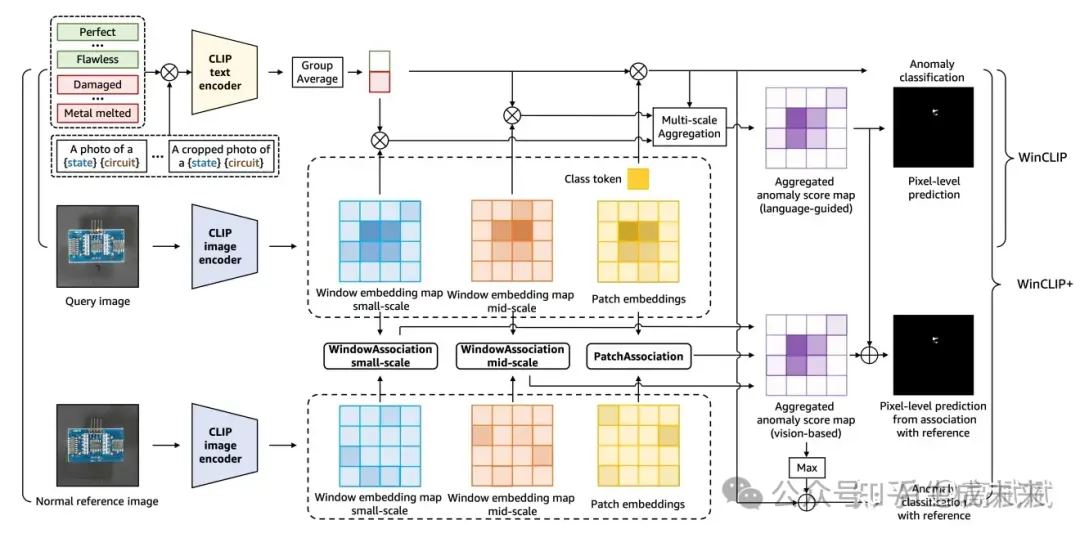

- CVPR 2023, WinCLIP

該方法首次證實視覺語言的基礎(chǔ)模型在零樣本異常檢測任務(wù)上仍然保持強的泛化性。該方法首先為正常和異常分別設(shè)計了多個文本提示,將該提示表征對和圖像表征計算相似度然后以 softmax 歸一化獲得圖像級的異常得分。為進一步提升性能,提出以滑動窗口的方式在輸入圖像上獲取不同尺度的Patch,然后將提示表征和密集的Patch 表征計算相似度獲得 Patch 級的異常得分。最終的結(jié)果是將圖像級和Patch級的異常得分做平均獲得異常預(yù)測。此外,為充分利用少量正常樣本,該方法將這些樣本提取視覺特征和待測圖像的特征對比獲得一個額外的異常預(yù)測,該做法顯著提升了異常分割的性能。

核心貢獻:首次證實視覺語言的基礎(chǔ)模型在零樣本異常檢測任務(wù)上仍然保持強的泛化性;

不足之處:提示模版需要人工設(shè)計,非常工程化;滑動窗口的方式帶來大的計算開銷;

論文沒有開源代碼和模型,第三方的復(fù)現(xiàn)(https://github.com/zqhang/Accurate-WinCLIP-pytorch)可獲得接近原始論文的結(jié)果。

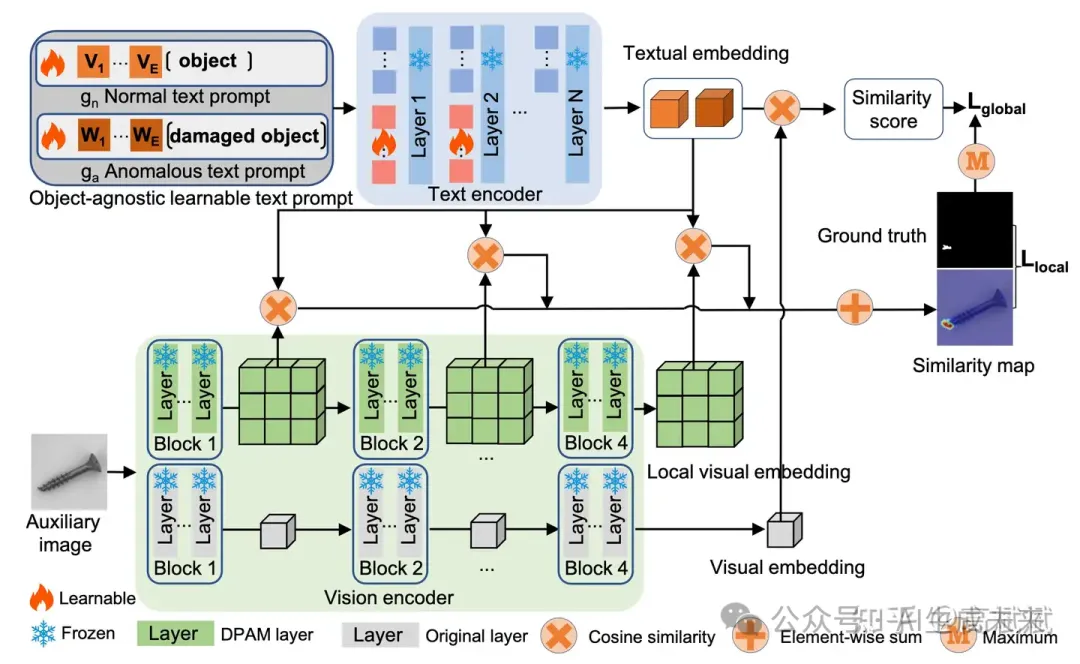

- ICLR 2024, AnomalyCLIP

該方法使用一個輔助的異常檢測數(shù)據(jù)集(包括正常和異常樣本且?guī)в衜ask標(biāo)注)學(xué)習(xí)正常和異常的樣本提示來實現(xiàn)異常分割。由于使用了輔助數(shù)據(jù)集來學(xué)習(xí)提示特征,這避免了原始CLIP model 中間視覺特征和提示特征無法對齊的問題,因此可以充分利用不同層的視覺特征。最后將多層級的視覺特征和學(xué)習(xí)到提示特征計算相似度來獲取異常的預(yù)測。

核心貢獻:極大地簡化了WinCLIP中提示工程和密集滑窗;學(xué)習(xí)到的提示表征具有通用性,可以泛化不同的數(shù)據(jù)集,如工業(yè)和醫(yī)療領(lǐng)域的異常檢測。

不足之處:需要精確標(biāo)注的異常檢測數(shù)據(jù)集;其泛化性一定程度上受輔助數(shù)據(jù)集的影響。

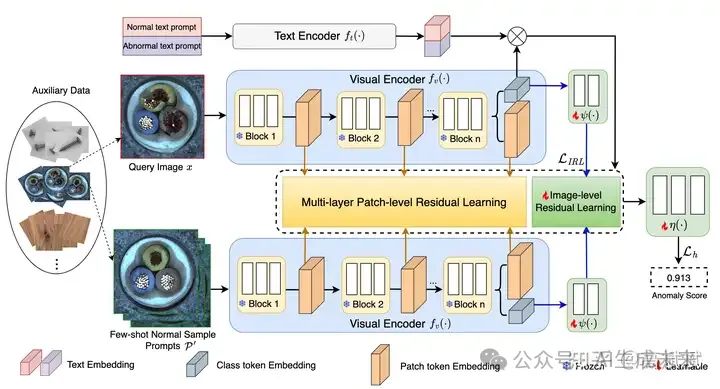

- CVPR 2024, InCtrl

同AnomalyCLIP 一樣,該方法也需要輔助數(shù)據(jù)集來預(yù)先訓(xùn)練并利用CLIP model 中間層的特征。不同之處在于其在建模過程中充分利用正常樣本并構(gòu)建了基于Normal-Query 對數(shù)據(jù)輸入方式,在圖像級和Patch級分別對 Normal-Query 對的特征建模。為加強模型的性能,保留WinCLIP中文本提示特征和視覺特征異常預(yù)測。

核心貢獻:建模過程中充分利用正常樣本,在測試時只需少量幾張未見類別的正常圖像就可以實現(xiàn)未見類別的異常檢測;

不足之處:需要精確標(biāo)注的異常檢測數(shù)據(jù);其泛化性一定程度上受輔助數(shù)據(jù)集的影響;該方法最終的Loss 只在圖像級,因此像素級的異常分割效果可能不太理想(論文也未做該評估和對比)。

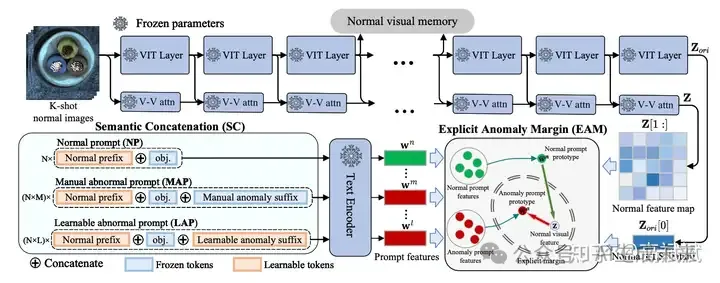

- CVPR 2024, PromptAD

該方法提出語義串聯(lián),即將正常提示與異常后綴連接起來,從而實現(xiàn)正常提示到異常提示的轉(zhuǎn)變,因此可以構(gòu)建大量負樣本,用于在一類設(shè)置中指導(dǎo)提示學(xué)習(xí)。此外,為了減輕由于缺乏異常圖像而帶來的訓(xùn)練挑戰(zhàn),該方法引入了顯式異常間隔的概念,它用于通過超參數(shù)顯式控制正常提示特征和異常提示特征之間的間隔。

核心貢獻:如何基于一類設(shè)置中指導(dǎo)提示學(xué)習(xí)的方法;引入了顯式異常間隔的概念,減輕了由于缺乏異常圖像而帶來的訓(xùn)練挑戰(zhàn)。

不足之處:類似WinCLIP,提示需人工設(shè)計,且每一類別都需要定制化的提示模版;

基于測試數(shù)據(jù)先驗的方法

這類方法不需要任何訓(xùn)練圖像,僅需要一個批次或全量的測試數(shù)據(jù)實現(xiàn)異常檢測。一個主要事實是: 在異常檢測領(lǐng)域,異常圖像或像素的占比通常很低,尤其在像素級。盡管這類方法號稱零樣本,但需要使用測試數(shù)據(jù)的先驗,因此在隱私保護或online的測試場景,這類方法并不適用。

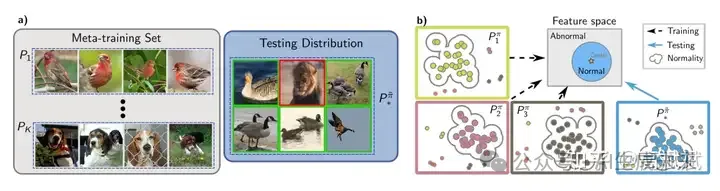

- NeurIPS 2023, ACR

該方法提出了自適應(yīng)中心表示,它結(jié)合了兩個簡單想法:批量歸一化和元訓(xùn)練。該方法假設(shè)總體一個隨機采樣的批次中通常正常比異常具有更多的樣本。元訓(xùn)練基于正常樣本和合成的異常樣本,主要用于保障模型具有中心化表征的能力。測試時只要統(tǒng)計測試批次樣本的均值和方差兩個統(tǒng)計量,然后使用批量歸一化實現(xiàn)異常檢測。

核心貢獻:批量歸一化和元訓(xùn)練相結(jié)合進行異常檢測的想法是新穎的。

不足之處:方法背后潛藏很多Tricks(實際實現(xiàn)), 不易于擴展。

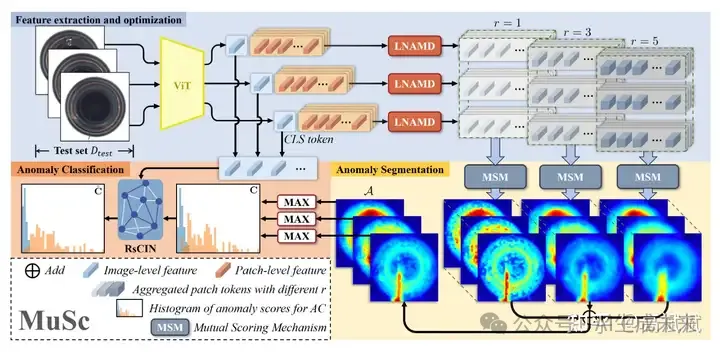

- ICLR 2024, MuSc

該方法提出了無標(biāo)簽圖片互打分的工業(yè)異常檢測與分割新方法,其核心思想是基于正常區(qū)域與正常區(qū)域較為相似,異常區(qū)域與大多數(shù)區(qū)域都不相似的基本假設(shè)。該方法僅使用測試數(shù)據(jù)中未標(biāo)記圖像來獲得高質(zhì)量的patch級異常分數(shù)。該方法在本質(zhì)上可以理解為一個粗暴(沒有CoreSet)的PatchCore, 因此直接使用 PatchCore 在整個測試數(shù)據(jù)集上應(yīng)該有類似的結(jié)果。

不足之處:測試階段需要預(yù)先獲得整個測試數(shù)據(jù);推理階段涉及較大的計算量,一張圖像的預(yù)測涉及整個測試數(shù)據(jù)的前向推理;

本文轉(zhuǎn)自 AI生成未來 ,作者:高斌斌